Declaration officielle

Ce qu'il faut comprendre

Quelle était la croyance traditionnelle des SEO sur l'indexation massive ?

Pendant des années, la communauté SEO a recommandé une approche progressive pour l'indexation de sites volumineux. Cette pratique consistait à ouvrir les vannes petit à petit, permettant à Google de découvrir quelques milliers de pages à la fois.

Cette stratégie reposait sur l'observation que les moteurs de recherche semblaient avoir des difficultés à traiter des volumes massifs de nouvelles URLs simultanément. Les référenceurs craignaient également des problèmes de budget de crawl et de pénalités potentielles.

Que dit exactement John Mueller sur ce sujet ?

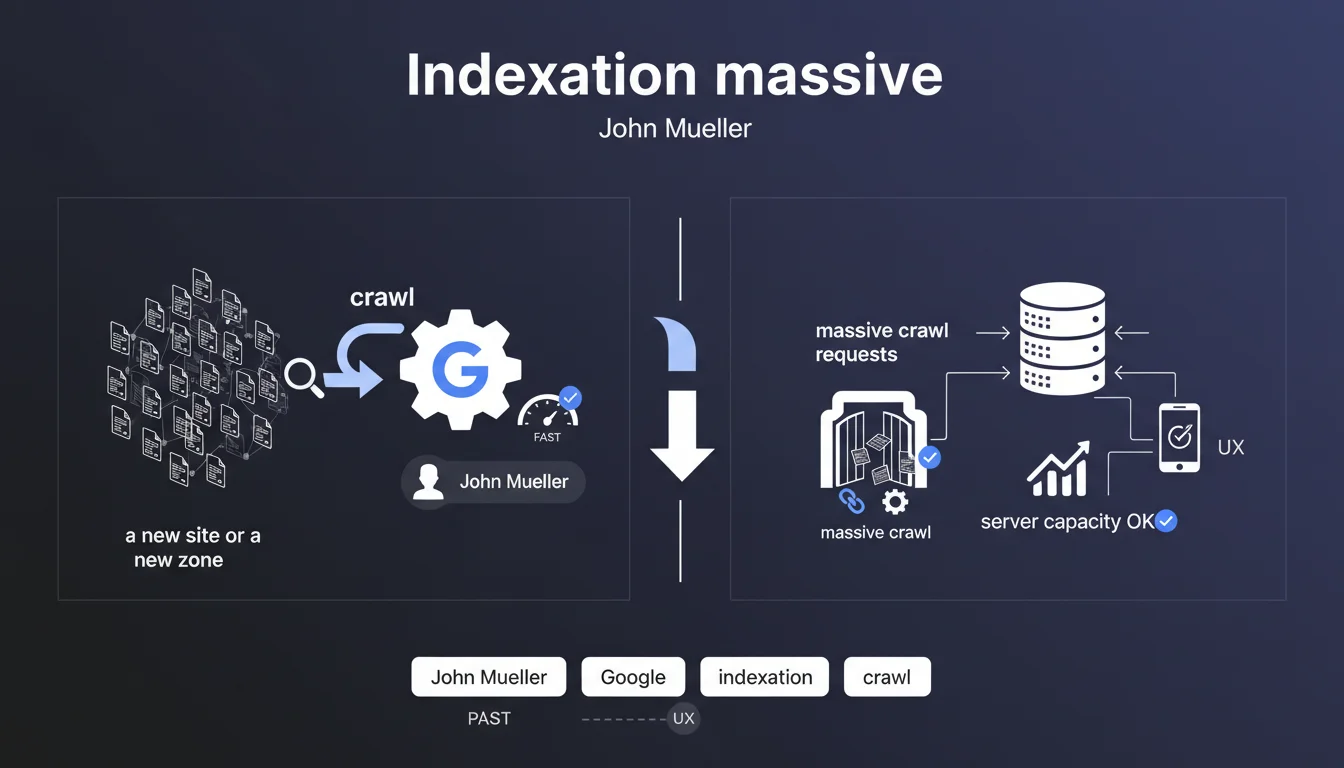

John Mueller affirme clairement que Google n'a aucun problème à crawler et indexer des centaines de milliers de pages d'un coup. Cette déclaration marque une évolution significative dans la compréhension technique des capacités du moteur.

La seule contrainte mentionnée concerne la capacité du serveur à supporter un tel afflux de requêtes de crawl. Le goulot d'étranglement se situe donc côté hébergement, pas côté Google.

Pourquoi cette évolution dans les capacités de Google ?

L'infrastructure technique de Google a considérablement évolué ces dernières années. Les investissements massifs dans les fermes de serveurs et les algorithmes de traitement parallèle permettent désormais de gérer des volumes beaucoup plus importants.

- Google peut indexer massivement sans problème technique de son côté

- La limitation principale réside dans la capacité du serveur à répondre aux requêtes

- L'approche progressive n'est plus nécessaire pour des raisons liées au moteur

- Cette évolution simplifie le lancement de gros sites ou de nouvelles sections

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

En pratique, cette affirmation de Mueller correspond effectivement aux observations récentes sur de gros lancements. Les sites de milliers de pages peuvent être indexés en quelques jours sans difficulté particulière, contrairement aux années précédentes.

Cependant, il faut nuancer : l'indexation rapide ne signifie pas automatiquement un positionnement immédiat. Google peut crawler et indexer massivement, mais l'évaluation qualitative et le ranking prennent du temps.

Dans quels cas faut-il quand même faire attention ?

Même si Google accepte un crawl massif, certaines situations nécessitent de la prudence particulière. Les sites avec une autorité limitée ou une infrastructure technique fragile doivent anticiper les impacts.

L'indexation massive de contenus de faible qualité reste problématique, quelle que soit la vitesse d'indexation. Google pourrait rapidement identifier un site comme étant de faible valeur ajoutée.

Quelles sont les implications pour le budget de crawl ?

Cette déclaration ne remet pas en cause le concept de budget de crawl. Google peut indexer massivement, mais cela ne signifie pas qu'il le fera systématiquement si le site ne présente pas suffisamment de signaux de qualité.

Le budget de crawl reste déterminé par l'autorité du domaine, la fréquence de mise à jour et la qualité globale. Un site nouveau ou peu autoritaire n'obtiendra pas nécessairement un crawl massif immédiat.

Impact pratique et recommandations

Que faut-il faire concrètement pour préparer un lancement massif ?

La préparation technique devient l'élément critique. Avant tout lancement de volume, il faut s'assurer que votre infrastructure peut supporter un afflux de requêtes Googlebot sans dégradation des performances.

Testez votre serveur avec des outils de charge pour simuler 50 à 100 requêtes simultanées. Vérifiez que les temps de réponse restent sous 500ms et que le serveur ne sature pas.

- Dimensionner correctement son hébergement (CPU, RAM, bande passante)

- Activer un système de cache performant (Varnish, Redis, CDN)

- Optimiser les requêtes base de données pour éviter les goulots d'étranglement

- Configurer un monitoring en temps réel pour détecter les problèmes

- Préparer un sitemap XML propre avec toutes les URLs à indexer

- Vérifier que le robots.txt ne bloque pas les sections importantes

- S'assurer que le maillage interne permet une découverte facile

Quelles erreurs éviter lors d'une indexation massive ?

L'erreur principale serait de se concentrer uniquement sur le volume d'indexation sans considérer la qualité. Un site massivement indexé avec du contenu faible enverra des signaux négatifs durables.

Ne confondez pas capacité technique et stratégie optimale. Ce n'est pas parce que Google peut tout indexer d'un coup qu'il faut nécessairement procéder ainsi, surtout si votre contenu n'est pas encore optimal.

Comment vérifier que votre stratégie d'indexation fonctionne ?

Utilisez la Search Console pour suivre quotidiennement le nombre de pages indexées et les éventuelles erreurs de crawl. Le rapport de couverture vous donnera une vision claire de la progression.

Surveillez également vos logs serveur pour comprendre le comportement réel de Googlebot : fréquence, pages visitées, codes de réponse. Ces données sont essentielles pour ajuster votre stratégie.

💬 Commentaires (0)

Soyez le premier à commenter.