Declaration officielle

Ce qu'il faut comprendre

Que signifie cette déclaration de Google sur l'indexation manuelle ?

Google affirme qu'un site bien conçu n'a pas besoin d'intervention manuelle pour être indexé. Les robots de Google crawlent naturellement le web et découvrent les nouvelles pages via les liens internes, le sitemap XML et les mises à jour régulières.

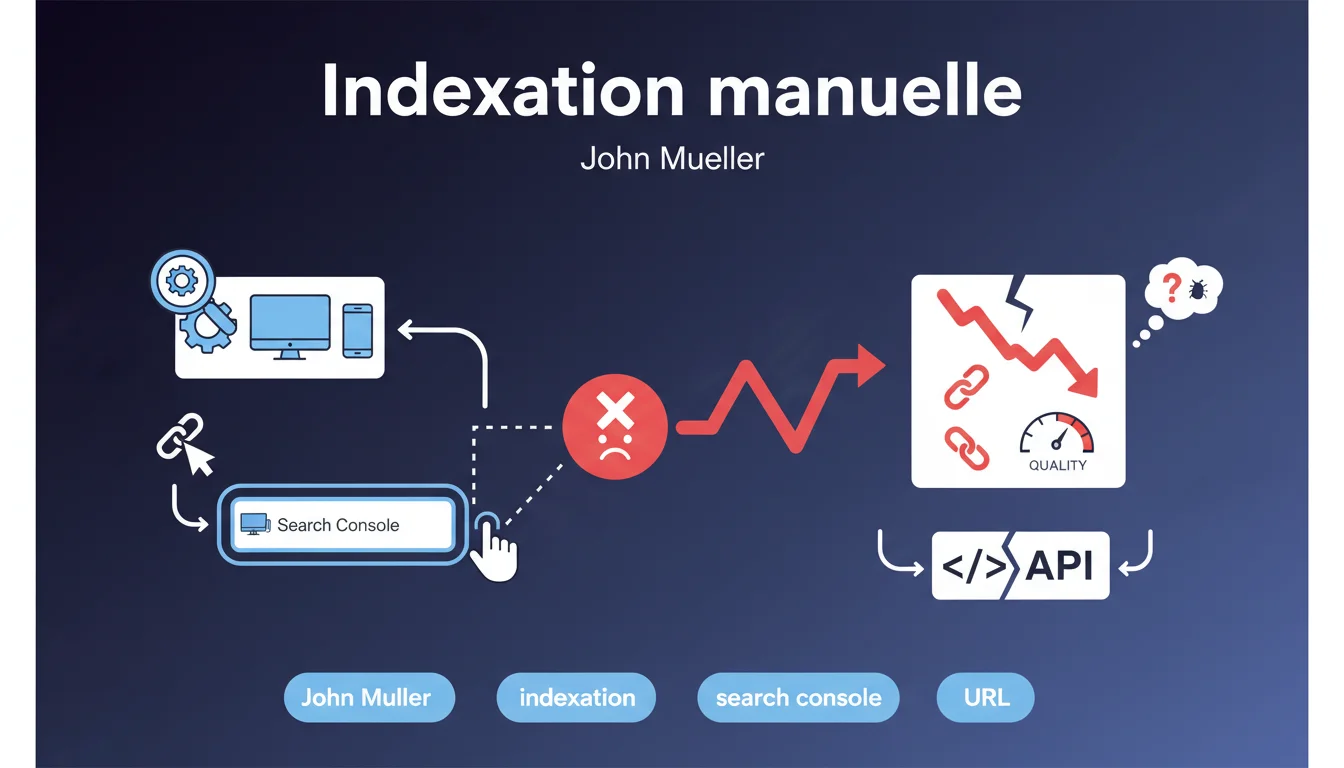

Si vous devez constamment utiliser l'outil d'inspection d'URL dans la Search Console pour forcer l'indexation, c'est un signal d'alarme. Cela indique que Google ne considère pas votre contenu suffisamment pertinent ou de qualité pour le crawler et l'indexer automatiquement.

Pourquoi Google ne crawle-t-il pas certaines pages automatiquement ?

Plusieurs raisons peuvent expliquer ce comportement. La qualité du contenu est la première cause : contenu dupliqué, faible valeur ajoutée, ou pages trop similaires entre elles.

Les problèmes techniques sont également en cause : budget de crawl insuffisant, architecture de site complexe, erreurs dans le robots.txt, ou pages orphelines sans liens internes. Google optimise ses ressources et ne perd pas de temps sur des pages peu intéressantes.

Quand l'indexation manuelle est-elle justifiée ?

Il existe des cas légitimes d'utilisation de l'outil d'inspection. Pour un nouveau site ou une page importante venant d'être publiée, demander une indexation rapide est normal.

De même, après une correction majeure ou pour une actualité urgente, solliciter Google est acceptable. Mais cela doit rester l'exception, pas la règle.

- L'indexation automatique est la norme pour un site sain

- Le recours systématique à l'outil d'inspection révèle des problèmes structurels

- La qualité du contenu prime sur les manipulations techniques

- Google privilégie l'efficacité de son crawl sur les sites à forte valeur ajoutée

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Après 15 ans d'expérience, je confirme que cette position de Google correspond à la réalité observable. Les sites avec un contenu de qualité et une architecture propre n'ont effectivement jamais de problèmes d'indexation.

En revanche, j'ai constaté que de nombreux SEO utilisent l'outil d'inspection comme un pansement plutôt que de résoudre les causes profondes. C'est une erreur stratégique qui masque des faiblesses structurelles.

Quelles nuances importantes faut-il apporter à cette règle ?

La réalité est plus complexe que la déclaration ne le laisse entendre. Pour les sites de grande taille (e-commerce, médias), même avec un contenu excellent, le budget de crawl peut être limité. Certaines pages peuvent mettre du temps à être découvertes naturellement.

Les nouveaux sites ou domaines récents souffrent également d'un crawl moins fréquent. Dans ces cas, utiliser l'outil d'inspection pour les pages stratégiques n'est pas un aveu d'échec, mais une tactique pragmatique.

Dans quels contextes cette règle ne s'applique-t-elle pas complètement ?

Pour les sites d'actualité ou les contenus sensibles au temps, la rapidité d'indexation est critique. Utiliser l'outil pour accélérer le processus sur des contenus à forte valeur ajoutée est parfaitement justifié.

Les sites JavaScript complexes ou les applications web modernes peuvent également nécessiter une attention particulière. Même avec un contenu excellent, des problèmes de rendering peuvent ralentir l'indexation naturelle.

Impact pratique et recommandations

Comment diagnostiquer si mon site a un problème d'indexation structurel ?

Commencez par analyser le taux d'indexation dans la Search Console. Comparez le nombre de pages soumises via le sitemap au nombre de pages réellement indexées. Un écart important est un signal d'alarme.

Vérifiez ensuite la fréquence de crawl dans les statistiques d'exploration. Si Google visite rarement votre site malgré des mises à jour régulières, c'est que votre contenu ne suscite pas d'intérêt.

Examinez les pages exclues et leurs motifs : « Explorée, actuellement non indexée » ou « Détectée, actuellement non indexée » indiquent des problèmes de qualité perçue.

Quelles actions concrètes mettre en place pour résoudre ces problèmes ?

Concentrez-vous d'abord sur la qualité du contenu. Auditez vos pages pour identifier le contenu faible, dupliqué ou peu différencié. Consolidez ou supprimez les pages à faible valeur ajoutée.

Optimisez votre architecture de liens internes. Assurez-vous qu'aucune page stratégique n'est orpheline et que les pages importantes sont accessibles en maximum 3 clics depuis la homepage.

Améliorez votre sitemap XML en ne listant que les pages canoniques et de qualité. Un sitemap pollué par des pages sans valeur dilue le signal envoyé à Google.

- Auditer le contenu existant et supprimer ou améliorer les pages faibles

- Vérifier que chaque page apporte une valeur unique et non dupliquée

- Optimiser le maillage interne pour faciliter la découverte des pages

- Nettoyer le sitemap XML pour ne garder que les URLs prioritaires

- Surveiller régulièrement les rapports de couverture dans la Search Console

- Augmenter la fréquence de publication de contenu de qualité

- Améliorer la vitesse de chargement et les Core Web Vitals

- Corriger les erreurs techniques (robots.txt, balises canonical, redirections)

Quelle stratégie adopter pour éviter de dépendre de l'indexation manuelle ?

Établissez un calendrier éditorial cohérent avec du contenu régulier et de qualité. Google privilégie les sites qui démontrent une activité soutenue et une expertise constante.

Mettez en place une stratégie de liens internes systématique pour que chaque nouvelle page soit immédiatement connectée au reste du site. Utilisez des cocons sémantiques pour renforcer la pertinence thématique.

Investissez dans l'amélioration continue de votre site plutôt que dans des tactiques ponctuelles. L'indexation naturelle est la conséquence d'un écosystème sain, pas d'une manipulation technique.

💬 Commentaires (0)

Soyez le premier à commenter.