Declaration officielle

Ce qu'il faut comprendre

Que signifie réellement cette déclaration de Google ?

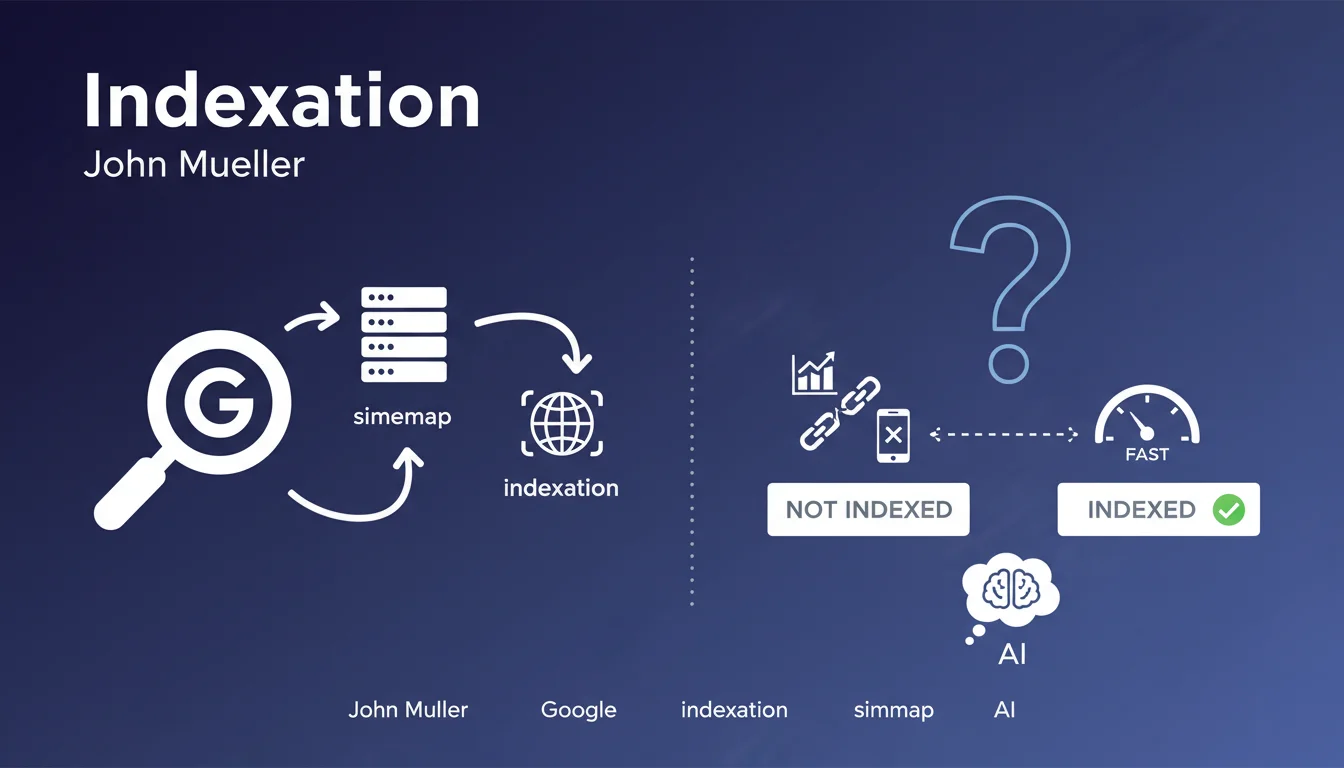

John Mueller a confirmé ce que de nombreux praticiens SEO observent quotidiennement : Google ne garantit pas l'indexation exhaustive de toutes les pages d'un site web, même si elles sont présentes dans le sitemap XML.

Cette déclaration officialise une réalité technique souvent mal comprise. Le budget de crawl, la qualité du contenu et la pertinence perçue jouent un rôle déterminant dans les choix d'indexation de Google.

Quels sont les facteurs qui influencent la sélection des pages indexées ?

Google utilise des algorithmes de priorisation pour déterminer quelles pages méritent d'être indexées et maintenues dans son index. La valeur ajoutée du contenu est le critère principal.

Plusieurs facteurs entrent en jeu : la fréquence de mise à jour, le nombre de liens internes et externes, le taux d'engagement des utilisateurs, et la duplication de contenu.

- Budget de crawl limité : Google alloue un temps et des ressources limités à chaque site

- Qualité du contenu : Les pages à faible valeur ajoutée sont écartées

- Signaux techniques : Vitesse de chargement, erreurs serveur, accessibilité

- Architecture du site : Profondeur des pages et maillage interne

- Pertinence thématique : Cohérence avec l'autorité du domaine

Est-ce problématique si toutes mes pages ne sont pas indexées ?

Non, ce n'est pas nécessairement un problème. En réalité, chercher à faire indexer toutes les pages peut même être contre-productif pour votre SEO.

L'objectif est de faire indexer les pages stratégiques qui apportent de la valeur aux utilisateurs et génèrent du trafic qualifié. Les pages administratives, de filtres ou de faible qualité n'ont souvent pas besoin d'être indexées.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Dans mon expérience de 15 ans, j'ai constaté que Google devient de plus en plus sélectif dans son indexation. Les sites avec des milliers de pages voient régulièrement 20 à 40% de leurs URLs non indexées.

Cette tendance s'est accentuée depuis 2018 avec l'introduction de critères de qualité plus stricts. Google préfère maintenir un index propre plutôt qu'exhaustif, ce qui améliore la pertinence des résultats de recherche.

Quelles nuances importantes faut-il apporter à cette déclaration ?

La première nuance concerne les sites d'autorité. Un site établi avec une forte autorité de domaine bénéficie généralement d'un meilleur taux d'indexation qu'un nouveau site.

La seconde nuance porte sur la temporalité. Une page peut être temporairement non indexée avant d'être intégrée plus tard, ou inversement être désindexée si sa qualité se dégrade.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Pour les petits sites (moins de 100 pages de qualité), un taux d'indexation proche de 100% est attendu et facilement atteignable. Si ce n'est pas le cas, il y a probablement un problème technique.

Les sites ayant une actualité forte (médias, blogs actifs) bénéficient également d'un traitement privilégié avec des taux d'indexation plus rapides et plus élevés. Google alloue plus de ressources aux sites qui publient régulièrement du contenu frais et de qualité.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son taux d'indexation ?

La priorité est d'identifier vos pages stratégiques et de vous assurer qu'elles sont toutes indexées. Utilisez Google Search Console pour analyser le statut d'indexation de chaque catégorie de pages.

Améliorez le maillage interne pour faciliter la découverte des pages importantes. Les pages situées à plus de 3 clics de la page d'accueil ont statistiquement moins de chances d'être indexées rapidement.

Travaillez sur la qualité du contenu. Une page avec moins de 300 mots, sans valeur ajoutée ou dupliquée a peu de chances d'être indexée durablement.

Quelles erreurs critiques faut-il absolument éviter ?

N'incluez pas dans votre sitemap XML des pages de faible valeur : filtres, pagination, pages de remerciement, ou pages dupliquées. Cela dilue votre budget de crawl.

Évitez de forcer l'indexation via des soumissions répétées dans Search Console. Cela n'accélère pas le processus et peut être perçu comme du spam par Google.

Comment vérifier et monitorer efficacement l'indexation de votre site ?

Utilisez le rapport de couverture dans Google Search Console pour identifier les pages exclues et les raisons. Analysez particulièrement les catégories "Découverte, actuellement non indexée" et "Explorée, actuellement non indexée".

Mettez en place un monitoring régulier avec des requêtes "site:" ciblées sur vos catégories de pages stratégiques. Un tableau de bord mensuel vous permet de détecter rapidement les variations anormales.

- Auditer les pages stratégiques et vérifier leur indexation individuelle

- Nettoyer le sitemap XML en ne gardant que les URLs à forte valeur ajoutée

- Optimiser le maillage interne pour pousser les pages prioritaires

- Enrichir le contenu des pages à faible densité textuelle (< 300 mots)

- Corriger les erreurs techniques (404, 5xx, redirections en chaîne)

- Améliorer la vitesse de chargement des pages stratégiques

- Mettre en place un monitoring mensuel du taux d'indexation par typologie de pages

- Analyser régulièrement les rapports Search Console pour anticiper les problèmes

💬 Commentaires (0)

Soyez le premier à commenter.