Declaration officielle

Ce qu'il faut comprendre

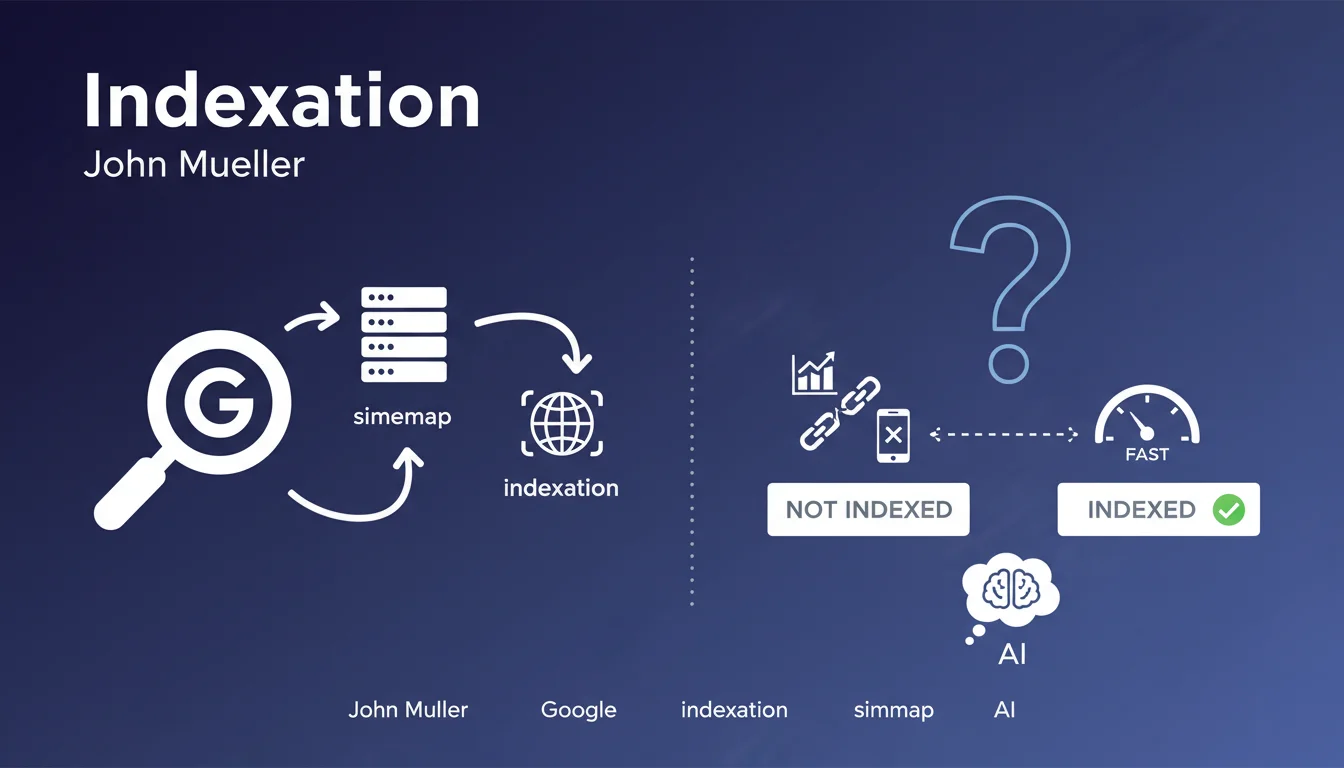

Pourquoi Google n'indexe-t-il jamais toutes les pages d'un site ?

Google dispose d'un budget de crawl limité pour chaque site web. Le moteur de recherche doit optimiser ses ressources et ne peut pas explorer et indexer l'intégralité du web en permanence.

Google utilise des algorithmes de qualité pour déterminer quelles pages méritent d'être indexées. Les pages jugées de faible valeur ajoutée, dupliquées ou peu pertinentes sont naturellement écartées de l'index.

Qu'est-ce qu'une page de qualité selon Google ?

Une page de qualité répond à un besoin utilisateur identifié avec un contenu original et suffisamment approfondi. Elle doit apporter une valeur unique par rapport aux autres pages existantes sur le sujet.

Les critères incluent la profondeur du contenu, l'expertise démontrée, la satisfaction des intentions de recherche et les signaux d'engagement utilisateur.

Que se passe-t-il si on ne garde que les meilleures pages ?

La question posée est pertinente : en supprimant volontairement les pages faibles, pourrait-on améliorer le taux d'indexation global ? La logique suggère que oui, mais la réalité est plus complexe.

Google continue d'évaluer la qualité relative des pages restantes. Même avec moins de pages, le moteur appliquera toujours ses filtres de qualité et n'indexera pas nécessairement 100% du contenu restant.

- Budget de crawl : ressource limitée allouée par Google à chaque site

- Sélection qualitative : Google privilégie les pages à forte valeur ajoutée

- Indexation partielle : aucun site ne voit 100% de ses pages indexées

- Évaluation continue : même avec peu de pages, Google maintient ses critères de qualité

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Les audits SEO révèlent systématiquement que les sites voient entre 40% et 90% de leurs pages indexées selon leur qualité globale. Les sites e-commerce avec milliers de fiches produits similaires sont particulièrement touchés.

Cette sélection s'est intensifiée ces dernières années avec les mises à jour algorithmiques. Google est devenu plus exigeant sur la qualité pour lutter contre l'inflation de contenu médiocre.

Quelles nuances importantes faut-il apporter à cette affirmation ?

La déclaration de John Mueller reste vague sur le pourquoi du non-indexation. Toutes les pages non indexées ne sont pas forcément de mauvaise qualité : problèmes techniques, maillage interne défaillant, ou manque d'autorité du domaine peuvent aussi expliquer ces absences.

Il existe une différence cruciale entre pages crawlées non indexées et pages jamais découvertes. La Search Console permet de distinguer ces cas via le rapport de couverture.

Dans quels cas cette logique atteint-elle ses limites ?

Pour les très gros sites (millions de pages), même avec un contenu excellent, Google n'indexera jamais tout pour des raisons purement techniques. Le budget de crawl devient le facteur limitant principal.

Les sites d'actualité ou marketplaces font face à un défi d'échelle où la fraîcheur et la volumétrie entrent en conflit avec les capacités d'indexation de Google.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son taux d'indexation ?

La première action consiste à réaliser un audit complet des pages indexées via la Search Console. Identifiez les pages crawlées mais non indexées et analysez les raisons fournies par Google.

Procédez ensuite à une analyse qualitative de votre contenu. Identifiez les pages à faible valeur : contenus très courts, pages quasi-vides, doublons internes, ou pages sans trafic depuis 12 mois.

Concernant les pages faibles, trois options s'offrent à vous : amélioration substantielle, consolidation avec d'autres pages similaires, ou suppression avec redirection 301 vers la page la plus pertinente.

Quelles erreurs éviter absolument dans cette démarche ?

Ne supprimez jamais de pages sans analyser leur trafic organique réel et leur rôle dans le maillage interne. Une page sans positionnement peut générer du trafic longue traîne précieux.

Évitez les suppressions massives brutales. Google interprète parfois ces changements importants comme des signaux négatifs. Procédez par étapes et surveillez l'impact de chaque vague de modifications.

N'oubliez pas que le noindex n'est pas la solution miracle. Une page en noindex consomme toujours du budget de crawl. Pour les contenus vraiment inutiles, la suppression ou le blocage robots.txt sont préférables.

Comment mesurer l'efficacité de ses optimisations ?

Suivez l'évolution du taux de pages indexées dans la Search Console semaine après semaine. Une amélioration saine se situe généralement entre 5% et 15% selon le volume de nettoyage effectué.

Surveillez également les métriques de performance globales : trafic organique, positions moyennes, et taux de crawl. Une stratégie réussie améliore ces indicateurs dans les 4-8 semaines suivant les modifications.

- Auditer les pages indexées vs crawlées dans la Search Console

- Identifier les contenus à faible valeur ajoutée (analytics + qualité éditoriale)

- Analyser le trafic organique réel de chaque page avant suppression

- Prioriser l'amélioration avant la suppression quand c'est pertinent

- Procéder par phases progressives avec monitoring constant

- Mettre en place des redirections 301 pour les pages supprimées avec trafic

- Optimiser le maillage interne vers les pages stratégiques conservées

- Surveiller l'évolution du taux d'indexation sur 2-3 mois

- Documenter chaque modification pour traçabilité et apprentissage

L'optimisation du taux d'indexation est un exercice d'équilibriste entre qualité et volume. L'approche doit être méthodique et basée sur des données précises plutôt que sur des suppressions arbitraires.

Cette démarche nécessite une expertise technique et éditoriale pointue pour éviter les erreurs coûteuses. Les enjeux sont importants : une mauvaise décision peut impacter durablement la visibilité organique.

Face à la complexité de ces optimisations, faire appel à une agence SEO spécialisée permet de bénéficier d'une méthodologie éprouvée et d'un accompagnement personnalisé. Un regard externe expert identifie souvent des opportunités ou des risques que l'on ne perçoit pas en interne.

💬 Commentaires (0)

Soyez le premier à commenter.