Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le crawl en HTTP/2 par Googlebot ?

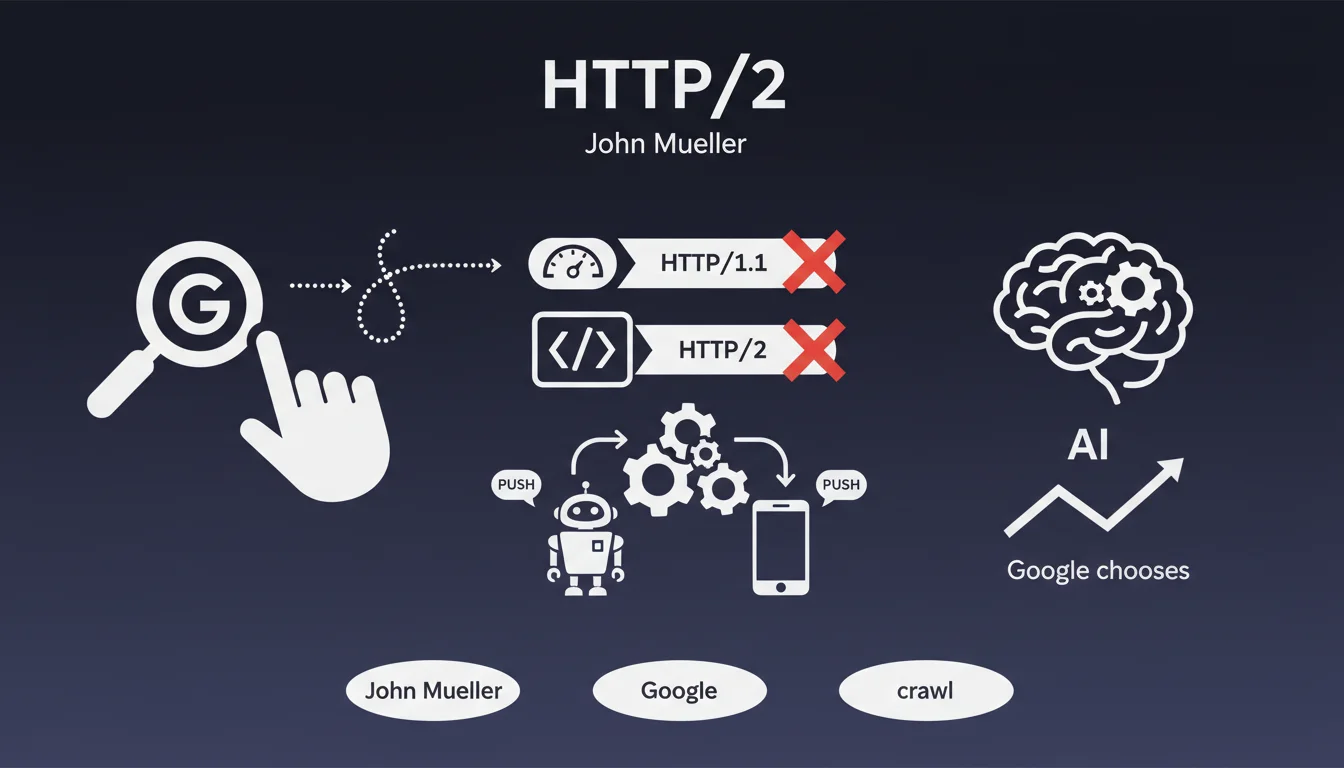

Depuis septembre 2020, Googlebot est capable de crawler des sites web en HTTP/2, un protocole plus moderne et performant que HTTP/1.1. Cette évolution permet théoriquement des crawls plus rapides et plus efficaces.

Cependant, contrairement à ce que certains webmasters pourraient espérer, il n'est pas possible de forcer le robot de Google à utiliser HTTP/2. C'est Google qui décide du protocole utilisé lors de chaque session de crawl.

Qui décide du protocole de crawl utilisé ?

La décision d'utiliser HTTP/2 ou HTTP/1.1 appartient entièrement à Google et son algorithme de crawl. Le site web ne peut pas imposer ce choix, même s'il supporte parfaitement HTTP/2.

Google analyse différents facteurs pour déterminer le meilleur protocole à utiliser : la configuration du serveur, la stabilité observée, les performances, et d'autres critères internes. Cette approche permet à Google d'optimiser son budget de crawl global.

Existe-t-il un moyen de refuser le crawl en HTTP/2 ?

Bien qu'on ne puisse pas forcer HTTP/2, il est possible de refuser une tentative de crawl dans ce protocole. Pour cela, le serveur doit renvoyer un code de statut HTTP 421 (Misdirected Request).

Dans ce cas, Googlebot comprend que le serveur ne souhaite pas être crawlé en HTTP/2 et basculera automatiquement sur HTTP/1.1 pour les requêtes suivantes. Cette option reste utile pour les serveurs rencontrant des problèmes spécifiques avec HTTP/2.

- Google choisit le protocole de crawl (HTTP/2 ou HTTP/1.1), pas le webmaster

- Le support HTTP/2 sur votre serveur ne garantit pas son utilisation par Googlebot

- Le code 421 permet de refuser le crawl HTTP/2 et forcer HTTP/1.1

- Cette décision fait partie de l'optimisation du budget de crawl de Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Absolument. Sur le terrain, nous observons effectivement que Googlebot alterne entre HTTP/1.1 et HTTP/2 selon ses propres critères. Les logs serveur montrent cette variation même sur des sites parfaitement configurés.

Cette approche s'inscrit dans la logique de Google qui garde le contrôle sur ses processus de crawl. Comme pour le budget de crawl ou la fréquence des passages, Google ajuste ses paramètres en fonction de nombreux signaux que nous ne maîtrisons pas totalement.

Quels sont les vrais enjeux derrière cette limitation ?

Le principal enjeu concerne l'optimisation des ressources serveur de Google. HTTP/2 permet des connexions multiplexées, mais peut aussi générer plus de charge sur certains serveurs mal configurés.

En gardant le contrôle, Google peut adapter son comportement à chaque site : utiliser HTTP/2 sur les infrastructures robustes et rester sur HTTP/1.1 pour les serveurs plus fragiles. Cela évite de surcharger des sites qui ne pourraient pas gérer efficacement ce protocole.

Dans quels cas le code 421 pourrait-il être utile ?

Le code 421 reste pertinent pour des cas spécifiques de configuration serveur. Par exemple, si votre serveur HTTP/2 rencontre des bugs avec certaines requêtes de Googlebot, ou si vous utilisez un CDN qui gère mal ce protocole.

En pratique, c'est une solution de dernier recours. La plupart des sites n'auront jamais besoin d'implémenter ce code. Si votre infrastructure est moderne et bien configurée, laissez simplement Google décider du protocole optimal.

Impact pratique et recommandations

Que faut-il faire concrètement sur son site ?

Assurez-vous que votre serveur supporte HTTP/2 correctement, mais n'essayez pas de forcer Googlebot à l'utiliser. Concentrez-vous plutôt sur l'optimisation générale de votre infrastructure.

La priorité reste de garantir que votre site est accessible, rapide et stable, quel que soit le protocole utilisé. HTTP/2 doit être considéré comme un bonus potentiel, pas comme un prérequis SEO.

Comment vérifier le comportement de Googlebot sur son site ?

Analysez vos logs serveur pour identifier le protocole utilisé par Googlebot lors de ses passages. Vous verrez probablement une combinaison de HTTP/1.1 et HTTP/2.

Utilisez la Google Search Console pour vérifier qu'il n'y a pas d'erreurs de crawl majeures. Si Googlebot accède correctement à votre contenu, le protocole utilisé importe peu.

Quelles erreurs éviter dans la gestion des protocoles HTTP ?

Ne bloquez pas HTTP/2 par défaut en pensant que cela pose problème. Laissez votre serveur négocier le protocole normalement. N'implémentez le code 421 que si vous rencontrez des problèmes avérés et documentés.

Évitez également de sur-optimiser pour HTTP/2 au détriment de HTTP/1.1. Votre site doit fonctionner parfaitement dans les deux protocoles, car une partie significative du trafic (utilisateurs et bots) utilisera encore HTTP/1.1.

- Activez HTTP/2 sur votre serveur si ce n'est pas déjà fait

- Vérifiez la compatibilité de votre configuration avec les deux protocoles

- Analysez vos logs pour observer le comportement réel de Googlebot

- Ne forcez pas l'utilisation d'un protocole spécifique

- Surveillez les erreurs de crawl dans la Search Console

- N'implémentez le code 421 que si vous avez un problème technique avéré

- Priorisez les optimisations qui impactent réellement l'expérience utilisateur

💬 Commentaires (0)

Soyez le premier à commenter.