Declaration officielle

Ce qu'il faut comprendre

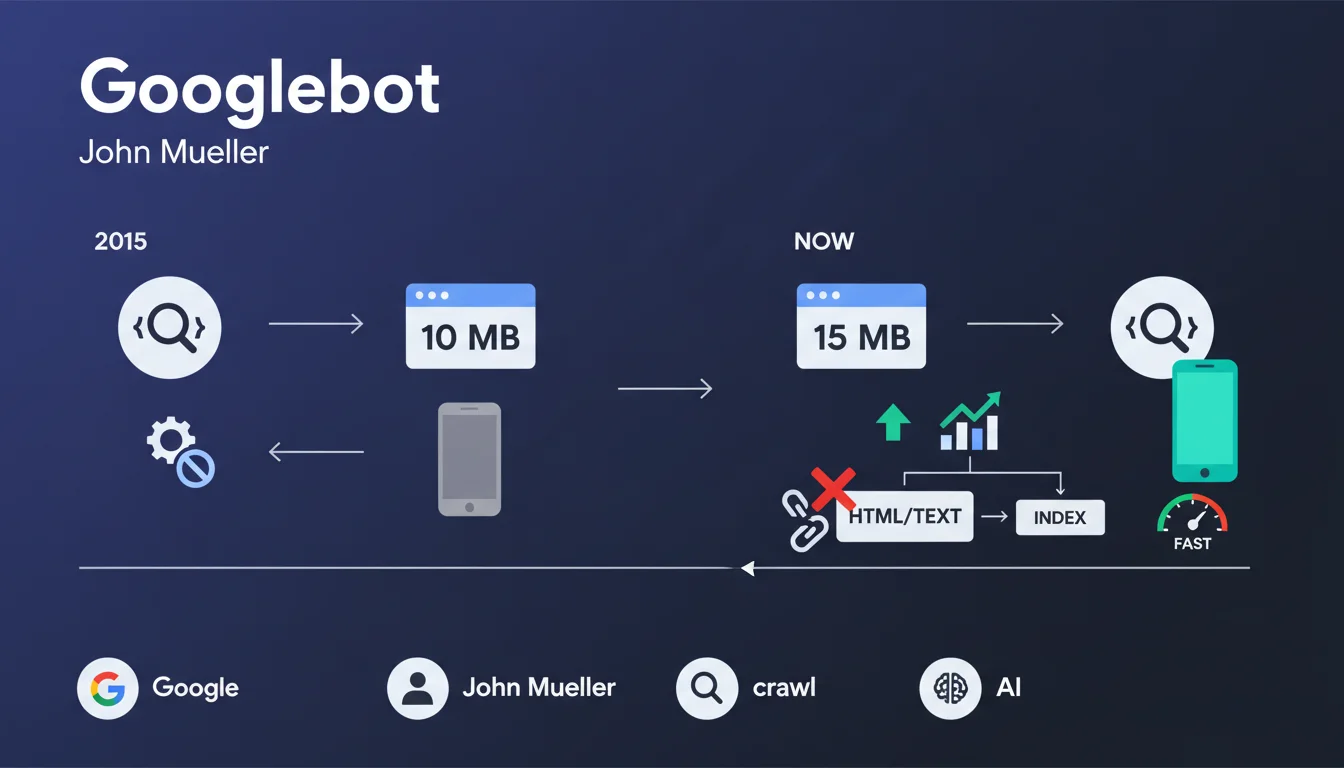

Google a officiellement fait évoluer sa limite de crawl HTML de 10 Mo à 15 Mo par page. Cette mise à jour représente une augmentation de 50% de la capacité de traitement du contenu par Googlebot.

Concrètement, cela signifie que tout code source HTML ou fichier texte dépassant cette limite ne sera ni crawlé ni indexé dans son intégralité. Le robot s'arrête simplement à 15 Mo et ignore le reste du contenu.

Cette limitation concerne principalement les pages avec un HTML particulièrement volumineux, ce qui reste rare dans la pratique web courante. Toutefois, certains types de sites peuvent être concernés :

- Pages avec des longs contenus générés dynamiquement (catalogues produits complets, listings massifs)

- Sites utilisant des frameworks JavaScript lourds qui gonflent le DOM

- Pages contenant des données structurées excessives ou du JSON-LD volumineux

- Sites avec du code inline important (CSS, JavaScript embarqué)

- Pages d'archives ou de listings sans pagination appropriée

Cette évolution montre que Google s'adapte à la complexité croissante des sites web modernes, tout en maintenant une limite raisonnable pour optimiser ses ressources de crawl.

Avis d'un expert SEO

Cette mise à jour est cohérente avec l'évolution du web et l'augmentation générale de la taille des pages ces dernières années. Les frameworks modernes et les applications web complexes génèrent effectivement plus de code qu'auparavant.

Néanmoins, il faut nuancer l'impact réel : très peu de sites atteignent cette limite. La page HTML moyenne se situe entre 30 Ko et 200 Ko. Atteindre 15 Mo nécessite vraiment une structure problématique ou des choix techniques discutables.

Dans ma pratique, les rares cas dépassant cette limite sont souvent des signaux de problèmes structurels : absence de pagination, contenu dupliqué inline, mauvaise architecture technique. Corriger ces aspects améliore généralement bien plus que le simple respect de cette limite.

Impact pratique et recommandations

- Auditez le poids HTML de vos principales pages, particulièrement les listings et catalogues (utilisez l'onglet Network de Chrome DevTools)

- Implémentez une pagination robuste pour tous les contenus longs (articles, produits, archives) au lieu de tout charger sur une seule page

- Externalisez CSS et JavaScript : évitez l'inline massif qui gonfle inutilement le HTML

- Optimisez les données structurées : limitez-vous aux schema.org essentiels sans dupliquer excessivement

- Utilisez le lazy loading et le chargement différé pour les contenus dynamiques plutôt que de tout inclure dans le DOM initial

- Surveillez les frameworks JavaScript : certains génèrent un DOM hypertrophié qu'il faut contrôler

- Testez avec "View Page Source" régulièrement pour vérifier que votre HTML reste raisonnable (idéalement sous 1 Mo)

- Configurez des alertes dans votre monitoring pour détecter les pages dépassant 5 Mo (seuil préventif)

Ces optimisations techniques touchent souvent à l'architecture profonde du site et nécessitent une expertise pointue en développement web et SEO technique. L'analyse du poids HTML, la refonte de la pagination ou l'optimisation du rendu côté serveur sont des chantiers complexes qui impliquent plusieurs compétences.

Pour les sites d'envergure ou les plateformes e-commerce avec des catalogues volumineux, faire appel à une agence SEO spécialisée permet de bénéficier d'un audit technique approfondi et d'un accompagnement personnalisé. Ces experts peuvent identifier précisément les sources de surpoids HTML et proposer des solutions adaptées à votre stack technique, tout en évitant les pièges qui pourraient impacter négativement votre indexation.

💬 Commentaires (0)

Soyez le premier à commenter.