Declaration officielle

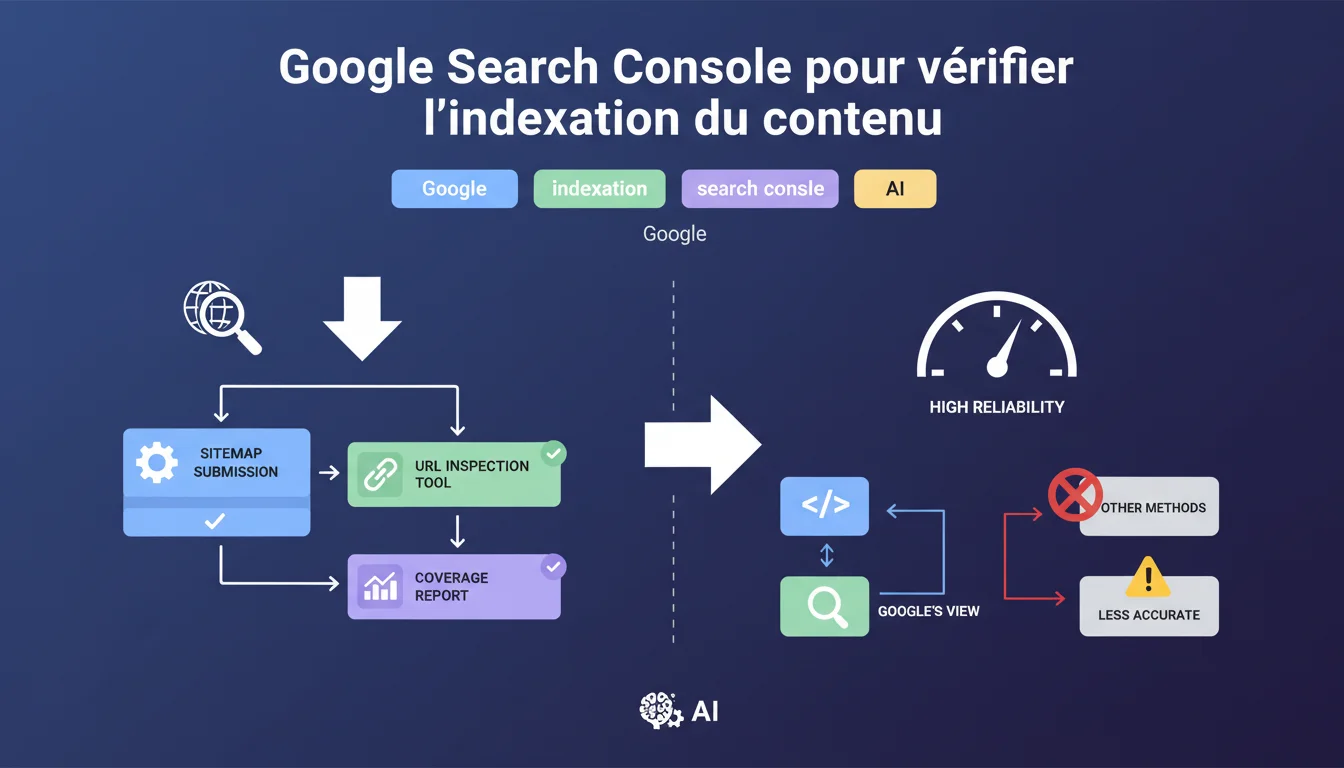

Google désigne officiellement la Search Console comme l'outil de référence pour vérifier l'indexation de votre contenu. Mais toutes les méthodes de vérification ne se valent pas : certaines sont plus fiables et précises que d'autres. L'enjeu est de savoir quelles approches privilégier pour ne pas passer à côté de problèmes d'indexation critiques.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur la Search Console plutôt que sur d'autres outils ?

Google pousse la Search Console comme outil privilégié pour une raison simple : c'est le seul qui reflète directement ce que ses systèmes voient. Contrairement aux outils tiers ou aux opérateurs de recherche, la GSC s'appuie sur les données brutes de crawl et d'indexation.

Les autres méthodes — comme le site: en cache ou les simulateurs de Googlebot — donnent une vision partielle ou différée. La GSC, elle, affiche les erreurs détectées par les robots, les URLs découvertes, et le statut d'indexation exact de chaque page.

Quelles sont ces « approches » dont Google parle et pourquoi ne sont-elles pas toutes équivalentes ?

Google ne détaille pas explicitement toutes les méthodes, mais on devine qu'il oppose la Search Console à des pratiques courantes : l'opérateur site:, les logs serveur, ou encore l'inspection manuelle d'URLs via des outils externes.

Le problème ? L'opérateur site: ne garantit pas que toutes les pages indexées apparaissent — il peut exclure des variantes, filtrer certains contenus, ou afficher des résultats fluctuants. Les logs serveur, eux, montrent ce que Googlebot crawle, pas ce qu'il indexe. Nuance critique.

Que doit-on surveiller en priorité dans la Search Console pour vérifier l'indexation ?

Trois zones méritent une attention quotidienne. D'abord, le rapport de couverture : il liste les pages indexées, exclues, et celles qui rencontrent des erreurs. Ensuite, l'outil d'inspection d'URL pour tester manuellement une page suspecte.

Enfin, le rapport des sitemaps : si Google découvre moins d'URLs que ce que vous soumettez, il y a un souci structurel — robots.txt mal configuré, canonicals mal gérées, ou contenu jugé de faible valeur.

- La Search Console reflète directement la vision de Google, contrairement aux outils tiers ou aux opérateurs de recherche

- L'opérateur site: n'est pas fiable pour un audit complet : il peut omettre des pages ou afficher des résultats partiels

- Le crawl ne garantit pas l'indexation : un robot peut visiter une page sans jamais l'intégrer à l'index

- Trois zones critiques dans la GSC : couverture, inspection d'URL, et sitemaps

- Fiabilité variable : certaines méthodes donnent une vision différée ou incomplète du statut réel d'indexation

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, mais avec des limites que Google ne mentionne pas. La Search Console a ses propres angles morts. Par exemple, elle peut parfois afficher un statut « indexé » alors que la page n'apparaît dans aucune recherche pertinente — ce qu'on appelle une indexation technique sans visibilité réelle.

À l'inverse, certaines pages marquées « exclues » peuvent générer du trafic organique via des recherches très spécifiques. Google indexe parfois sans le signaler explicitement dans la GSC. [À vérifier] : la synchronisation entre l'index réel et les données affichées dans la console n'est pas toujours immédiate.

Quelles nuances faut-il apporter à cette recommandation ?

Google dit « outil recommandé », pas « outil unique ». Une vérification robuste combine la GSC avec d'autres sources. Les logs serveur permettent de détecter des problèmes de crawl que la console ne remonte pas toujours : boucles de redirections, timeouts récurrents, ou pages orphelines jamais visitées.

Les outils comme Screaming Frog ou OnCrawl offrent une vision structurelle que la GSC ne donne pas : profondeur de clics, distribution du maillage interne, canonicals en chaîne. Soyons honnêtes — la GSC est indispensable, mais elle ne suffit pas pour un audit complet.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Sur les sites à forte volumétrie — plusieurs millions de pages — la GSC peut échantillonner les données. Elle ne remonte pas toujours l'exhaustivité des erreurs ou des pages indexées. Les sites e-commerce avec des facettes dynamiques sont particulièrement exposés à ce biais.

Autre cas : les sites multi-domaines ou multi-propriétés. La GSC fragmente la vision par propriété, ce qui complique la détection de problèmes transversaux — duplicate content inter-domaines, cannibalisation entre versions linguistiques, ou mauvaise gestion des hreflang.

Impact pratique et recommandations

Que faut-il faire concrètement pour exploiter la Search Console efficacement ?

Commencez par configurer toutes les variantes de votre domaine dans la GSC : HTTP, HTTPS, www et non-www. Même si vous redirigez, Google peut crawler ces variantes et signaler des erreurs spécifiques. Perdre cette granularité, c'est perdre des indices précieux.

Ensuite, activez les alertes email et consultez le rapport de couverture au moins deux fois par semaine. Une chute brutale du nombre de pages indexées ou une hausse des erreurs « serveur 5xx » doivent déclencher une réaction immédiate — pas dans trois semaines.

Utilisez l'outil d'inspection d'URL pour forcer une ré-indexation après chaque modification critique : refonte de meta description, ajout de contenu substantiel, ou correction d'une erreur technique. Ne supposez pas que Googlebot repassera rapidement — forcez la main.

Quelles erreurs éviter lors de l'interprétation des données de la Search Console ?

Ne confondez pas « découverte » et « indexation ». Une URL peut apparaître dans le rapport comme « découverte, actuellement non indexée » — ce qui ne signifie pas qu'elle le sera un jour. Google juge le contenu peu prioritaire, voire inutile. Si des pages stratégiques restent dans ce statut, c'est un signal d'alerte.

Évitez aussi de paniquer face au statut « exclue par la balise noindex ». Si vous avez volontairement mis un noindex, c'est normal. Mais vérifiez régulièrement que ce statut ne touche pas des pages que vous pensez avoir indexées — erreur classique après une migration mal suivie.

Comment vérifier que votre site est bien configuré pour une indexation optimale ?

Croisez les données GSC avec vos logs serveur. Si Googlebot ne crawle pas certaines sections stratégiques, c'est soit un problème de maillage interne, soit un crawl budget saturé par des URLs inutiles — filtres, sessions, paramètres dynamiques.

Testez manuellement l'inspection d'URL sur un échantillon représentatif : pages produits, catégories, contenus éditoriaux. Comparez le « rendu HTML » avec ce que vous voyez en source. Si Google charge une version différente — JavaScript mal exécuté, contenu asynchrone manquant — vous avez un problème de rendering.

- Configurer toutes les variantes de domaine dans la Search Console (HTTP, HTTPS, www, non-www)

- Activer les alertes email pour être notifié immédiatement des erreurs critiques

- Consulter le rapport de couverture au moins deux fois par semaine

- Utiliser l'outil d'inspection d'URL pour forcer la ré-indexation après chaque modification importante

- Croiser les données GSC avec les logs serveur pour détecter les problèmes de crawl non signalés

- Vérifier régulièrement que les pages stratégiques ne restent pas en statut « découverte, actuellement non indexée »

- Tester le rendu HTML via l'inspection d'URL pour s'assurer que Google voit bien tout le contenu

- Ne pas se fier uniquement à l'opérateur site: pour auditer l'indexation

💬 Commentaires (0)

Soyez le premier à commenter.