Declaration officielle

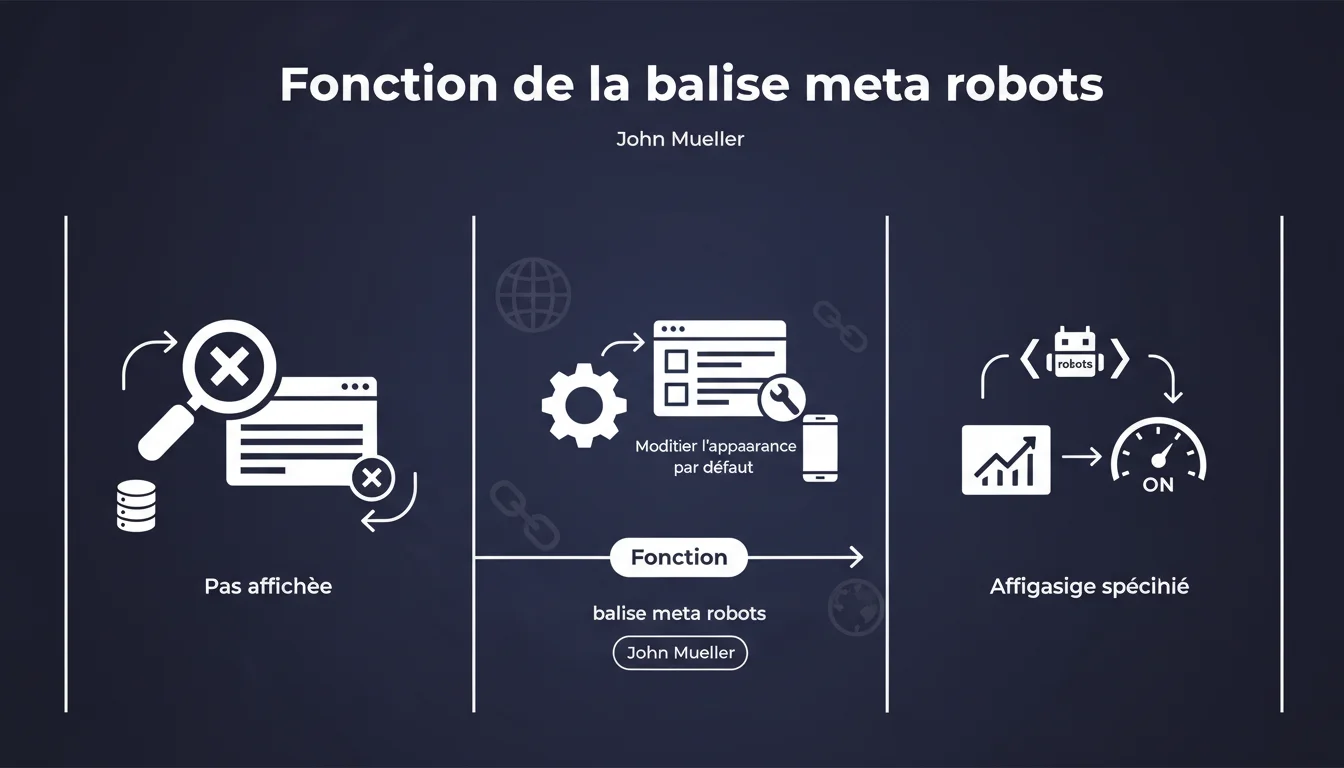

La balise meta robots permet de définir comment une page spécifique apparaît dans les résultats de recherche Google, voire de l'en exclure totalement. Elle modifie le comportement par défaut d'affichage d'une page. Concrètement, c'est votre levier de contrôle granulaire sur la présence et la présentation de chaque URL dans la SERP.

Ce qu'il faut comprendre

Quel est le rôle exact de la balise meta robots ?

La balise meta robots s'insère dans la section <head> d'une page HTML et donne des instructions directes à Googlebot sur la manière de traiter cette URL. Contrairement au fichier robots.txt qui agit au niveau du crawl, cette balise intervient après le téléchargement de la page et contrôle son indexation et son affichage.

Elle accepte plusieurs valeurs : noindex empêche l'indexation, nofollow bloque le suivi des liens, nosnippet supprime l'extrait de texte, noarchive désactive la mise en cache, etc. Chaque directive modifie un aspect précis de la présence de la page dans les résultats.

En quoi diffère-t-elle du robots.txt ?

Le fichier robots.txt bloque le crawl : Googlebot ne télécharge même pas la page. La balise meta robots, elle, suppose que la page a été crawlée et téléchargée — elle agit ensuite sur l'indexation et l'affichage.

Conséquence directe : si vous bloquez une URL dans robots.txt, Google ne peut pas lire sa balise meta robots. Résultat ? La page peut quand même apparaître dans les résultats, sans description, si des liens externes pointent vers elle. C'est un piège classique.

Quelles sont les directives les plus utilisées en pratique ?

Les professionnels SEO exploitent principalement noindex pour exclure des pages à faible valeur ajoutée (filtres, résultats de recherche interne, pages de remerciement). Le nofollow au niveau page est rare — on préfère gérer les liens individuellement via l'attribut rel="nofollow".

Les directives nosnippet, max-snippet, max-image-preview et max-video-preview servent à contrôler l'apparence dans la SERP sans toucher à l'indexation. Utile pour protéger du contenu sensible ou éviter qu'un extrait trop long ne cannibalise le trafic.

- La balise meta robots agit page par page, après le crawl mais avant l'indexation

- Elle se distingue du robots.txt qui bloque le téléchargement de la page

- Les valeurs multiples sont possibles :

<meta name="robots" content="noindex, nofollow"> - Google respecte ces directives — c'est un contrat ferme, pas une suggestion

- Une page bloquée en robots.txt peut quand même être indexée (sans contenu) si elle reçoit des backlinks

Avis d'un expert SEO

Cette déclaration est-elle complète ou simplifie-t-elle la réalité ?

Mueller présente les fondamentaux, mais laisse dans l'ombre plusieurs subtilités. Par exemple, il ne mentionne pas que l'en-tête HTTP X-Robots-Tag offre exactement les mêmes fonctionnalités — et qu'il est parfois plus adapté pour les fichiers non-HTML (PDF, images, vidéos).

Autre point : la balise meta robots ne bloque pas le crawl. Google continuera de télécharger la page à chaque visite pour vérifier si la directive a changé. Si vous avez des milliers de pages en noindex, elles consomment du crawl budget — ce que Mueller ne précise pas ici.

Quelles nuances faut-il apporter sur le terrain ?

En pratique, certaines combinaisons de directives créent des conflits ou des comportements inattendus. Exemple : une page avec noindex dans la balise meta ET bloquée dans robots.txt. Google ne peut pas lire la balise, donc il indexe l'URL (sans contenu) si elle a des backlinks. [À vérifier] dans vos propres audits.

Autre cas limite : noindex, follow. La page disparaît de l'index, mais Google suit et transmet le PageRank via ses liens. Utile pour des pages de transition, mais mal compris par beaucoup de praticiens qui croient que noindex coupe tout.

noindex trop longtemps en place finit par faire disparaître la page de l'index — mais Google cesse aussi de suivre ses liens au bout d'un certain temps. Si vous comptez sur une page noindexée pour distribuer du jus, surveillez l'évolution dans le temps.Que faire quand Google ignore la balise meta robots ?

Ça arrive — rarement, mais ça arrive. Causes fréquentes : balise placée après le <body>, JavaScript qui charge la balise trop tard, redirection 301/302 avant que Googlebot ne lise le HTML, ou encore en-têtes HTTP contradictoires.

Dans ces cas, Google peut indexer la page malgré un noindex présent. La solution : audit technique pour identifier où le robot lit (ou ne lit pas) votre directive. Les outils de rendu comme la Search Console aident, mais ne remplacent pas un test en conditions réelles.

Impact pratique et recommandations

Comment vérifier que vos balises meta robots sont correctement configurées ?

Premier réflexe : crawlez votre site avec Screaming Frog ou OnCrawl et extrayez toutes les balises meta robots. Comparez avec votre stratégie d'indexation. Cherchez les incohérences : pages stratégiques en noindex, pages inutiles indexables, directives contradictoires.

Ensuite, testez le rendu côté Google via l'outil Inspection d'URL dans la Search Console. Vérifiez que le HTML rendu contient bien la balise, au bon endroit, avec la bonne syntaxe. Si la balise est insérée en JavaScript après le chargement initial, Google risque de la manquer.

Quelles erreurs critiques faut-il absolument éviter ?

Ne combinez jamais robots.txt et noindex sur la même URL — c'est le meilleur moyen de créer un zombie indexé sans contenu. Si vous voulez désindexer, laissez Google crawler la page pour lire la balise.

Autre piège : appliquer un noindex global via un tag manager mal configuré. Résultat : tout le site disparaît de l'index en quelques semaines. Ça arrive plus souvent qu'on ne le croit, surtout lors de migrations ou de refonte.

- Auditez toutes vos balises meta robots avec un crawler professionnel

- Testez le rendu HTML via la Search Console pour chaque type de page critique

- Ne bloquez jamais en robots.txt une page que vous voulez désindexer

- Documentez votre stratégie d'indexation page par page, surtout sur les gros sites

- Surveillez les pages orphelines en

noindexqui consomment du crawl budget inutilement - Préférez l'en-tête X-Robots-Tag pour les fichiers non-HTML (PDF, images)

- Vérifiez que vos directives ne sont pas écrasées par des en-têtes HTTP contradictoires

La balise meta robots est un outil puissant, mais elle exige une rigueur technique et stratégique. Les configurations erronées — surtout sur des sites de plusieurs milliers de pages — peuvent détruire des mois de travail SEO en quelques jours.

Si votre infrastructure est complexe (multi-langues, facettes dynamiques, systèmes de filtres), ou si vous constatez des incohérences entre vos intentions et ce que Google indexe réellement, il peut être judicieux de faire appel à une agence SEO spécialisée pour un audit approfondi et un accompagnement personnalisé. Certaines erreurs ne se détectent qu'avec une expertise terrain et des outils professionnels.

❓ Questions frequentes

Peut-on combiner plusieurs directives dans une seule balise meta robots ?

La balise meta robots fonctionne-t-elle pour tous les moteurs de recherche ?

Que se passe-t-il si je supprime une balise noindex d'une page ?

L'en-tête X-Robots-Tag est-il plus efficace que la balise meta ?

Une page en noindex transmet-elle encore du PageRank via ses liens ?

🎥 De la même vidéo 3

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/09/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.