Declaration officielle

Ce qu'il faut comprendre

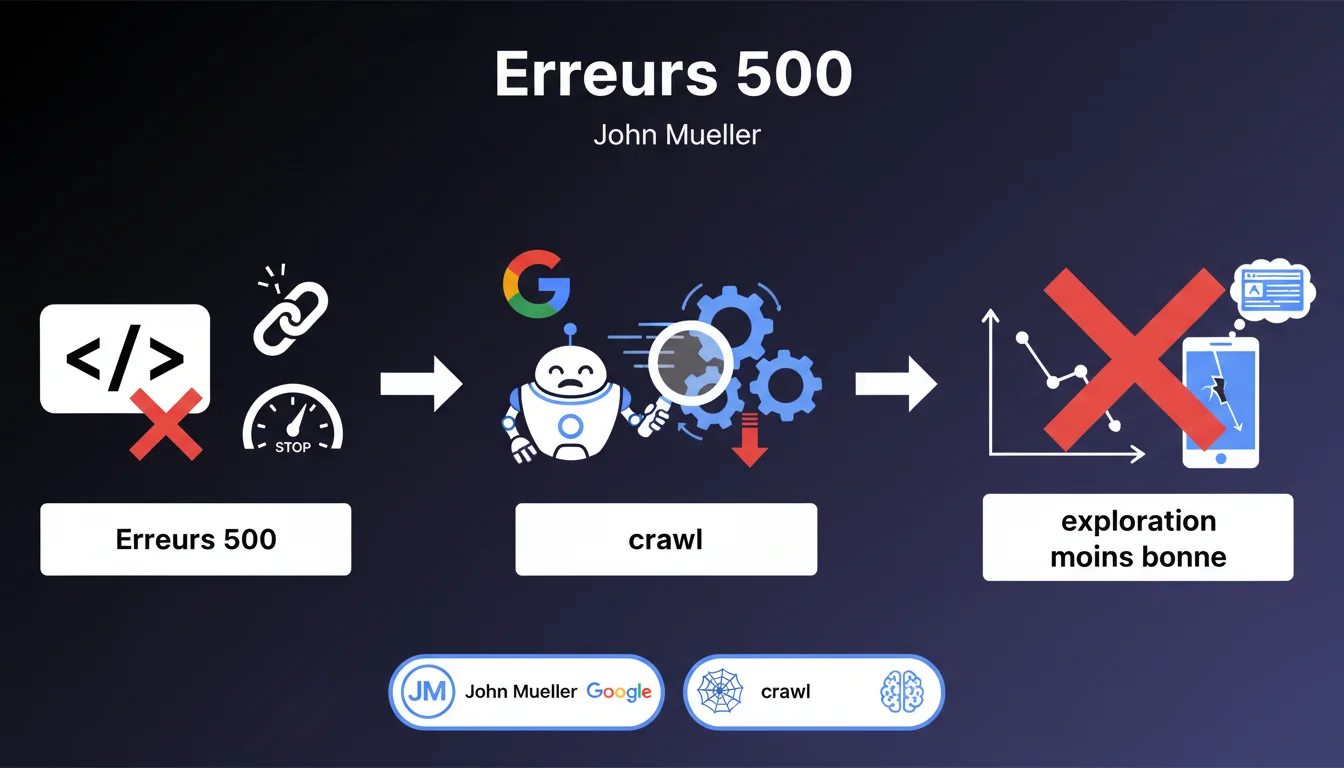

Google a confirmé qu'un nombre élevé d'erreurs 5xx (erreurs serveur) impacte directement le comportement de Googlebot lors du crawl de votre site. Lorsque le robot rencontre ces erreurs de manière répétée, il interprète cela comme un signal que le serveur est en difficulté.

En réponse à ces erreurs, Googlebot ralentit automatiquement sa vitesse d'exploration. Cette mesure de protection est conçue pour ne pas surcharger un serveur qui semble déjà en situation critique. Le robot suppose que ses requêtes contribuent peut-être à la surcharge.

Les conséquences pour votre SEO sont directes : moins de pages explorées signifie moins de pages indexées et potentiellement actualisées dans l'index de Google. Vos nouveaux contenus mettront plus de temps à être découverts et vos modifications seront prises en compte plus lentement.

- Les erreurs 5xx déclenchent un ralentissement du crawl par mesure de protection

- Le budget de crawl disponible est gaspillé sur des pages non accessibles

- Les nouvelles pages et mises à jour sont découvertes avec retard

- L'impact est proportionnel au nombre et à la fréquence des erreurs

- Le phénomène peut s'auto-entretenir si les erreurs persistent

Avis d'un expert SEO

Cette déclaration est parfaitement cohérente avec les observations terrain depuis de nombreuses années. Les logs serveur montrent clairement que Googlebot ajuste sa fréquence de crawl en fonction de la stabilité du serveur. C'est un mécanisme intelligent qui protège à la fois l'infrastructure et évite un gaspillage de ressources côté Google.

Une nuance importante : toutes les erreurs 500 ne se valent pas. Une erreur ponctuelle sur une page secondaire n'aura aucun impact. En revanche, des erreurs répétées sur des pages stratégiques ou des patterns d'erreurs massifs (10-20% des requêtes) déclenchent effectivement ce ralentissement. La durée et l'intensité du phénomène dépendent de votre historique de fiabilité.

Il faut également noter que certaines erreurs 5xx peuvent masquer des problèmes plus graves : configurations serveur inadaptées au trafic, problèmes de base de données, ou même attaques DDoS. Le ralentissement du crawl n'est alors qu'un symptôme parmi d'autres d'une infrastructure sous-dimensionnée.

Impact pratique et recommandations

- Mettez en place un monitoring permanent des codes HTTP retournés par votre serveur avec des outils comme Google Search Console, Pingdom ou UptimeRobot

- Configurez des alertes automatiques pour être notifié dès qu'un seuil d'erreurs 5xx est dépassé (par exemple 5% des requêtes sur 10 minutes)

- Réalisez des crawls réguliers avec Screaming Frog, Botify ou OnCrawl pour identifier les patterns d'erreurs avant que Google ne les rencontre massivement

- Analysez vos logs serveur pour corréler les erreurs 5xx avec les passages de Googlebot et identifier les pages problématiques

- Vérifiez votre infrastructure : capacité serveur, configuration PHP/Apache/Nginx, temps de réponse de la base de données, mémoire disponible

- Priorisez la correction des erreurs 5xx sur les pages stratégiques : homepage, catégories principales, pages de conversion, contenus récents

- Évitez les erreurs 500 génériques : configurez des pages d'erreur personnalisées et informatives plutôt que des erreurs serveur brutes

- Testez votre site sous charge pour identifier les seuils à partir desquels les erreurs apparaissent et dimensionnez en conséquence

Résumé : Les erreurs 5xx sont un signal critique qui impacte directement votre visibilité sur Google. Un monitoring proactif et une infrastructure solide sont indispensables pour maintenir un crawl optimal.

La gestion technique de ces problématiques nécessite une expertise transversale entre SEO, développement et infrastructure serveur. Les diagnostics peuvent être complexes, notamment pour identifier les causes profondes des erreurs et dimensionner correctement votre architecture. Faire appel à une agence SEO spécialisée disposant de compétences techniques avancées peut s'avérer judicieux pour mettre en place un monitoring efficace et corriger durablement ces problématiques qui affectent votre crawl budget.

💬 Commentaires (0)

Soyez le premier à commenter.