Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que la note de qualité globale d'un site selon Google ?

Google attribue une note de qualité globale à chaque source d'informations en se basant uniquement sur les pages présentes dans son index. Cette évaluation détermine la crédibilité et l'autorité de votre domaine dans son ensemble.

Si votre index contient massivement du contenu dupliqué, cela peut diluer cette note de qualité. Google analyse la proportion de contenu original versus dupliqué pour évaluer la valeur ajoutée de votre site.

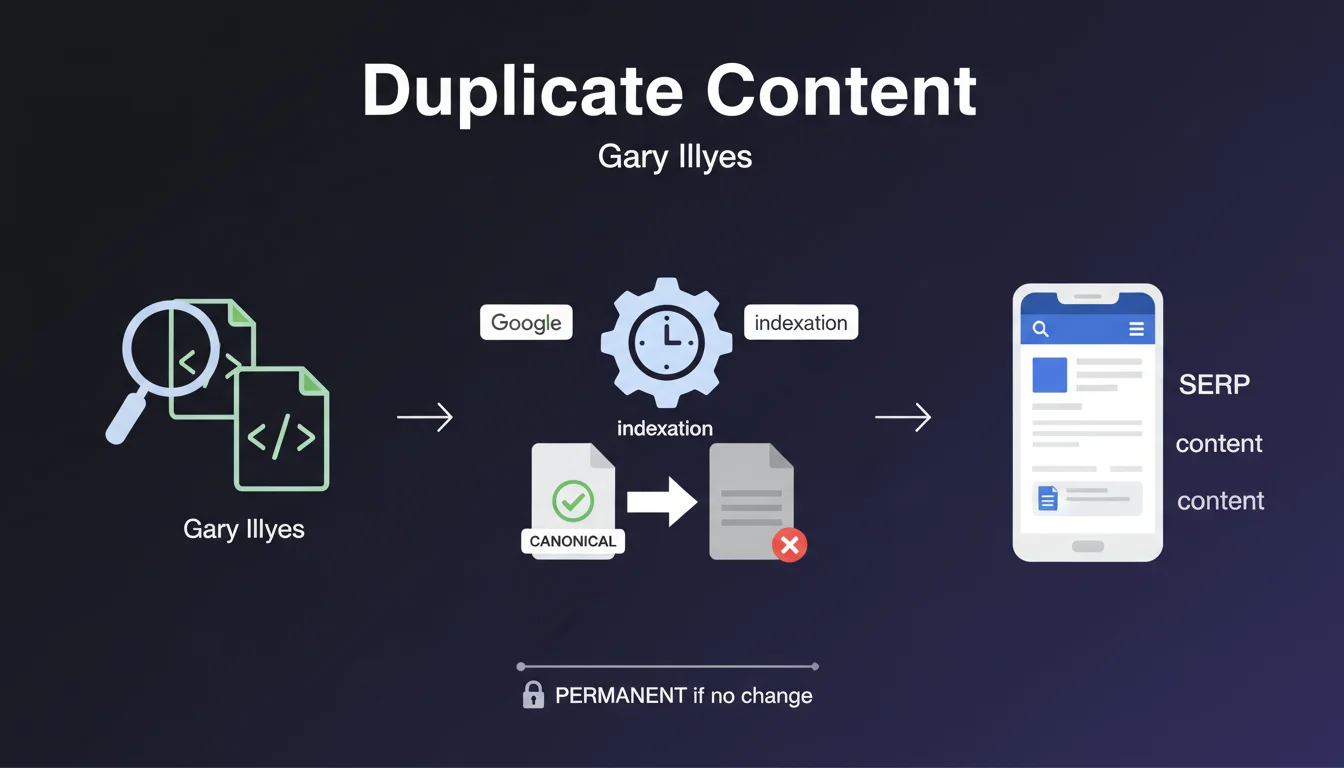

Pourquoi la balise canonical est-elle préférable au noindex pour le duplicate content ?

La balise canonical indique à Google quelle version d'une page doit être considérée comme la référence. Contrairement au noindex, elle permet de transférer le jus SEO (équité des liens) de la page dupliquée vers la page canonique.

Avec le noindex ou le robots.txt, les signaux positifs (backlinks, autorité) sont perdus. La page disparaît de l'index sans rediriger sa valeur, ce qui représente un gaspillage de potentiel SEO.

Quels sont les avantages concrets de cette approche ?

L'utilisation de la canonical présente plusieurs bénéfices stratégiques pour votre référencement naturel. Elle consolide vos signaux SEO au lieu de les disperser.

- Conservation du PageRank : les liens pointant vers les pages dupliquées sont consolidés vers la page canonique

- Amélioration de la note de qualité : Google comprend votre structure et ne pénalise pas la duplication technique

- Meilleure efficacité du crawl : Google identifie plus rapidement les pages prioritaires

- Réduction du contenu dupliqué dans l'index sans perdre de valeur SEO

Avis d'un expert SEO

Cette recommandation est-elle applicable dans tous les contextes ?

La recommandation de Google est théoriquement solide mais nécessite des nuances importantes selon votre contexte. Sur un site de quelques centaines de pages, l'approche canonical est effectivement optimale.

Cependant, sur des sites de plusieurs dizaines de milliers de pages avec du duplicate massif (e-commerce, sites à facettes), le tableau change radicalement. Le crawl de milliers de pages dupliquées consomme énormément de budget de crawl, même avec des canonicals.

Quels arbitrages faut-il faire entre conservation du jus SEO et budget crawl ?

La réalité du terrain impose souvent des compromis pragmatiques. Si vos pages dupliquées reçoivent peu ou pas de backlinks externes, leur valeur SEO transférable est négligeable.

Dans ce cas, bloquer le crawl via robots.txt ou utiliser le noindex devient plus pertinent pour préserver votre budget crawl pour les pages importantes. L'équation change selon le volume de pages, leur popularité et votre fréquence de mise à jour.

Dans quelles situations faut-il déroger à cette règle ?

Plusieurs scénarios justifient une approche différente de la simple canonical. Les sites e-commerce avec filtres génèrent souvent des milliers de combinaisons de pages.

Pour ces cas, une approche hybride est recommandée : canonical pour les variations proches, noindex pour les combinaisons éloignées, et robots.txt pour les paramètres sans valeur. L'analyse de vos logs serveur devient indispensable pour prendre les bonnes décisions.

Impact pratique et recommandations

Comment auditer et traiter le duplicate content sur votre site ?

Commencez par identifier toutes les sources de duplication sur votre site. Utilisez des outils comme Screaming Frog, Oncrawl ou les logs serveur pour cartographier l'ampleur du problème.

Analysez ensuite le profil de liens de vos pages dupliquées. Si elles reçoivent des backlinks, privilégiez la canonical. Si elles n'en reçoivent pas et sont nombreuses, envisagez le noindex.

- Effectuer un crawl complet pour identifier les pages en duplicate

- Analyser le profil de backlinks de chaque groupe de pages dupliquées

- Évaluer votre budget crawl via la Search Console (statistiques d'exploration)

- Vérifier le ratio pages crawlées / pages indexées

- Implémenter les canonicals sur les pages à forte valeur de liens

- Utiliser le noindex pour les pages sans backlinks et à faible valeur

Quelle stratégie adopter selon la taille de votre site ?

Pour les petits sites (moins de 1000 pages), utilisez systématiquement la balise canonical. Le budget crawl n'est pas un problème et vous maximisez la consolidation du jus SEO.

Pour les sites moyens à gros (plus de 10 000 pages), adoptez une approche segmentée. Canonical pour les duplications à valeur ajoutée, noindex pour le reste, et monitoring régulier du budget crawl.

Quelles erreurs techniques faut-il absolument éviter ?

Ne jamais mélanger canonical et noindex sur la même page, cela crée des directives contradictoires. Google suivra généralement le noindex et ignorera la canonical, perdant ainsi le transfert de jus SEO.

Évitez les chaînes de canonicals (page A canonical vers B, B canonical vers C). Google peut ne pas suivre toute la chaîne. Pointez toujours directement vers la page finale.

- Ne pas utiliser canonical ET noindex simultanément

- Éviter les canonicals en chaîne (A→B→C)

- Ne pas bloquer en robots.txt des pages avec canonical

- Vérifier que les URLs canoniques sont accessibles (pas de 404)

- S'assurer que les canonicals pointent vers des pages indexables

💬 Commentaires (0)

Soyez le premier à commenter.