Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Le CLS est-il vraiment un facteur de classement Google à part entière ?

- □ Vos images sabotent-elles votre CLS sans que vous le sachiez ?

- □ Faut-il vraiment spécifier les dimensions des images pour corriger le CLS ?

- □ Pourquoi le Chrome User Experience Report change-t-il la donne pour mesurer les performances réelles de votre site ?

- □ Le LCP mesure-t-il vraiment la vitesse d'affichage du contenu principal ?

- □ Faut-il vraiment prioriser le chargement de vos images héros pour améliorer le LCP ?

- □ Faut-il vraiment désactiver le lazy loading sur les images above the fold ?

- □ Pourquoi PageSpeed Insights est-il l'outil de performance à privilégier pour le SEO ?

- □ HTTP/2 peut-il vraiment booster les performances de votre site sans refonte technique ?

- □ Faut-il vraiment passer toutes ses images en WebP pour le SEO ?

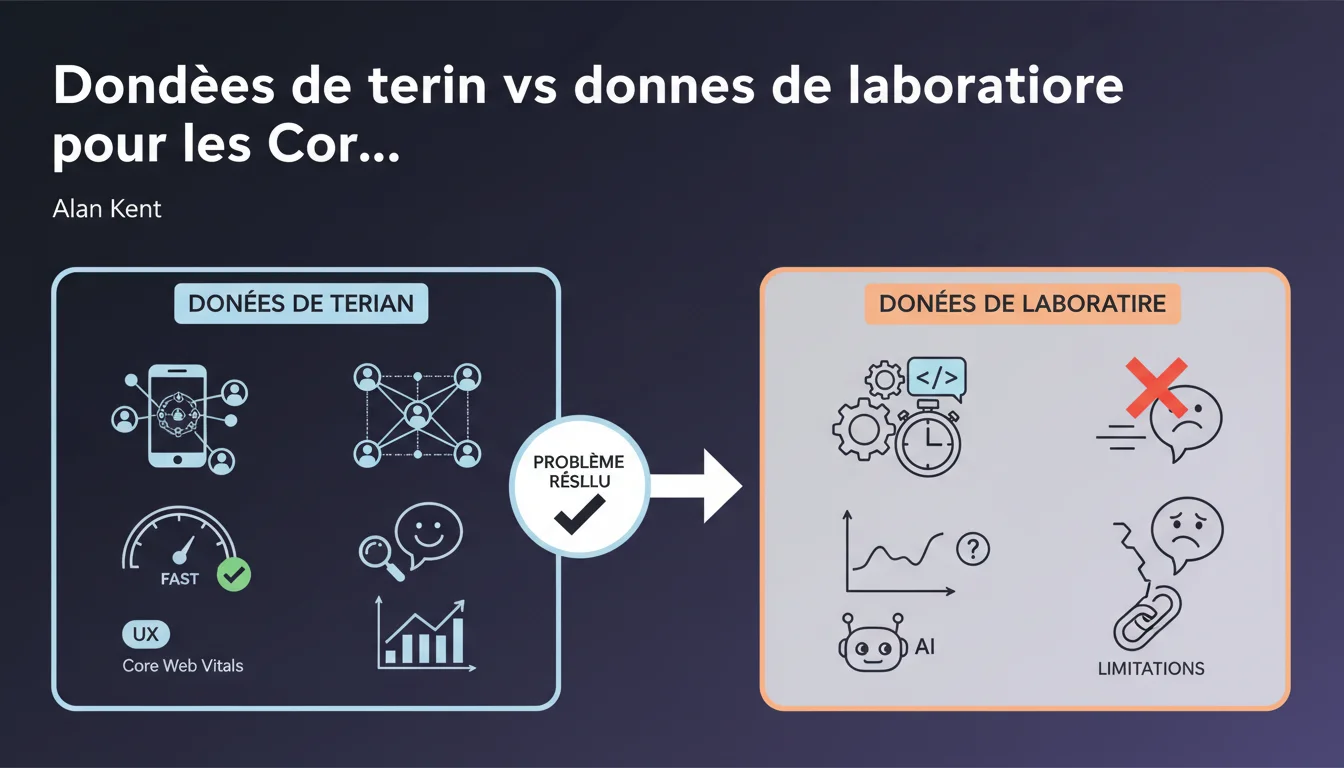

Google affirme que seules les données de terrain (field data) prouvent qu'un problème de performance est réellement résolu pour les utilisateurs finaux. Les données de laboratoire, bien qu'utiles pour diagnostiquer, ne reflètent pas les conditions réelles d'utilisation et peuvent induire en erreur sur l'impact réel de vos optimisations.

Ce qu'il faut comprendre

Quelle différence entre données de terrain et données de laboratoire ?

Les données de terrain (field data) proviennent d'utilisateurs réels naviguant sur votre site avec leurs appareils, connexions et contextes d'usage variés. Google les collecte via le Chrome User Experience Report (CrUX) et c'est ce dataset qui détermine votre classement pour les Core Web Vitals.

Les données de laboratoire (lab data) sont générées dans un environnement contrôlé — typiquement via Lighthouse, PageSpeed Insights ou WebPageTest. Même appareil, même connexion, mêmes conditions à chaque test.

Pourquoi Google insiste-t-il sur cette distinction ?

La raison est brutale : vous pouvez avoir un score Lighthouse parfait et des métriques terrain catastrophiques. Un utilisateur avec un smartphone bas de gamme sur de la 3G ne vit pas la même expérience que votre environnement de test calibré.

Google veut que vous optimisiez pour l'expérience réelle, pas pour satisfaire un outil de diagnostic. Les données de terrain incluent la diversité des appareils, des réseaux, des extensions navigateur, du cache — tout ce qui fait qu'un site fonctionne différemment selon qui le visite.

Comment accéder à ces données de terrain ?

Le CrUX est la source canonique. Accessible via PageSpeed Insights (section "Découvrir ce que vivent les utilisateurs réels"), la Search Console (rapport Core Web Vitals), ou directement via BigQuery pour les analyses avancées.

Vous pouvez aussi implémenter le Real User Monitoring (RUM) avec des outils comme web-vitals.js pour collecter vos propres métriques terrain et comprendre précisément où ça coince pour vos segments d'utilisateurs.

- Les données CrUX reflètent les 28 derniers jours d'expérience utilisateur réelle

- Les données de laboratoire sont un point de départ pour diagnostiquer, jamais une fin en soi

- Un site peut réussir en labo et échouer en production si l'optimisation ne tient pas compte des conditions réelles

- Le seuil "bon" des Core Web Vitals (75e percentile) est calculé sur les données terrain uniquement

Avis d'un expert SEO

Cette distinction est-elle vraiment nouvelle pour les praticiens SEO ?

Soyons honnêtes : tout SEO qui a déjà optimisé sérieusement les Core Web Vitals connaît cette différence. Le problème, c'est que beaucoup de clients et même certains professionnels restent fixés sur les scores Lighthouse — parce que c'est visuel, immédiat, et facile à présenter dans un reporting.

Alan Kent rappelle une évidence que le marché oublie trop souvent : Lighthouse ne fait pas ranker. Ce qui compte pour le classement Google, c'est le CrUX. Point final.

Les données de laboratoire sont-elles pour autant inutiles ?

Non — et c'est là que la déclaration pourrait induire en erreur si on la lit trop vite. Les données de labo sont indispensables pour diagnostiquer les problèmes détectés dans les données terrain. Vous voyez un LCP catastrophique dans CrUX ? Lighthouse vous aide à identifier le goulot : ressource bloquante, image non optimisée, serveur lent.

Mais — et c'est crucial — une fois que vous avez corrigé selon Lighthouse, vous devez vérifier dans CrUX que ça a eu l'effet escompté. Si vos utilisateurs sont majoritairement sur mobile avec connexions faibles, votre optimisation qui fonctionne en labo peut rester invisible dans les métriques réelles.

Quelles sont les limites pratiques de cette approche ?

Le CrUX a un délai de latence de 28 jours. Vous déployez une optimisation aujourd'hui ? Vous ne verrez l'impact complet qu'un mois plus tard. Pour les sites à faible trafic, les données CrUX peuvent être inexistantes ou non représentatives.

C'est là qu'un RUM maison devient pertinent : vous obtenez des données terrain en temps réel, segmentées comme vous le souhaitez. Mais attention — vos propres métriques RUM ne remplacent pas CrUX pour le classement Google. [À vérifier] : Google n'a jamais confirmé s'il pondère différemment les données CrUX selon le volume de trafic d'un site.

Impact pratique et recommandations

Comment prioriser les optimisations avec cette logique ?

Commencez toujours par les données CrUX pour identifier les pages problématiques. La Search Console vous indique précisément quelles URLs échouent sur quelles métriques — c'est votre point de départ.

Ensuite, utilisez Lighthouse ou PageSpeed Insights en mode laboratoire pour diagnostiquer les causes sur ces pages spécifiques. Mais ne vous arrêtez pas au diagnostic : implémentez la correction, attendez la mise à jour CrUX, et validez que le problème est résolu pour les utilisateurs réels.

Quels pièges éviter dans cette démarche ?

Ne pas sur-optimiser pour des cas d'usage qui ne représentent pas votre audience réelle. Si 90% de vos visiteurs sont sur desktop avec fibre, inutile de passer des semaines à optimiser pour un Moto G4 sur 3G lente — sauf si vous visez un marché émergent.

Autre erreur classique : ignorer la distribution des métriques. Le 75e percentile CrUX peut être "bon" tout en ayant 25% d'utilisateurs avec une expérience catastrophique. Analysez les percentiles complets dans BigQuery pour comprendre où sont vos vrais problèmes.

Que faut-il mettre en place concrètement ?

- Configurer un accès au CrUX via BigQuery pour analyser les distributions complètes de métriques

- Implémenter un RUM avec web-vitals.js pour monitorer en temps réel et segmenter par type d'appareil, région, etc.

- Créer un workflow : CrUX (identification) → Lighthouse (diagnostic) → correction → validation CrUX

- Segmenter vos optimisations par type de page et audience cible — un produit e-commerce n'a pas les mêmes enjeux qu'un article de blog

- Automatiser les alertes sur les régressions CrUX pour détecter rapidement un déploiement qui dégrade les performances réelles

❓ Questions frequentes

Les données CrUX sont-elles disponibles pour tous les sites ?

Peut-on améliorer les Core Web Vitals sans toucher au code ?

Quelle est la latence entre une optimisation déployée et son impact visible dans CrUX ?

Les données de laboratoire peuvent-elles être meilleures que les données terrain ?

Le RUM remplace-t-il les données CrUX pour le classement Google ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 06/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.