Declaration officielle

Ce qu'il faut comprendre

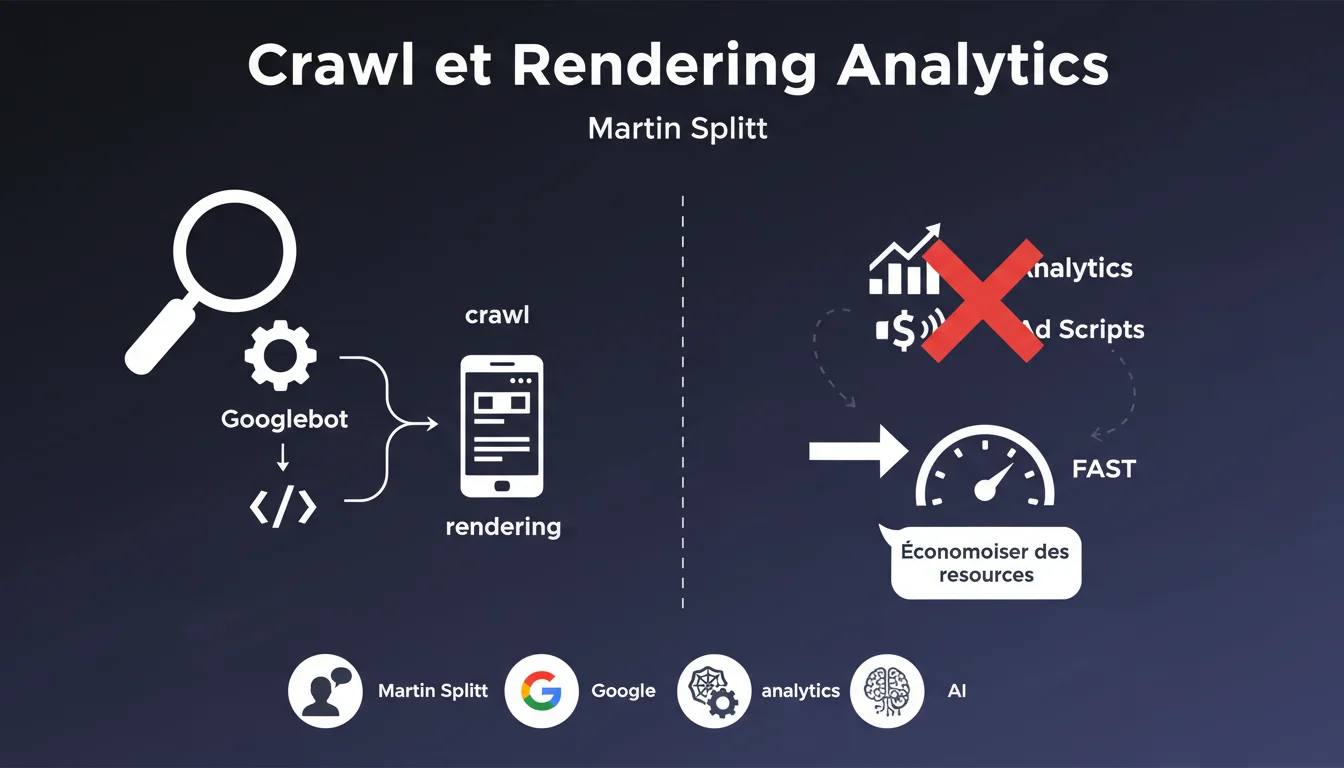

Que fait réellement Googlebot avec les scripts Analytics et publicitaires ?

Google a confirmé officiellement que Googlebot ignore volontairement les scripts Analytics et publicitaires lors des phases de crawl et de rendering. Cette décision est purement technique et vise à économiser des ressources.

Lorsque Googlebot explore et interprète le JavaScript d'une page, il identifie ces scripts tiers et choisit de ne pas les exécuter. Cela signifie que vos tags Google Analytics, Facebook Pixel ou scripts AdSense ne sont jamais déclenchés par le robot de Google.

Pourquoi Google prend-il cette décision technique ?

La raison est avant tout une question d'optimisation des ressources de crawl. Exécuter des scripts Analytics ou publicitaires ne fournirait aucune information utile à Google pour comprendre et indexer votre contenu.

Ces scripts génèrent des appels vers des serveurs tiers, consomment du temps de traitement et n'ajoutent rien à la compréhension sémantique de la page. Google préfère donc concentrer ses ressources sur le contenu réellement pertinent pour l'indexation.

Quelle différence entre crawl et rendering dans ce contexte ?

Le crawl est la phase où Googlebot télécharge le HTML de votre page. Le rendering est la phase où il exécute le JavaScript pour voir la page comme un utilisateur.

Cette déclaration concerne les deux phases : même pendant le rendering, où Google exécute normalement le JavaScript, il fait une exception pour les scripts Analytics et publicitaires. C'est une optimisation intelligente du budget de crawl.

- Googlebot identifie automatiquement les scripts Analytics et publicitaires

- Ces scripts ne sont pas exécutés pendant le crawl ni le rendering

- Cette approche économise des ressources de crawl précieuses

- Le contenu réel de votre page reste prioritaire pour Google

- Vos données Analytics ne sont pas affectées car elles proviennent des vrais utilisateurs

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. En tant qu'expert SEO, j'observe depuis des années que les données Analytics ne reflètent jamais les passages de Googlebot. Cette confirmation officielle valide ce que nous constations empiriquement.

Cette approche démontre aussi la maturité technique de Google dans la gestion du JavaScript. Le moteur est capable d'identifier précisément la nature des scripts et de prioriser intelligemment ce qu'il doit exécuter ou non.

Quelles nuances importantes faut-il apporter à cette annonce ?

Il est crucial de comprendre que Google parle ici de scripts à vocation purement Analytics ou publicitaire. Cela ne concerne pas tous les scripts tiers de votre site.

Si un script Analytics charge également du contenu visible pour l'utilisateur ou modifie la structure de la page, Google pourrait l'exécuter partiellement. La distinction se fait sur la fonction principale identifiée par Googlebot.

Cette règle s'applique-t-elle à tous les types de scripts tiers ?

Non, cette règle concerne spécifiquement les scripts Analytics et publicitaires. Les autres scripts tiers qui affectent le contenu, la navigation ou la structure de la page sont normalement exécutés par Googlebot.

Par exemple, un script de système de commentaires, de chat en ligne ou de recommandations de produits sera probablement exécuté s'il génère du contenu indexable. La distinction se fait sur l'impact potentiel sur la compréhension du contenu par Google.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

D'abord, ne supprimez surtout pas vos scripts Analytics. Ils sont essentiels pour mesurer votre trafic réel et comprendre le comportement de vos visiteurs. Google les ignore, mais vos utilisateurs déclenchent bien ces scripts.

Ensuite, optimisez votre stratégie de chargement des scripts. Utilisez le chargement asynchrone ou différé pour les scripts Analytics et publicitaires afin de ne pas bloquer le rendering initial de votre contenu principal.

Concentrez-vous sur ce qui compte vraiment : le contenu accessible et la structure de votre page. Puisque Google ignore ces scripts, assurez-vous que votre contenu principal soit immédiatement disponible dans le HTML ou via du JavaScript critique.

Quelles erreurs techniques faut-il absolument éviter ?

L'erreur classique serait de conditionner l'affichage de contenu important à l'exécution d'un script Analytics. Si votre contenu dépend d'un événement déclenché par un script que Google ignore, il ne sera jamais indexé.

Évitez également de surcharger vos pages sous prétexte que Google n'exécute pas ces scripts. Le temps de chargement reste un facteur de ranking, et l'expérience utilisateur est mesurée via les Core Web Vitals.

- Vérifiez que votre contenu principal est accessible sans dépendre de scripts Analytics

- Implémentez le chargement asynchrone pour tous les scripts Analytics et publicitaires

- Testez votre site avec l'outil de test des URL de la Search Console

- Analysez vos Core Web Vitals pour identifier l'impact des scripts tiers sur les performances

- Auditez vos scripts pour identifier ceux qui sont vraiment nécessaires au rendering

- Utilisez des attributs async ou defer sur vos balises script Analytics

- Surveillez votre budget de crawl pour optimiser la fréquence de passage de Googlebot

Comment vérifier que votre site est correctement optimisé ?

Utilisez la Search Console et l'outil d'inspection d'URL pour voir exactement ce que Google rend de vos pages. Comparez avec ce que vous voyez dans votre navigateur pour identifier les éventuelles différences.

Analysez vos fichiers de logs serveur pour comprendre le comportement réel de Googlebot sur votre site. Vous pourrez ainsi optimiser la distribution de votre budget de crawl sur les pages vraiment importantes.

💬 Commentaires (0)

Soyez le premier à commenter.