Declaration officielle

Ce qu'il faut comprendre

Pourquoi cette idée reçue persiste-t-elle dans la communauté SEO ?

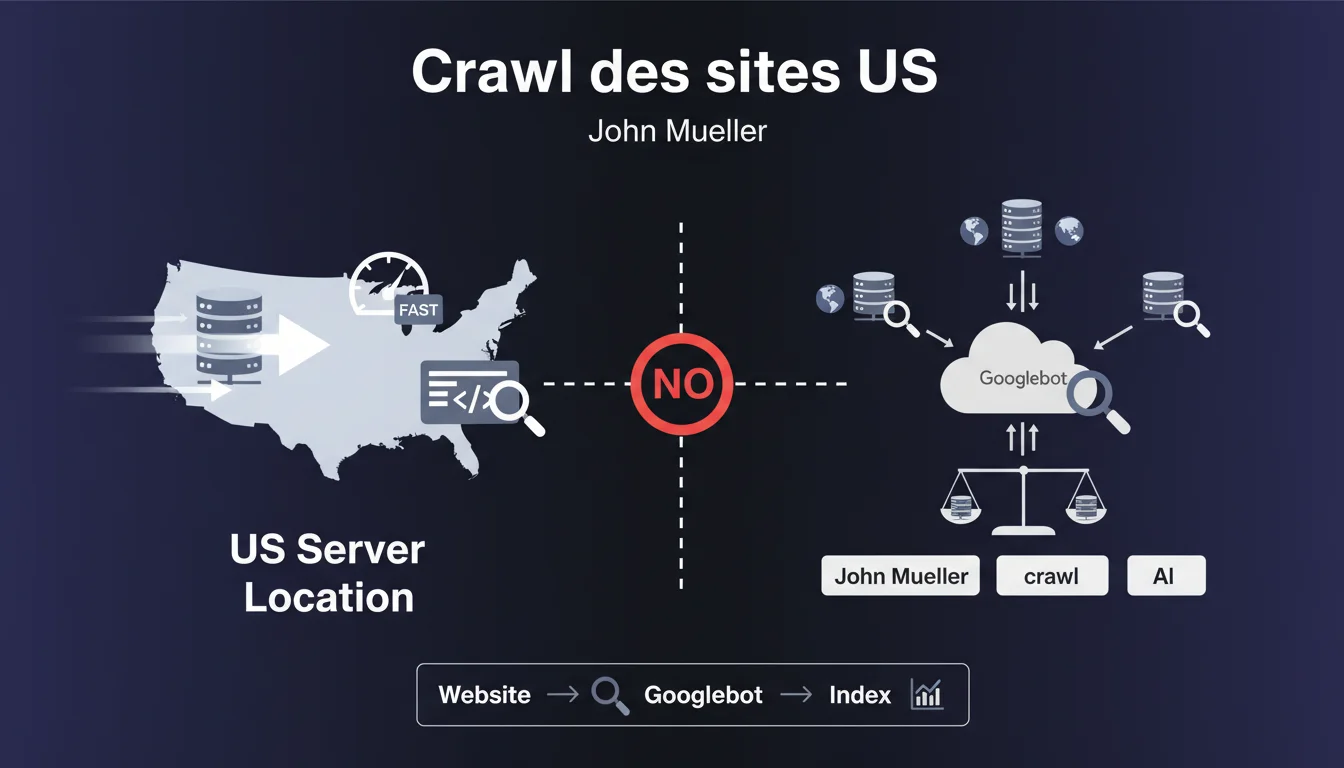

De nombreux professionnels du référencement pensent encore que l'emplacement géographique du serveur influence la vitesse et la fréquence de crawl par Googlebot. Cette croyance vient notamment de l'époque où Google était principalement basé aux États-Unis.

Certains pensaient qu'un hébergement américain réduirait la latence avec les serveurs de Google et favoriserait ainsi un crawl plus rapide. Pourtant, cette hypothèse ne reflète pas la réalité technique de l'infrastructure moderne de Google.

Qu'est-ce que Google priorise réellement pour le crawl ?

Google a confirmé que la géolocalisation du serveur n'est pas un critère de priorisation pour le crawl. Les robots d'exploration de Google sont distribués mondialement dans de nombreux datacenters.

Ce qui compte vraiment, c'est la fréquence de mise à jour du contenu et le PageRank (ou plus précisément l'autorité globale du site). Un site régulièrement mis à jour avec une bonne autorité sera crawlé fréquemment, peu importe où il est hébergé.

Quels sont les vrais facteurs qui influencent le crawl budget ?

Le crawl budget alloué à un site dépend principalement de trois facteurs : la popularité du site, la fraîcheur du contenu, et la santé technique globale.

- L'autorité du domaine : plus votre site a de backlinks de qualité et d'autorité, plus Google le crawle fréquemment

- La fréquence de mise à jour : un site qui publie régulièrement du nouveau contenu incite Google à revenir plus souvent

- La qualité technique : temps de réponse du serveur, absence d'erreurs, architecture claire favorisent un crawl efficace

- La pertinence du contenu : le contenu de qualité et utile encourage Google à explorer davantage de pages

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Après 15 ans d'expérience sur des centaines de sites internationaux, j'observe que l'emplacement géographique de l'hébergement n'a aucun impact mesurable sur la fréquence de crawl. Des sites hébergés en Europe ou en Asie sont crawlés aussi efficacement que des sites américains.

Ce qui fait vraiment la différence, c'est la performance globale du serveur (temps de réponse) et non sa localisation. Un serveur européen rapide surpassera toujours un serveur américain lent en termes d'efficacité de crawl.

Quelles nuances faut-il apporter à cette affirmation ?

La localisation du serveur n'influence pas le crawl, mais elle peut avoir un impact léger sur le référencement géolocalisé. Google utilise d'autres signaux pour déterminer la cible géographique d'un site : extension du domaine (.fr, .de, .co.uk), paramètres Search Console, et contenu linguistique.

Par ailleurs, la latence réseau entre le serveur et les utilisateurs finaux peut affecter l'expérience utilisateur et donc indirectement le SEO via les Core Web Vitals. Un CDN (Content Delivery Network) résout cette problématique bien mieux qu'un simple changement d'hébergement.

Dans quels cas la localisation du serveur pourrait-elle quand même avoir une importance ?

Pour les sites avec un public exclusivement local et des exigences de conformité légale (RGPD, souveraineté des données), héberger localement peut être pertinent. Mais c'est une décision juridique et business, pas SEO.

Pour les sites de e-commerce internationaux, utiliser un CDN avec plusieurs points de présence géographiques optimise la vitesse de chargement pour tous les utilisateurs, ce qui améliore l'expérience et peut indirectement bénéficier au référencement.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl de son site ?

Plutôt que de déménager votre hébergement aux États-Unis, concentrez-vous sur des optimisations réellement efficaces. Améliorez la vitesse de réponse de votre serveur actuel et optimisez votre architecture technique.

Investissez dans un hébergement performant avec des temps de réponse rapides (idéalement sous 200ms pour le TTFB). Assurez-vous que votre serveur peut gérer les pics de trafic du bot sans ralentissement.

Mettez en place une stratégie de contenu régulière qui donne à Google une raison de revenir fréquemment sur votre site. Plus vous publiez de contenu frais et pertinent, plus Google allouera de crawl budget.

Quelles erreurs éviter concernant l'hébergement et le crawl ?

N'investissez pas dans un changement d'hébergement géographique en espérant améliorer votre crawl. C'est une perte de temps et de ressources qui n'apportera aucun bénéfice mesurable.

Ne négligez pas le fichier robots.txt et le sitemap XML. Ces outils sont bien plus efficaces pour guider le crawl que n'importe quelle considération géographique.

Évitez les serveurs bas de gamme qui génèrent des erreurs 500 ou des timeouts. Un serveur instable, qu'il soit aux USA ou ailleurs, pénalisera votre crawl budget.

Comment vérifier et améliorer l'efficacité du crawl de votre site ?

- Analysez les statistiques d'exploration dans Google Search Console pour identifier les tendances de crawl

- Vérifiez que votre temps de réponse serveur (TTFB) est inférieur à 200-300ms depuis différentes localisations

- Optimisez votre architecture de liens internes pour faciliter la découverte de toutes vos pages importantes

- Supprimez les contenus dupliqués et de faible qualité qui gaspillent votre crawl budget

- Mettez à jour régulièrement votre sitemap XML et soumettez-le dans Search Console

- Configurez correctement votre robots.txt pour bloquer les sections inutiles (admin, recherche interne, etc.)

- Implémentez un CDN global si vous visez une audience internationale pour optimiser les performances

- Surveillez les erreurs d'exploration et corrigez rapidement les problèmes techniques détectés

💬 Commentaires (0)

Soyez le premier à commenter.