Declaration officielle

Ce qu'il faut comprendre

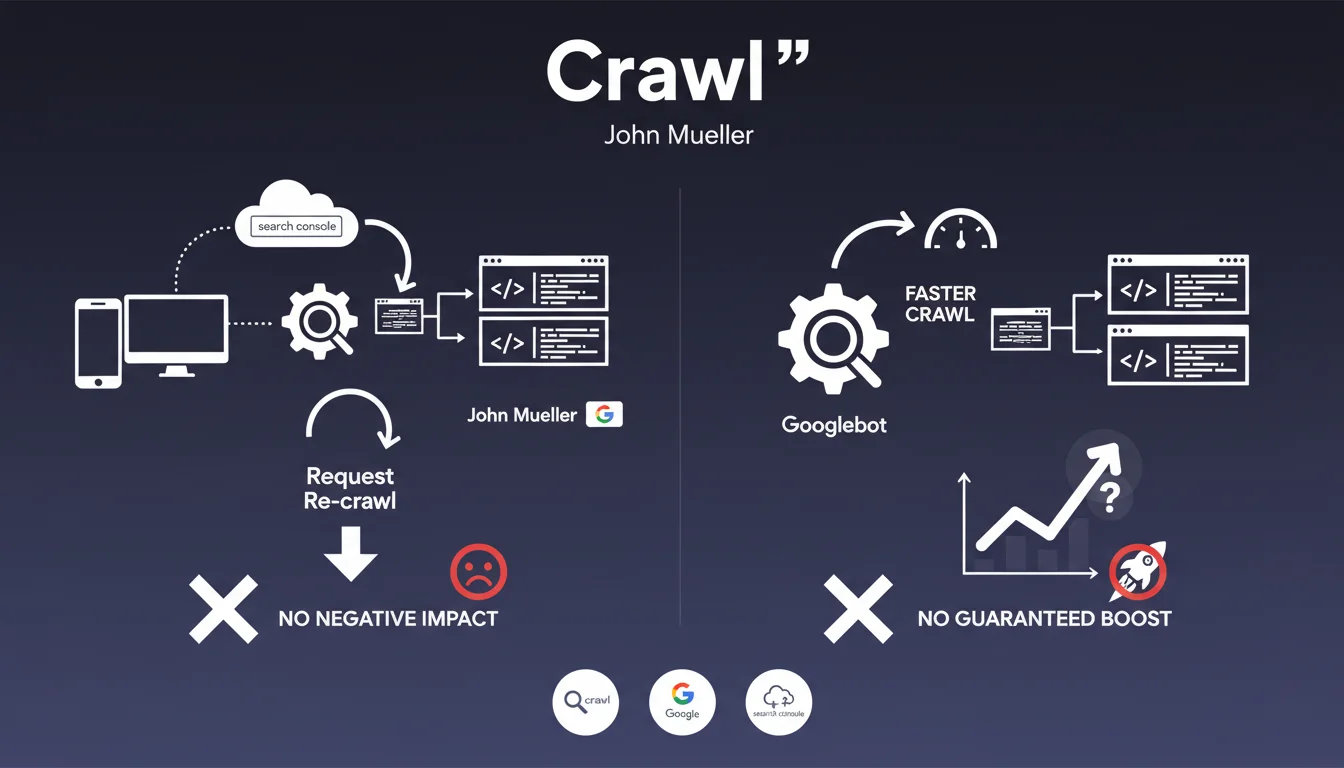

Google ne dispose pas de ressources infinies pour crawler le web. Le moteur de recherche doit donc prioriser son exploration en fonction de critères précis.

Cette déclaration confirme que Google attribue un budget de crawl différencié selon l'importance des pages. Les pages considérées comme stratégiques bénéficient d'un passage plus fréquent du Googlebot.

Concrètement, Google évalue la popularité d'une page via plusieurs signaux : le nombre et la qualité des liens internes et externes pointant vers elle, le trafic qu'elle génère, l'engagement des utilisateurs, et sa position dans l'architecture du site.

- Les pages populaires sont crawlées plus fréquemment pour détecter rapidement les changements

- Les pages profondes ou peu liées reçoivent moins de visites du Googlebot

- La fraîcheur du contenu influence également la fréquence de crawl

- L'architecture du site joue un rôle déterminant dans la distribution du budget de crawl

Avis d'un expert SEO

Cette déclaration reflète parfaitement ce que nous observons sur le terrain depuis des années. Les pages stratégiques d'un site (homepage, catégories principales, pages à fort trafic) sont effectivement crawlées quotidiennement, voire plusieurs fois par jour.

Une nuance importante : la popularité n'est pas le seul critère. La fréquence de mise à jour mentionnée dans le commentaire est cruciale. Un blog d'actualités mis à jour plusieurs fois par jour sera crawlé plus souvent qu'une page produit stable, même si cette dernière est plus populaire.

Il existe aussi des cas particuliers : les sites neufs avec peu d'autorité peinent à obtenir un crawl fréquent, même sur leurs pages principales. À l'inverse, les sites d'autorité bénéficient d'un budget de crawl généreux même sur leurs pages secondaires.

Impact pratique et recommandations

- Auditez votre maillage interne pour identifier les pages importantes qui reçoivent peu de liens internes

- Renforcez les liens internes vers vos pages stratégiques depuis la homepage et les pages à fort crawl

- Éliminez ou bloquez via robots.txt les pages à faible valeur qui consomment du budget de crawl inutilement

- Utilisez le fichier sitemap XML pour signaler vos pages prioritaires et leur fréquence de mise à jour

- Corrigez les erreurs 404 et redirections en chaîne qui gaspillent le budget de crawl

- Analysez vos logs serveur pour comprendre le comportement réel de Googlebot sur votre site

- Mettez à jour régulièrement vos contenus stratégiques pour inciter Google à les crawler plus souvent

- Optimisez la vitesse de chargement de votre serveur pour permettre à Google de crawler plus de pages

- Structurez votre architecture en privilégiant une profondeur maximale de 3-4 clics depuis la homepage

L'optimisation du budget de crawl nécessite une analyse technique approfondie croisant plusieurs sources de données : logs serveur, Search Console, outils de crawl, et analyse du maillage interne. Cette approche multidimensionnelle demande une expertise pointue et des outils spécialisés.

Pour les sites de moyenne et grande envergure, ces optimisations peuvent rapidement devenir complexes et chronophages. Faire appel à une agence SEO spécialisée peut s'avérer judicieux pour bénéficier d'un accompagnement personnalisé, d'analyses techniques poussées et d'une stratégie adaptée à votre contexte spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.