Declaration officielle

Ce qu'il faut comprendre

Que signifie réellement demander un recrawl à Google ?

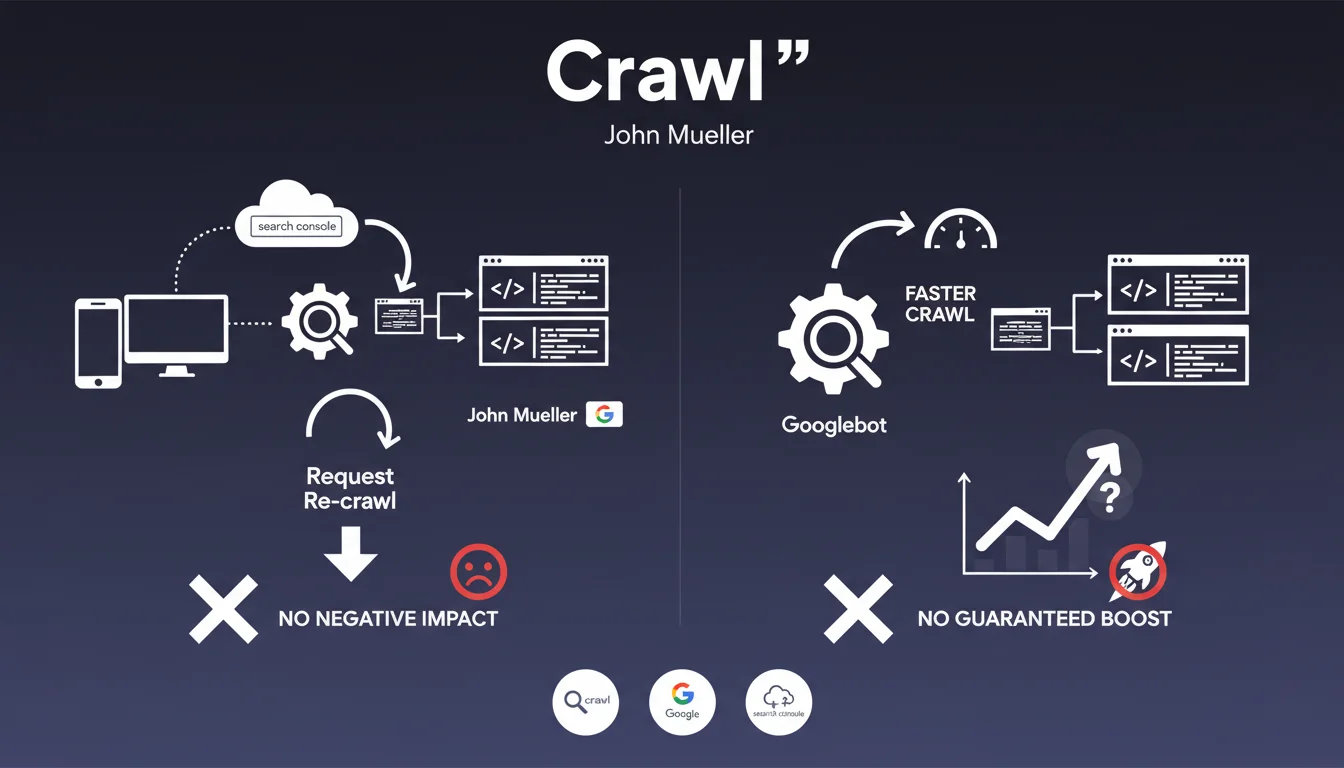

Lorsqu'on effectue des modifications importantes sur un site, il est possible de demander à Googlebot de revenir explorer les pages via la Search Console. Cette action permet d'accélérer la découverte de nouveaux contenus ou de mises à jour sans attendre le passage naturel des robots.

Contrairement à certaines idées reçues, cette demande de recrawl manuel ne constitue pas une manipulation du système. Google considère cette fonction comme un outil légitime mis à disposition des webmasters pour faciliter la communication avec le moteur de recherche.

Un crawl plus fréquent garantit-il un meilleur positionnement ?

La déclaration de John Mueller est claire sur ce point : il n'existe aucune corrélation automatique entre la fréquence de crawl et l'amélioration des positions. Un site peut être crawlé quotidiennement sans pour autant progresser dans les résultats de recherche.

La fréquence de crawl dépend principalement de la popularité du site, de sa fraîcheur éditoriale et de son budget crawl. Elle indique surtout que Google juge le site suffisamment important ou dynamique pour mériter des visites régulières.

Existe-t-il des risques à demander trop de recrawls ?

Selon cette déclaration officielle, demander un recrawl via la Search Console n'a aucun impact négatif sur le référencement. Il n'existe pas de pénalité pour avoir sollicité trop fréquemment cette fonctionnalité.

- Le recrawl manuel via Search Console est une pratique sans danger pour le site

- Une fréquence de crawl élevée n'implique pas automatiquement de meilleures positions

- Google distingue clairement crawl et évaluation qualitative du contenu

- Le budget crawl est alloué en fonction de l'autorité du site et de sa vélocité éditoriale

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Après 15 ans d'expérience, je confirme que cette position de Google correspond effectivement à ce que nous observons. De nombreux sites e-commerce avec des millions de pages sont crawlés intensivement sans pour autant dominer leur secteur, tandis que certains sites à faible fréquence de crawl maintiennent d'excellentes positions organiques.

Cette déclaration rappelle une distinction fondamentale : crawl et ranking sont deux processus distincts. Le premier concerne la découverte et l'indexation, le second l'évaluation qualitative et la pertinence. Confondre les deux mène à des stratégies SEO inefficaces.

Quelles nuances importantes faut-il apporter à cette déclaration ?

Si demander un recrawl n'est pas pénalisant, il faut comprendre que cela ne sert à rien si le contenu n'a pas changé significativement. Google détecte les modifications réelles et ignore les demandes superflues, ce qui peut diluer l'efficacité de vos futures sollicitations.

Par ailleurs, un crawl fréquent peut être le symptôme d'une architecture technique solide et d'une production de contenu régulière. Dans ce contexte indirect, il existe une corrélation avec de bonnes performances, mais ce n'est pas le crawl qui cause le succès.

Dans quels cas cette règle nécessite-t-elle une approche différente ?

Pour les sites d'actualité ou les plateformes temps-réel, la rapidité d'indexation devient critique. Dans ces cas spécifiques, optimiser pour un crawl plus fréquent via le plan du site XML dynamique et l'indexation instantanée présente un avantage compétitif réel.

Pour les très grands sites (plus de 100 000 pages), la gestion du budget crawl devient stratégique. Il ne s'agit pas d'augmenter la fréquence globale, mais d'orienter Googlebot vers les pages à forte valeur ajoutée en évitant le gaspillage sur des contenus faibles ou dupliqués.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Premièrement, cessez de considérer la demande de recrawl comme un levier de positionnement. Utilisez-la uniquement quand vous avez effectué des modifications substantielles : refonte de contenu, correction d'erreurs critiques, ajout de pages stratégiques.

Concentrez vos efforts sur ce qui influence réellement le ranking : la qualité du contenu, l'expérience utilisateur, l'autorité thématique et les signaux de performance. Le crawl suivra naturellement si ces fondamentaux sont solides.

Comment optimiser intelligemment son budget crawl ?

Analysez régulièrement les rapports de crawl dans la Search Console pour identifier les pages inutilement explorées. Bloquez via robots.txt les sections sans valeur SEO : paramètres de filtres, pages de remerciement, contenus dupliqués.

Améliorez la vitesse de réponse serveur et l'architecture interne pour permettre à Googlebot d'explorer plus efficacement vos contenus prioritaires. Un site techniquement performant obtient naturellement un meilleur budget crawl.

Quelles erreurs éviter absolument dans sa stratégie de crawl ?

Ne submergez pas la Search Console de demandes de recrawl quotidiennes pour les mêmes URLs sans changement réel. Cette pratique n'apporte aucun bénéfice et témoigne d'une incompréhension des mécanismes de Google.

Évitez de modifier artificiellement vos pages (date de publication, légers ajustements) dans le seul but de déclencher un recrawl. Google détecte les modifications substantielles et cette approche consomme des ressources sans résultat.

- Utilisez la demande de recrawl uniquement après des modifications significatives de contenu

- Surveillez la fréquence de crawl dans Search Console comme indicateur de santé technique, pas de performance SEO

- Optimisez votre budget crawl en bloquant les sections inutiles et en améliorant la performance serveur

- Concentrez 80% de vos efforts SEO sur la qualité du contenu et l'expérience utilisateur

- Analysez mensuellement les rapports de crawl pour détecter les anomalies techniques

- Créez un sitemap XML propre et mis à jour automatiquement pour guider efficacement Googlebot

- Réduisez la profondeur de vos pages stratégiques pour faciliter leur découverte

💬 Commentaires (0)

Soyez le premier à commenter.