Declaration officielle

Ce qu'il faut comprendre

D'où proviennent réellement les données Core Web Vitals utilisées par Google ?

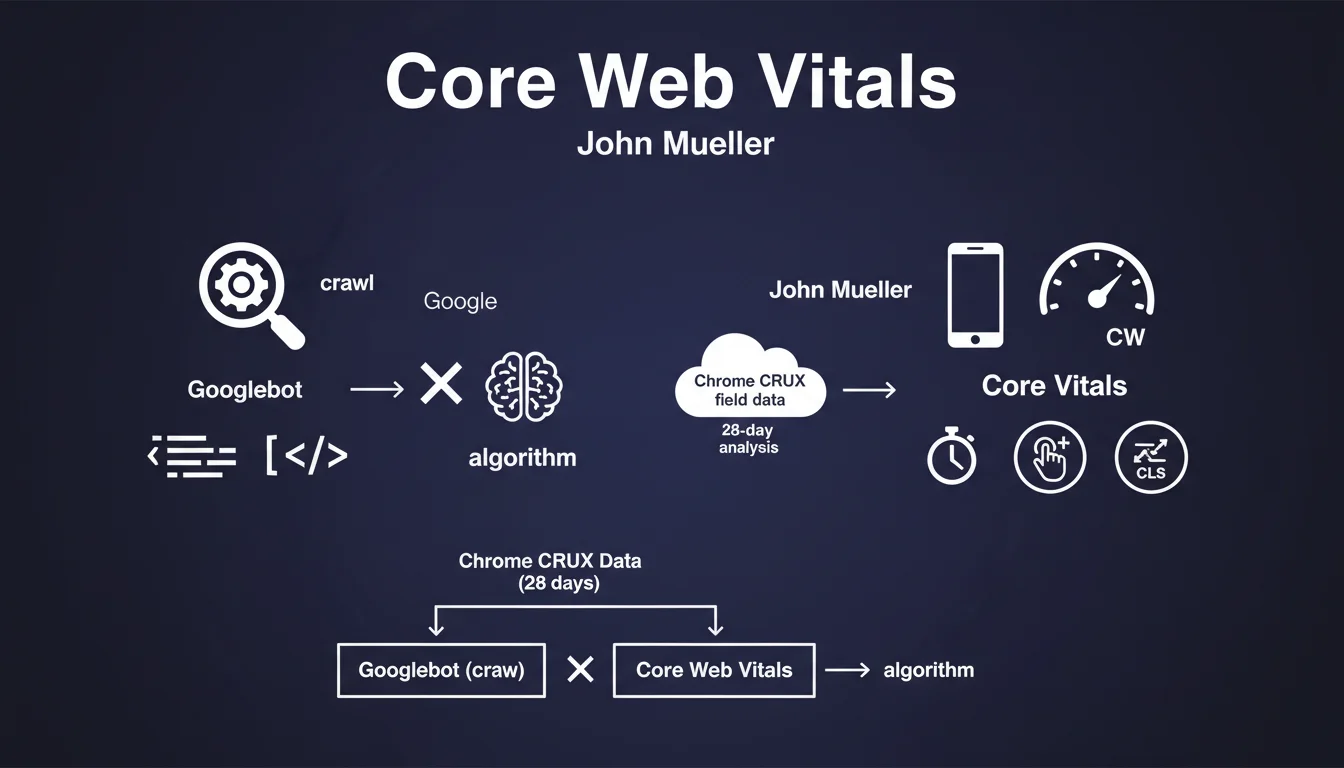

Google utilise exclusivement les données CrUX (Chrome User Experience Report) pour évaluer les Core Web Vitals dans son algorithme de ranking. Ces données proviennent des utilisateurs réels de Chrome qui visitent votre site au quotidien.

Contrairement à une idée reçue, Googlebot ne mesure pas les métriques CLS, LCP ou FID lors de son crawl. Le robot se concentre sur l'indexation du contenu et la compréhension de la structure du site, pas sur l'expérience utilisateur en temps réel.

Pourquoi cette distinction entre crawl et mesure d'expérience est-elle importante ?

Cette séparation signifie que vous ne pouvez pas « tromper » Google en optimisant uniquement pour le bot. Les performances réelles perçues par vos visiteurs sont ce qui compte pour le ranking.

Les données CrUX sont calculées sur une période glissante de 28 jours. Toute amélioration des Core Web Vitals mettra donc environ un mois avant de se refléter pleinement dans les données utilisées par Google.

- Les Core Web Vitals proviennent exclusivement du rapport CrUX basé sur les utilisateurs Chrome réels

- Googlebot ne collecte aucune donnée CWV durant son crawl

- Les métriques sont calculées sur une période de 28 jours glissants

- Seules les pages avec un trafic Chrome suffisant disposent de données CrUX

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Les tests montrent systématiquement que les améliorations CWV ne se reflètent dans Search Console qu'après 3 à 4 semaines. Cette latence correspond exactement à la fenêtre de 28 jours du rapport CrUX.

J'observe régulièrement des sites avec d'excellents scores en test synthétique (Lighthouse, PageSpeed Insights) mais des Core Web Vitals médiocres dans Search Console. La raison ? Leurs utilisateurs réels vivent une expérience dégradée due à des connexions lentes, des appareils bas de gamme ou des conditions réseau variables.

Quelles nuances faut-il apporter à cette affirmation ?

La principale subtilité concerne les sites à faible trafic. Si votre site ne reçoit pas suffisamment de visiteurs Chrome, Google ne disposera d'aucune donnée CrUX pour vos pages.

Dans ce cas, Google peut se rabattre sur les données au niveau de l'origine (domaine entier) plutôt que page par page. Pour les très petits sites sans données CrUX du tout, l'impact des Core Web Vitals sur le ranking reste marginal voire inexistant.

Dans quels cas cette distinction crawl/CrUX devient-elle critique ?

Cette séparation est cruciale lors de migrations de sites ou de refonte majeure. Vous pouvez avoir un crawl parfait de Googlebot mais des CWV catastrophiques pendant plusieurs semaines si la nouvelle version dégrade l'expérience utilisateur.

C'est également fondamental pour les sites avec rendu côté client (JavaScript). Googlebot peut parfaitement indexer le contenu rendu, mais si le JavaScript provoque des Layout Shifts ou ralentit le LCP pour les vrais utilisateurs, vos Core Web Vitals seront impactés négativement.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser les Core Web Vitals ?

Concentrez-vous sur l'expérience utilisateur réelle, pas uniquement sur les scores de test. Installez le Web Vitals JavaScript library pour monitorer les métriques de vos vrais visiteurs et identifier les problèmes que les tests synthétiques ne révèlent pas.

Consultez régulièrement la Search Console (section Expérience > Core Web Vitals) pour visualiser les données terrain. Priorisez les corrections sur les pages qui cumulent le plus de trafic et les plus mauvais scores CrUX.

Testez vos pages dans des conditions réalistes : connexion 3G/4G, appareils Android milieu de gamme, avec extensions Chrome activées. Les conditions de laboratoire ne reflètent jamais parfaitement la réalité de vos utilisateurs.

Quelles erreurs éviter absolument ?

Ne vous fiez pas uniquement aux scores Lighthouse à 100/100 en pensant que vos CWV sont optimaux. Ces tests synthétiques utilisent des conditions idéales qui ne correspondent pas à votre audience réelle.

N'attendez pas de résultats immédiats. Avec la fenêtre de 28 jours, vos optimisations mettront un mois complet avant d'être pleinement reflétées dans les données de ranking. Patience et monitoring continu sont essentiels.

Ne négligez pas les versions mobiles. Les données CrUX sont séparées entre desktop et mobile, et Google utilise prioritairement les métriques mobiles pour le ranking en mobile-first indexing.

Comment mettre en place un monitoring efficace des Core Web Vitals ?

- Configurez le suivi RUM (Real User Monitoring) avec la bibliothèque Web Vitals de Google ou un outil dédié

- Créez des alertes automatiques lorsque les métriques CWV se dégradent au-delà de seuils définis

- Analysez les données Search Console chaque semaine pour détecter les tendances négatives rapidement

- Segmentez vos analyses par type d'appareil, type de connexion et géolocalisation pour identifier les segments problématiques

- Comparez les données CrUX publiques (BigQuery) avec vos analytics pour comprendre les écarts entre différentes audiences

- Documentez chaque déploiement majeur et son impact sur les métriques terrain après 28 jours

- Testez régulièrement sur de vrais appareils représentatifs de votre audience (pas uniquement sur votre MacBook Pro)

En résumé : Les Core Web Vitals reposent exclusivement sur les données réelles d'utilisateurs Chrome (CrUX), pas sur le crawl de Googlebot. Cette distinction fondamentale change complètement l'approche d'optimisation.

Vous devez monitorer l'expérience réelle de vos visiteurs, accepter un délai de 28 jours avant de voir les améliorations, et prioriser les conditions réelles plutôt que les tests en laboratoire. L'optimisation des Core Web Vitals requiert une approche technique pointue combinant performance web, monitoring continu et analyse fine des données terrain.

Ces optimisations touchant à l'infrastructure, au code frontend et aux métriques utilisateur réelles peuvent s'avérer complexes à orchestrer. Pour garantir une approche méthodique et des résultats durables, faire appel à une agence SEO spécialisée en performance web vous permettra de bénéficier d'une expertise pointue et d'un accompagnement personnalisé adapté aux spécificités de votre site.

💬 Commentaires (0)

Soyez le premier à commenter.