Declaration officielle

Ce qu'il faut comprendre

Quelle est la position officielle de Google sur l'utilisation des cookies par son robot ?

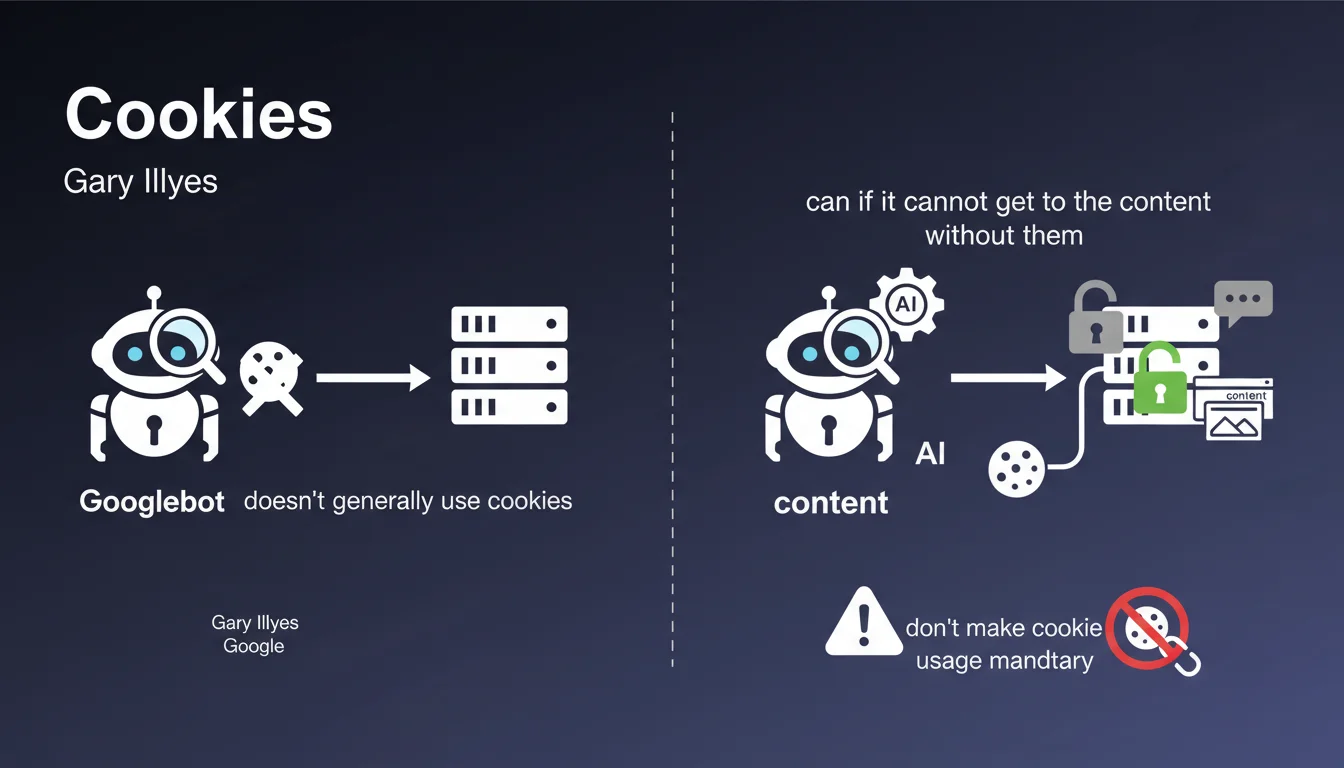

Gary Illyes a clairement indiqué que Googlebot n'utilise généralement pas les cookies lors de ses explorations. Cette approche s'inscrit dans la philosophie d'accessibilité universelle que Google prône depuis toujours.

Toutefois, une nuance importante existe : le robot dispose d'une capacité de détection intelligente. Si Googlebot identifie qu'un contenu est inaccessible sans cookies, il peut activer cette fonctionnalité pour y accéder.

Pourquoi Google a-t-il développé cette capacité de détection ?

Cette fonctionnalité représente un filet de sécurité technique pour les sites qui utilisent des cookies de manière excessive ou inappropriée. Google souhaite éviter de pénaliser injustement du contenu légitime.

Cependant, cette capacité ne doit pas être considérée comme une autorisation à utiliser les cookies comme barrière d'entrée. Elle constitue plutôt une solution de secours exceptionnelle.

Que signifie concrètement le concept d'« Opération Portes Ouvertes » ?

Cette expression illustre le principe fondamental du SEO : votre site doit être accessible sans friction pour les robots d'exploration. Aucun obstacle technique ne devrait entraver l'accès au contenu.

- Googlebot explore par défaut sans cookies, comme un visiteur en navigation privée

- Le robot peut activer les cookies si nécessaire, mais cette capacité ne justifie pas leur usage obligatoire

- L'accessibilité maximale reste la règle d'or pour optimiser l'indexation

- Un site bien conçu ne devrait jamais dépendre des cookies pour afficher son contenu principal

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Mon expérience de 15 ans confirme totalement cette position. Les sites qui dépendent des cookies pour afficher leur contenu rencontrent systématiquement des problèmes d'indexation. Les outils comme Google Search Console révèlent régulièrement des pages vides ou incomplètes.

La capacité de détection évoquée par Gary Illyes existe effectivement, mais elle fonctionne de manière imprévisible et peu fiable. Compter sur ce mécanisme revient à jouer à la roulette russe avec votre visibilité organique.

Quelles nuances faut-il apporter à cette déclaration ?

Il est crucial de distinguer les différents types de cookies. Les cookies de consentement RGPD, les cookies de session, ou les cookies marketing n'ont pas le même impact sur l'exploration.

Les cookies de session technique utilisés pour maintenir un état applicatif peuvent poser problème si le contenu en dépend. En revanche, les cookies de tracking analytics n'affectent généralement pas l'accessibilité du contenu.

Dans quels cas cette capacité de détection devient-elle insuffisante ?

Les sites e-commerce avec des mécanismes anti-bot sophistiqués peuvent bloquer Googlebot même avec les cookies activés. Les systèmes de sécurité qui analysent le comportement peuvent rejeter les requêtes robotiques.

De même, les sites utilisant des cookies avec des valeurs dynamiques complexes ou des mécanismes de rotation peuvent empêcher une exploration cohérente. Le robot ne peut pas simuler un parcours utilisateur complet avec clics, scrolls et interactions.

Impact pratique et recommandations

Que faut-il vérifier en priorité sur votre site ?

Commencez par tester votre site en navigation privée sans cookies. Ouvrez une fenêtre incognito et naviguez sur vos pages principales. Tout le contenu important doit être immédiatement visible.

Utilisez également l'outil d'inspection d'URL de Google Search Console. Cet outil vous montre exactement ce que Googlebot voit. Si des différences apparaissent avec la version normale, vous avez un problème de dépendance aux cookies.

Quelles erreurs techniques faut-il absolument éviter ?

Ne conditionnez jamais l'affichage de votre contenu principal à l'acceptation des cookies. Les bannières RGPD doivent être présentes, mais le contenu doit rester accessible en dessous.

Évitez les redirections ou les murs de contenu déclenchés par l'absence de cookies. Ces pratiques créent des barrières artificielles qui nuisent gravement à votre indexation.

- Testez systématiquement vos pages en navigation privée pour vérifier l'accessibilité du contenu

- Utilisez l'outil d'inspection d'URL dans Search Console pour valider ce que Googlebot perçoit réellement

- Configurez votre site pour que tout contenu public soit accessible sans cookies actifs

- Séparez clairement les fonctionnalités nécessitant des cookies (panier, compte utilisateur) du contenu informationnel

- Vérifiez que vos bannières de consentement n'empêchent pas l'accès au contenu sous-jacent

- Auditez vos logs serveur pour identifier les requêtes Googlebot rejetées ou recevant un contenu différent

- Implémentez le rendu côté serveur (SSR) pour les applications JavaScript dépendant de l'état session

Comment s'assurer d'une conformité optimale sur le long terme ?

Mettez en place un monitoring régulier de votre indexation. Comparez le nombre de pages publiées avec le nombre de pages indexées. Un écart significatif peut révéler un problème d'accessibilité.

Créez une routine d'audit technique trimestriel. Les mises à jour de frameworks ou de CMS peuvent introduire des dépendances involontaires aux cookies. Une vigilance continue est nécessaire.

💬 Commentaires (0)

Soyez le premier à commenter.