Declaration officielle

Ce qu'il faut comprendre

Pourquoi les équipes internes des moteurs ne comprennent-elles pas tout l'algorithme ?

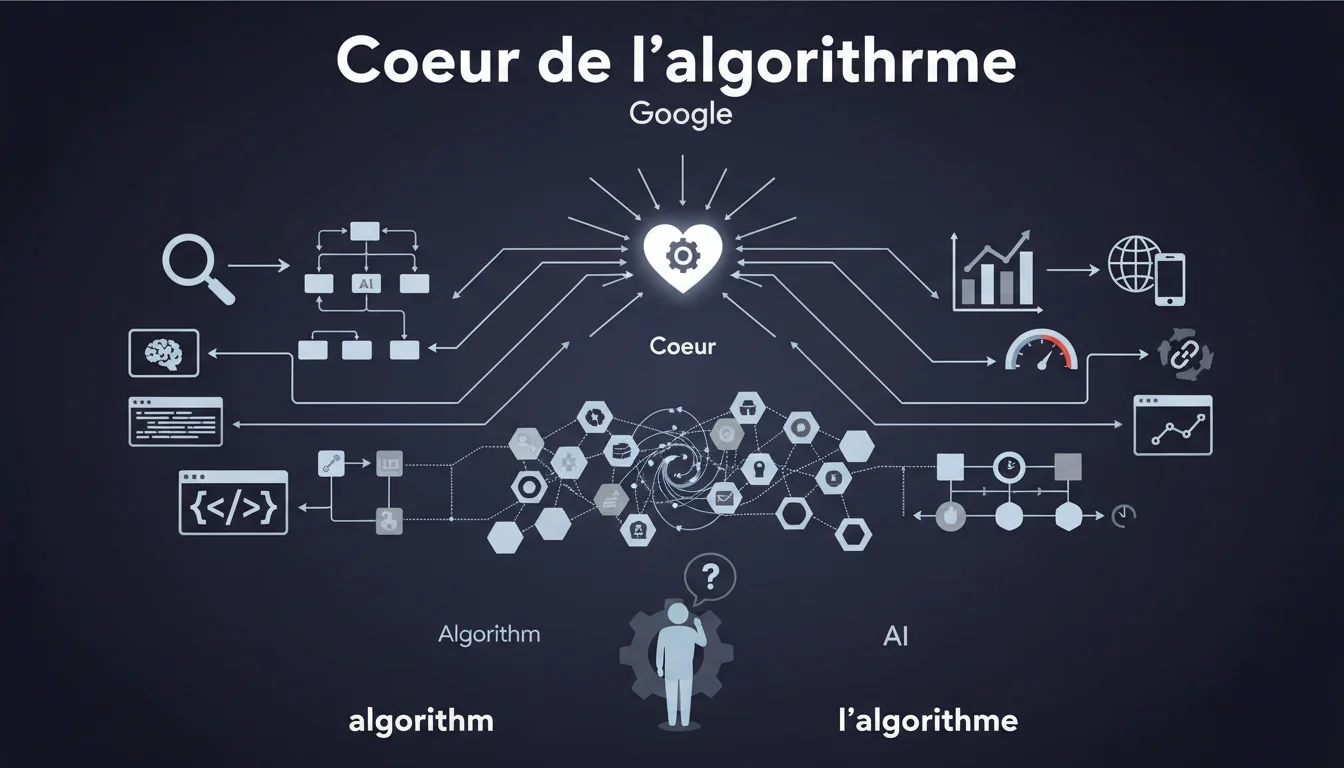

La déclaration de Frédéric Dubut de Bing révèle une réalité méconnue : très peu de personnes au sein des équipes possèdent une vision globale de l'algorithme de pertinence. Cette situation s'explique par la complexité extrême des systèmes modernes.

Chaque ingénieur travaille sur des composants spécialisés (crawl, indexation, ranking, qualité) sans nécessairement comprendre comment l'ensemble s'articule. Cette compartimentation est similaire chez Google, où des centaines de signaux interagissent.

Quel est l'impact du Machine Learning sur cette complexité ?

L'intégration du Machine Learning et de l'IA a considérablement augmenté l'opacité des algorithmes. Les modèles d'apprentissage automatique créent des corrélations que même leurs concepteurs ne peuvent expliquer précisément.

Cette "boîte noire" rend impossible une compréhension exhaustive, même pour les équipes internes. Les résultats sont observables et mesurables, mais les mécanismes décisionnels précis restent obscurs.

Pourquoi cette information est-elle importante pour les SEO ?

Cette révélation a des implications majeures pour notre pratique quotidienne du référencement. Elle confirme qu'il est illusoire de chercher à décoder complètement l'algorithme de Google.

- Aucun expert SEO ne peut prétendre connaître tous les détails du fonctionnement de Google

- Les employés de Google eux-mêmes n'ont qu'une vision partielle du système global

- Les tests et observations empiriques restent la meilleure approche pour comprendre le fonctionnement

- La transparence accrue de Bing offre des insights précieux applicables à tous les moteurs

- Les principes fondamentaux (pertinence, qualité, expérience utilisateur) demeurent universels

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce que nous observons sur le terrain ?

Absolument. En 15 ans de pratique SEO, j'ai constaté que les comportements de Google sont souvent contradictoires entre différentes verticales ou types de requêtes. Cela s'explique parfaitement si différentes équipes optimisent différents composants.

Les Core Updates provoquent des effets imprévisibles précisément parce qu'ils modifient l'équilibre entre des centaines de signaux interconnectés. Même Google ne peut anticiper tous les effets de bord de ces modifications majeures.

Quelles implications cette complexité a-t-elle sur les conseils SEO officiels ?

Cette réalité explique pourquoi les communications officielles de Google restent volontairement générales et axées sur les principes. Les porte-paroles ne peuvent détailler ce que même leurs équipes techniques ne maîtrisent pas complètement.

Les recommandations se concentrent sur des concepts universels (contenu de qualité, expérience utilisateur, E-E-A-T) car ce sont les seuls points de convergence compréhensibles. Les détails techniques échappent à la documentation exhaustive.

Pourquoi la transparence de Bing est-elle précieuse pour comprendre Google ?

Les communications récentes de Bing sont effectivement plus détaillées et techniques que celles de Google. Cette transparence accrue nous offre une fenêtre sur le fonctionnement général des moteurs de recherche modernes.

Bien que Google et Bing diffèrent dans leurs implémentations, ils partagent des principes architecturaux communs. Les insights de Bing permettent de formuler des hypothèses valides sur Google, tout en gardant à l'esprit les différences de parts de marché et d'approches.

Impact pratique et recommandations

Quelle stratégie SEO adopter face à cette complexité algorithmique ?

L'approche la plus efficace consiste à se concentrer sur les fondamentaux intemporels plutôt que de chercher à exploiter des failles algorithmiques. Les bases solides résistent aux fluctuations et mises à jour.

Privilégiez une stratégie holistique et qualitative : contenu répondant aux intentions de recherche, architecture technique optimale, autorité thématique, et expérience utilisateur exemplaire. Ces piliers transcendent les modifications algorithmiques.

Comment tester et mesurer efficacement sans connaître tous les paramètres ?

Adoptez une méthodologie scientifique basée sur l'observation. Documentez vos modifications, mesurez les impacts, et tirez des conclusions sur votre contexte spécifique.

Utilisez des outils d'analyse avancés (Search Console, analytics, crawlers) pour identifier les corrélations entre vos actions et les résultats. Les patterns émergent de l'accumulation de données, même sans comprendre tous les mécanismes sous-jacents.

Quelles erreurs éviter dans ce contexte d'incertitude ?

La principale erreur serait de suivre aveuglément des "recettes miracles" ou des techniques prétendument infaillibles. Chaque site évolue dans un contexte unique avec ses propres variables.

- Ne pas chercher à manipuler l'algorithme avec des techniques obscures qui peuvent se retourner contre vous

- Éviter de sur-optimiser sur un signal unique au détriment de l'ensemble (le fameux piège de la "sur-optimisation")

- Ne pas copier aveuglément ce qui fonctionne pour les concurrents sans comprendre le contexte

- Refuser les promesses de résultats garantis en SEO - personne ne contrôle l'algorithme

- Ne pas négliger les fondamentaux au profit de tactiques avancées prématurées

- Éviter de prendre les communications officielles comme des vérités absolues - elles sont volontairement incomplètes

- Ne pas sous-estimer l'importance des tests continus et de l'adaptation permanente

- Mettre en place un système de monitoring rigoureux pour détecter rapidement les impacts des mises à jour

💬 Commentaires (0)

Soyez le premier à commenter.