Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le CTR est-il vraiment un proxy fiable de la pertinence d'une requête ?

- □ Faut-il prioriser les requêtes à faible position mais CTR élevé pour maximiser son trafic organique ?

- □ Faut-il vraiment prioriser les requêtes déjà classées plutôt que de viser de nouveaux mots-clés ?

- □ Faut-il vraiment ignorer les requêtes non pertinentes qui génèrent du trafic ?

- □ Les données structurées volent-elles vraiment vos clics en première position ?

- □ Pourquoi vos concurrents captent-ils plus de clics que vous en SERP ?

- □ Pourquoi Google insiste-t-il autant sur la précision des balises title, meta descriptions et attributs ALT ?

- □ Les balises d'en-tête structurent-elles vraiment mieux le contenu pour Google ?

- □ Les données structurées garantissent-elles vraiment l'accès aux résultats enrichis ?

- □ Faut-il vraiment s'appuyer sur les mots connexes pour élargir sa stratégie de mots-clés ?

- □ Google Trends peut-il vraiment identifier les opportunités SEO avant vos concurrents ?

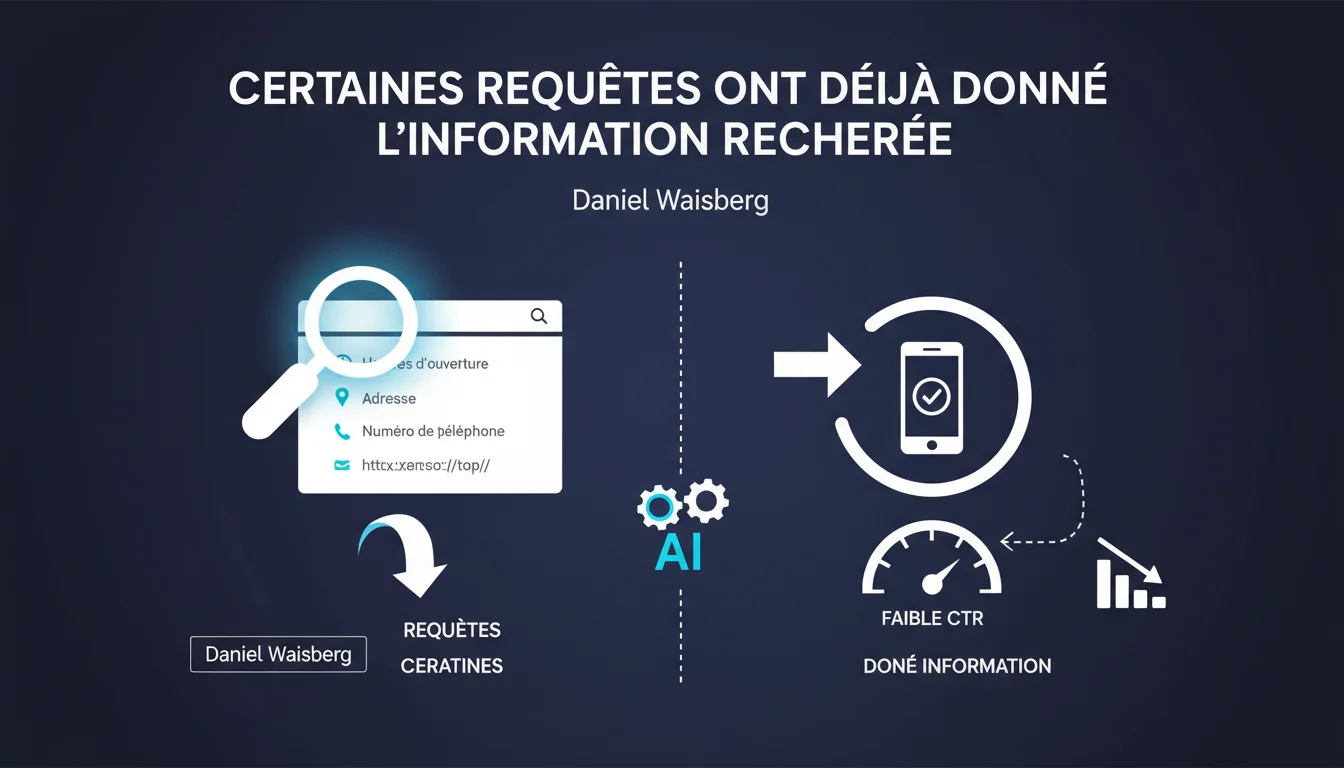

Google rappelle qu'une position #1 avec un CTR faible peut simplement signifier que les utilisateurs ont trouvé l'information directement dans les SERP — horaires, adresse, téléphone. Ce n'est pas systématiquement un signal d'alarme sur la qualité du résultat, mais plutôt une caractéristique de certaines requêtes informationnelles simples.

Ce qu'il faut comprendre

Qu'est-ce que cela signifie concrètement pour les professionnels SEO ?

Daniel Waisberg pointe une réalité terrain : toutes les positions #1 ne génèrent pas le même taux de clic. Certaines requêtes affichent directement la réponse dans les résultats enrichis — Knowledge Panel, heures d'ouverture, coordonnées via Google Business Profile, featured snippets.

Pour ces requêtes, l'utilisateur n'a aucune raison de cliquer. Il a déjà ce qu'il cherchait. Un CTR de 5 % sur une requête locale avec Knowledge Graph n'est donc pas anormal — c'est prévisible.

Pourquoi Google insiste-t-il sur ce point maintenant ?

La déclaration semble viser à calmer l'inquiétude des webmasters qui voient un CTR dégringoler malgré un classement stable. Avec la montée en puissance des fonctionnalités SERP (AI Overviews, featured snippets, People Also Ask), Google sait que de nombreux clics disparaissent — légitimement, selon lui.

L'argument sous-jacent : si l'utilisateur trouve sa réponse sans cliquer, c'est une victoire pour l'expérience utilisateur. Pas pour le propriétaire du site, évidemment, mais pour Google.

Quelles requêtes sont principalement concernées ?

Les requêtes informationnelles courtes et les recherches locales. « Horaires Carrefour Lyon », « numéro téléphone mairie Paris 12 », « âge de Brad Pitt » — tout ce qui peut être résolu par un Knowledge Panel ou une carte enrichie.

À l'inverse, les requêtes transactionnelles ou les recherches approfondies (comparatifs, guides, achats) conservent des CTR élevés. L'utilisateur a besoin de plus d'informations que ce que peut fournir un extrait.

- CTR faible ≠ problème de pertinence si l'info est déjà visible dans les SERP

- Les requêtes locales et informationnelles simples sont les plus touchées

- Google considère cela comme une amélioration de l'expérience utilisateur

- Le trafic organique peut mécaniquement baisser sur certaines requêtes sans que le référencement se dégrade

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées terrain ?

Oui. Depuis des années, on observe que les featured snippets cannibalisent le trafic, même en position #1. Une étude d'Ahrefs montrait déjà que gagner la position zéro pouvait faire chuter le CTR global de 20 à 30 % sur certaines requêtes.

Le problème, c'est que Google présente cela comme une fatalité acceptable. L'utilisateur est satisfait ? Peu importe que le site perde du trafic. Sauf que le modèle économique du web repose sur les visites — pas sur la satisfaction passive.

Quelles nuances faut-il apporter ?

Il faut distinguer deux cas. Premier cas : l'info affichée dans les SERP vient de ton propre site (extrait enrichi, données structurées). Tu perds du trafic, mais tu conserves une visibilité et une crédibilité indirecte — l'utilisateur voit ton nom.

Deuxième cas : l'info vient d'une source tierce agrégée par Google (Knowledge Graph, Wikipedia, annuaires). Là, tu perds tout : le clic, la visibilité, l'attribution. Et c'est plus fréquent qu'on ne le pense.

Waisberg ne fait pas cette distinction. Il parle de « l'information recherchée » sans préciser d'où elle vient ni comment elle a été indexée. [À vérifier] : est-ce que Google valorise davantage les sites sources dans ces cas-là, ou se contente-t-il de piocher l'info sans contrepartie ?

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur les requêtes transactionnelles, comparatives, ou nécessitant un parcours utilisateur. Un utilisateur qui cherche « meilleur CRM pour PME » ne va pas se contenter d'un extrait — il veut lire, comparer, explorer.

De même, les requêtes de marque conservent des CTR élevés même avec un Knowledge Panel. L'utilisateur cherche à accéder au site, pas juste à connaître l'adresse du siège social.

Impact pratique et recommandations

Que faut-il faire concrètement si votre CTR est faible malgré un bon positionnement ?

Commence par identifier le type de requête. Si c'est une requête locale ou informationnelle simple, un CTR de 5-10 % en #1 peut être structurellement normal. Regarde dans la Search Console quelles requêtes sont concernées.

Ensuite, analyse la SERP elle-même. Ouvre une navigation privée et cherche ta requête. Que voit l'utilisateur avant ton résultat ? Un Knowledge Panel avec toutes les infos ? Un featured snippet concurrent ? Une carte Google Maps ?

Si l'info vient de ton site mais s'affiche sans clic (extrait enrichi, données structurées), c'est un moindre mal. Tu perds du trafic mais tu conserves une forme de crédit. Si l'info vient d'ailleurs, tu as deux options : soit optimiser pour récupérer cet extrait, soit diversifier ton trafic.

Quelles erreurs éviter dans l'interprétation des données ?

Ne compare jamais aveuglément le CTR de deux requêtes différentes. Une requête avec intent transactionnel aura toujours un CTR supérieur à une requête informationnelle, même à position égale.

Erreur classique : paniquer en voyant un CTR à 8 % en position #1 sur une requête locale alors qu'un concurrent fait 25 % sur une requête produit. Ce sont des typologies incomparables.

Autre piège : interpréter une baisse de CTR comme une dégradation du snippet. Parfois, c'est juste Google qui a ajouté un bloc « People Also Ask » au-dessus de toi, repoussant ton résultat visuellement vers le bas sans toucher au classement.

Comment ajuster sa stratégie face à cette réalité ?

Si tes requêtes principales sont structurellement canalisées par des fonctionnalités SERP, diversifie. Cible des variations long tail où Google affiche moins de résultats enrichis. Développe du contenu transactionnel ou comparatif qui nécessite un clic.

Optimise tes données structurées pour être la source de l'extrait enrichi, même si tu perds le clic. Au moins, tu contrôles le message et tu restes visible. Et surveille l'évolution de ces formats — ils changent souvent.

- Segmenter les requêtes par intent dans la Search Console pour identifier les patterns de CTR

- Analyser manuellement les SERP pour comprendre ce qui s'affiche avant votre résultat

- Implémenter les données structurées pertinentes (horaires, adresse, FAQ, How-to) pour capter les extraits enrichis

- Suivre l'évolution du CTR après chaque Google Update majeure — les formats SERP changent

- Ne pas se focaliser uniquement sur le CTR : mesurer aussi la visibilité de marque indirecte (impressions, extraits affichés)

- Diversifier le trafic vers des requêtes moins exposées aux fonctionnalités SERP

❓ Questions frequentes

Un CTR faible en position #1 peut-il pénaliser mon référencement à terme ?

Comment savoir si mon CTR est normal pour ma requête ?

Dois-je optimiser mon snippet même si l'info s'affiche déjà dans les SERP ?

Les données structurées peuvent-elles réduire mon CTR en affichant trop d'infos ?

Google compense-t-il d'une manière ou d'une autre la perte de trafic liée aux extraits enrichis ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.