Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le budget crawl et pourquoi ce concept est-il mal compris ?

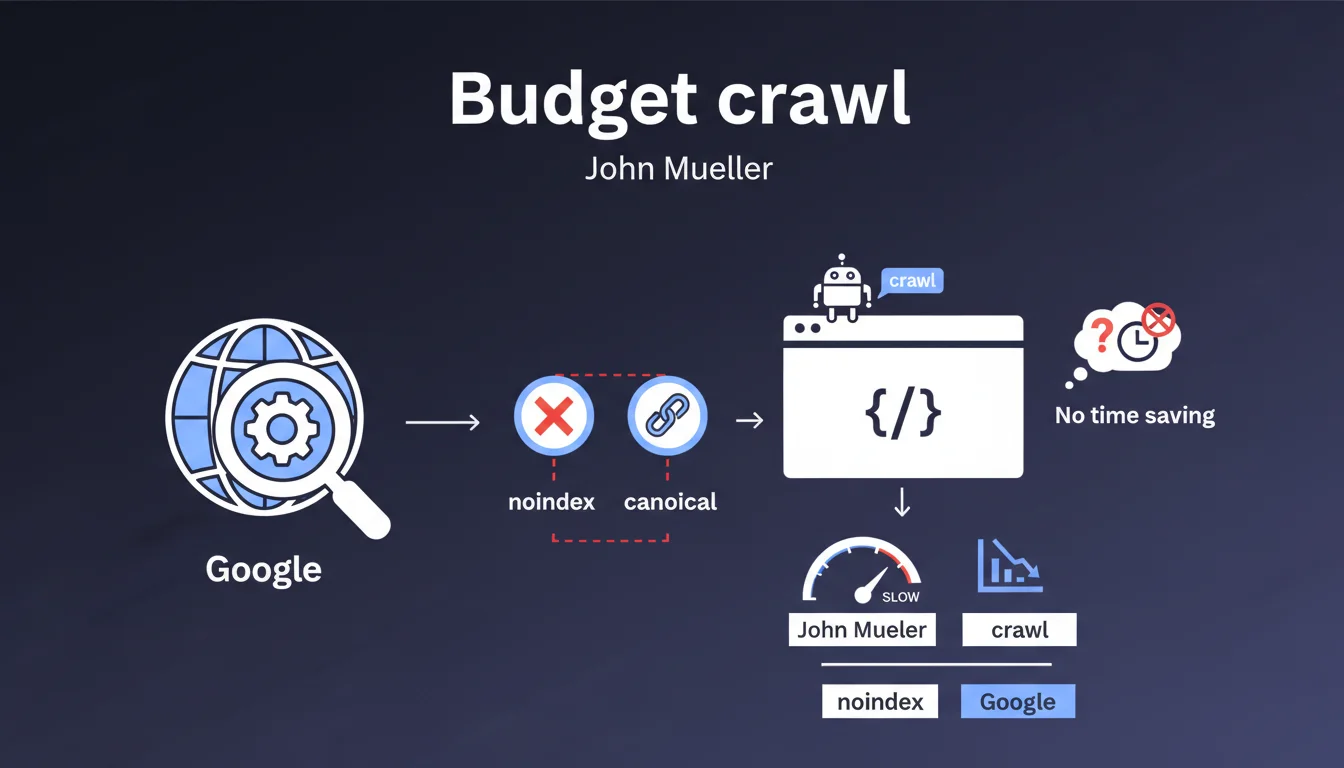

Le budget crawl désigne le nombre de pages que Googlebot peut et souhaite explorer sur un site lors d'une session de crawl. Cette notion est souvent perçue comme une limite stricte à ne pas dépasser, créant des inquiétudes inutiles chez de nombreux webmasters.

Google alloue effectivement des ressources différentes selon les sites, mais cette allocation est dynamique et s'ajuste selon la qualité du contenu, la fréquence de mise à jour et l'autorité du domaine. La confusion vient du fait que beaucoup pensent qu'ils doivent optimiser ce budget même pour des sites de taille modeste.

Pour quels types de sites le budget crawl devient-il une préoccupation réelle ?

Selon cette déclaration, seuls les très gros sites devraient réellement se préoccuper du budget crawl. Il s'agit principalement de sites pouvant générer un nombre infini ou quasi-infini de pages, comme les plateformes e-commerce massives, les sites d'agrégation ou les sites avec facettes de filtrage.

Pour la majorité des sites web classiques, même avec plusieurs milliers de pages, Google parvient généralement à explorer l'ensemble du contenu sans difficulté particulière. L'obsession du budget crawl est donc souvent déplacée par rapport aux vrais enjeux SEO.

Quelle clarification officielle Google a-t-il promise sur ce sujet ?

Face aux nombreuses incompréhensions observées dans la communauté SEO, Google a annoncé la publication prochaine d'un document officiel pour clarifier le concept de budget crawl. Ce document vise à démystifier cette notion et à fournir des guidelines claires.

Cette démarche confirme que Google reconnaît le besoin d'éducation sur ce sujet et souhaite éviter que les SEO se concentrent sur des optimisations peu pertinentes pour leur contexte spécifique.

- Le budget crawl n'est pas une préoccupation pour la majorité des sites web

- Seuls les très gros sites avec génération infinie de pages doivent y prêter attention

- Google publiera un document officiel pour clarifier ces notions

- Les inquiétudes autour du budget crawl sont souvent disproportionnées

- L'allocation de ressources de crawl est dynamique et adaptative

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

En quinze ans de pratique SEO, j'observe effectivement que le budget crawl est devenu un faux problème pour beaucoup de professionnels. Trop de sites avec 500 ou 1000 pages s'inquiètent inutilement de cette métrique alors que leurs vrais problèmes se situent ailleurs : qualité du contenu, structure technique, ou maillage interne.

Les cas où j'ai réellement constaté des problèmes de budget crawl concernaient systématiquement des sites avec plus de 100 000 pages indexables, des facettes non contrôlées, ou des systèmes de pagination infinie. Pour ces situations, les optimisations sont alors clairement mesurables et impactantes.

Quelles nuances importantes faut-il apporter à cette déclaration ?

Bien que le message de Google soit globalement rassurant, il ne faut pas en conclure qu'aucune optimisation du crawl n'est nécessaire. Même pour des sites moyens, certaines mauvaises pratiques peuvent effectivement gaspiller du budget crawl : pages dupliquées non canonicalisées, paramètres d'URL non gérés, ou contenus de très faible qualité.

La distinction clé est la suivante : vous n'avez probablement pas un problème de volume de crawl, mais vous pouvez avoir un problème d'efficacité du crawl. Optimiser ce que Googlebot crawle reste pertinent, même si vous ne manquez pas de budget absolu.

Dans quels cas spécifiques cette règle ne s'applique-t-elle pas ?

Plusieurs scénarios justifient une attention particulière au budget crawl : sites e-commerce avec génération dynamique de facettes, plateformes d'annonces avec millions de listings, sites de presse avec archives massives, ou encore sites multilingues avec combinaisons exponentielles de paramètres.

Dans ces contextes, ignorer le budget crawl peut conduire à ce que Google explore prioritairement des pages de faible valeur au détriment de contenus stratégiques. L'analyse des logs serveur devient alors un exercice indispensable pour identifier les inefficacités et prioriser le crawl sur les contenus à forte valeur ajoutée.

Impact pratique et recommandations

Comment savoir si votre site est concerné par les limitations de budget crawl ?

Commencez par évaluer objectivement la taille réelle de votre site. Si vous avez moins de 10 000 pages indexables, le budget crawl n'est probablement pas votre priorité. Concentrez-vous plutôt sur la qualité et la pertinence de vos contenus.

Pour les sites plus importants, analysez vos fichiers logs pour identifier si Googlebot explore régulièrement l'ensemble de vos pages importantes. Un signal d'alerte serait que des pages stratégiques ne soient crawlées que tous les 30 jours ou plus, tandis que des pages sans valeur le sont quotidiennement.

Quelles actions concrètes entreprendre pour optimiser le crawl sans tomber dans la sur-optimisation ?

Concentrez-vous sur les fondamentaux techniques plutôt que sur l'obsession du budget. Assurez-vous que votre robots.txt bloque efficacement les sections sans valeur SEO (interfaces de recherche interne, paramètres de session, versions d'impression).

Mettez en place une stratégie de canonicalisation rigoureuse pour éviter le crawl de contenu dupliqué. Utilisez le maillage interne pour guider Googlebot vers vos contenus prioritaires, plutôt que de le laisser découvrir aléatoirement votre architecture.

Pour les sites e-commerce, configurez intelligemment vos paramètres d'URL dans la Search Console et utilisez les balises noindex pour les combinaisons de facettes sans valeur.

Quelle stratégie adopter pour maintenir un crawl efficace sur le long terme ?

Établissez un monitoring régulier via la Search Console pour suivre les statistiques d'exploration. Une baisse soudaine du crawl peut indiquer un problème technique (temps de réponse, erreurs serveur) plutôt qu'une limitation de budget.

Auditez périodiquement votre index Google avec la commande "site:" pour identifier les pages indexées qui ne devraient pas l'être. Cette pollution de l'index est souvent plus problématique que le budget crawl lui-même.

- Évaluez la taille réelle de votre site et votre niveau de préoccupation légitime

- Analysez vos logs serveur pour identifier les patterns de crawl

- Nettoyez votre robots.txt pour bloquer les sections sans valeur SEO

- Implémentez une stratégie de canonicalisation cohérente

- Configurez les paramètres d'URL dans la Search Console

- Utilisez le maillage interne pour prioriser les contenus stratégiques

- Surveillez régulièrement les statistiques d'exploration dans la Search Console

- Auditez périodiquement votre index pour détecter la pollution

- Concentrez-vous sur la qualité plutôt que sur l'obsession du budget

💬 Commentaires (0)

Soyez le premier à commenter.