Declaration officielle

Ce qu'il faut comprendre

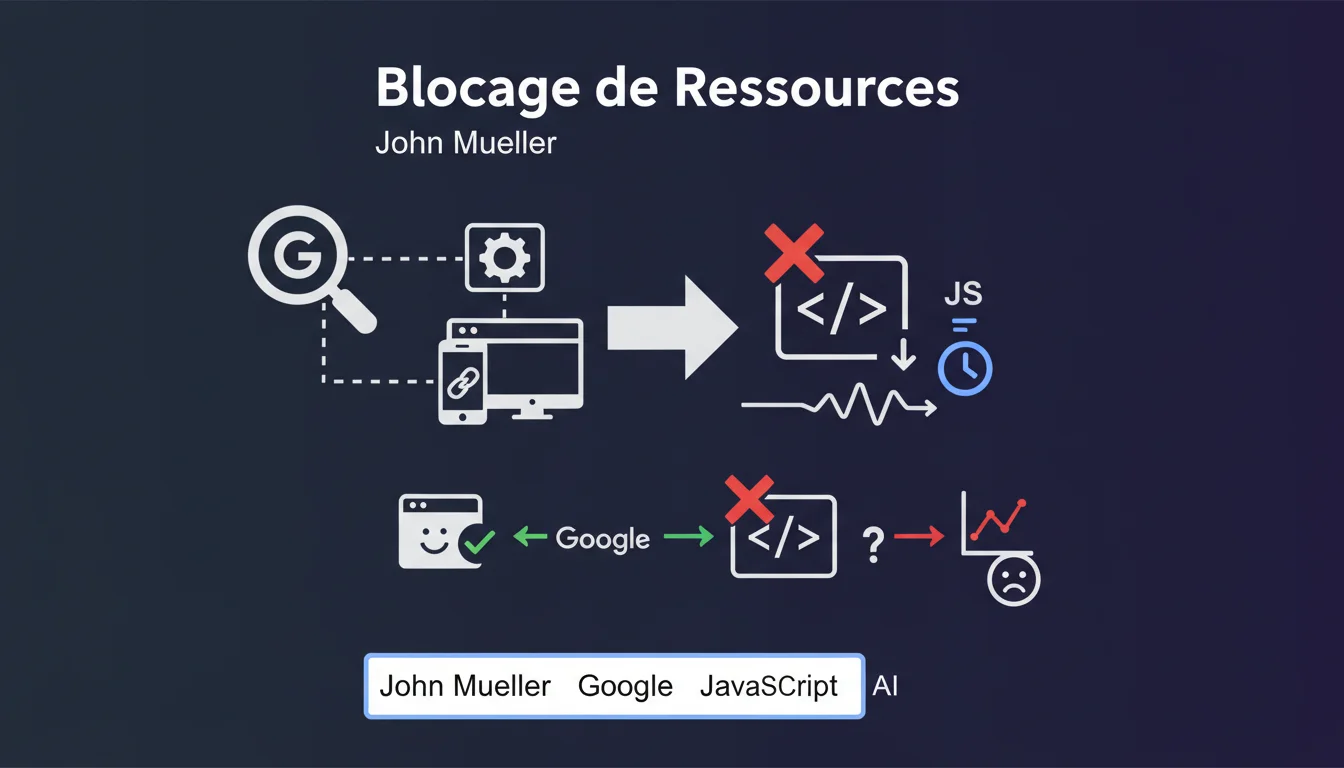

Le blocage de ressources pour Googlebot consiste à empêcher le robot de Google d'accéder à certains fichiers CSS, JavaScript ou images via le fichier robots.txt. Certains référenceurs sont tentés de bloquer des ressources lourdes ou lentes pour améliorer artificiellement les métriques de performance perçues par Google.

Google met en garde contre cette pratique : le moteur a besoin d'accéder à toutes les ressources d'une page pour la comprendre correctement. Bloquer du JavaScript peut empêcher Google de voir du contenu généré dynamiquement, des boutons interactifs ou des éléments de navigation essentiels.

Cette approche s'apparente à du cloaking, c'est-à-dire montrer une version différente de la page à Google par rapport aux utilisateurs réels. Google considère cela comme une manipulation et peut pénaliser les sites qui adoptent cette stratégie.

- Google a besoin d'accéder à toutes les ressources pour analyser correctement une page

- Bloquer des ressources uniquement pour Googlebot modifie la perception de la page par le moteur

- Cette pratique peut être assimilée à du cloaking et comporte des risques de pénalité

- Les métriques de performance doivent refléter l'expérience réelle des utilisateurs

Avis d'un expert SEO

Cette position de Google est parfaitement cohérente avec l'évolution du moteur vers une analyse toujours plus complète des pages web. Depuis l'implémentation du rendu JavaScript, Google veut voir les pages comme un utilisateur réel les voit.

Il existe toutefois des zones grises légitimes : bloquer des scripts de tracking analytics, des outils de chat ou des widgets publicitaires tiers n'a généralement pas d'impact négatif, car ces éléments ne contribuent pas au contenu principal. La nuance importante est de ne jamais bloquer des ressources qui affectent le rendu ou la compréhension du contenu éditorial.

La vraie question n'est pas "que bloquer pour Google ?" mais "comment optimiser les ressources pour tous ?". Une ressource trop lente pour Google le sera aussi pour vos visiteurs, impactant négativement votre taux de conversion.

Impact pratique et recommandations

- Auditez votre robots.txt : vérifiez qu'aucune ressource CSS, JavaScript ou image importante n'est bloquée pour Googlebot

- Testez le rendu Google : utilisez l'outil d'inspection d'URL dans Search Console pour voir comment Google affiche vos pages avec toutes les ressources

- Optimisez réellement les performances : minifiez, compressez et mettez en cache vos ressources plutôt que de les bloquer

- Différez le chargement intelligent : utilisez le lazy loading et le chargement asynchrone pour les ressources non critiques, mais laissez-les accessibles

- Identifiez les ressources tierces : seuls les scripts non essentiels (analytics, publicités) peuvent être légitimement bloqués sans impact SEO

- Priorisez le contenu critique : assurez-vous que tout JavaScript nécessaire à l'affichage du contenu principal soit accessible et optimisé

- Surveillez les écarts de performance : comparez les données de vos outils synthétiques avec les Core Web Vitals réels des utilisateurs

L'optimisation technique des ressources et la gestion de la performance web sont des domaines complexes qui nécessitent une expertise approfondie. Entre l'analyse du rendu JavaScript, l'optimisation du chargement critique et le maintien de la cohérence entre bots et utilisateurs, les enjeux techniques sont nombreux. Pour une stratégie de performance web véritablement alignée avec les exigences SEO actuelles, l'accompagnement par une agence SEO spécialisée peut vous faire gagner un temps précieux et éviter des erreurs coûteuses qui pourraient impacter votre visibilité.

💬 Commentaires (0)

Soyez le premier à commenter.