Declaration officielle

Ce qu'il faut comprendre

Quelle est la différence entre évaluation globale et analyse granulaire par Google ?

Google utilise des algorithmes d'apprentissage automatique pour évaluer la qualité d'un site dans son ensemble, plutôt que pour analyser chaque page ou requête individuellement. Cette approche globale signifie que le machine learning détermine une réputation générale du domaine, pas des pénalités ciblées sur des contenus spécifiques.

Contrairement aux filtres algorithmiques classiques qui peuvent cibler une page ou une section, le machine learning fonctionne au niveau du site entier. Il analyse des signaux multiples pour établir un score de confiance global qui influence ensuite le positionnement.

Pourquoi Google privilégie-t-il une approche non granulaire ?

Cette stratégie permet à Google d'évaluer la fiabilité et l'autorité d'un domaine en croisant des milliers de signaux. Un site reconnu comme globalement qualitatif bénéficiera d'une meilleure visibilité générale, même si quelques contenus sont moins performants.

L'apprentissage automatique détecte des patterns de qualité ou de manipulation difficiles à identifier par des règles classiques. Cette vision d'ensemble évite les optimisations trop techniques au profit d'une vraie qualité éditoriale.

Que signifie l'absence de nouveaux algorithmes majeurs en développement ?

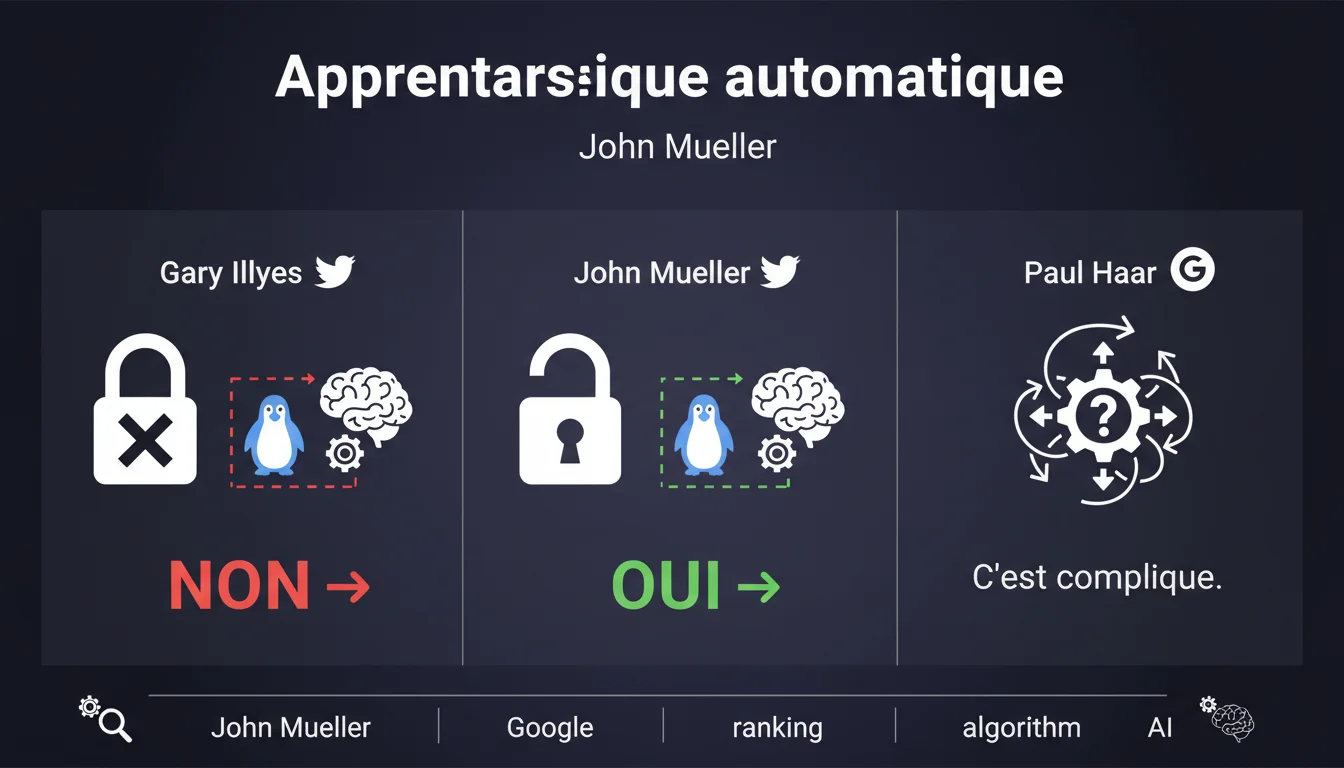

La déclaration de Gary Illyes indique que Google consolide ses systèmes existants plutôt que de développer de nouvelles révolutions algorithmiques. Les efforts se concentrent sur l'amélioration et l'affinage des technologies déjà déployées.

- Le machine learning évalue la qualité globale du site, pas des pages isolées

- Aucune pénalité spécifique n'est appliquée par ces algorithmes d'apprentissage

- L'approche est holistique et non granulaire

- Google améliore ses systèmes existants plutôt que d'en créer de nouveaux

- La réputation du domaine devient un facteur déterminant

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain des SEO ?

Les analyses de nombreux sites confirment effectivement cette approche. On observe régulièrement des domaines entiers bénéficiant d'un boost global plutôt que des pages individuelles. Les sites avec une autorité établie positionnent plus facilement leurs nouveaux contenus, même moyens.

Cependant, certains algorithmes comme les Core Updates semblent parfois cibler des catégories spécifiques ou des types de contenus. La frontière entre évaluation globale et impacts sectoriels reste floue dans la pratique.

Quelles nuances importantes faut-il apporter à cette déclaration ?

Si le machine learning juge la qualité globale, d'autres filtres algorithmiques classiques restent très granulaires. Les pénalités pour contenus dupliqués, spam ou manipulation de liens fonctionnent toujours au niveau des pages ou sections.

L'affirmation sur l'absence de nouveaux algorithmes majeurs date de plusieurs années. Depuis, des systèmes comme le Helpful Content Update ont émergé, montrant que Google continue d'innover, même si le rythme ralentit.

Dans quels cas cette approche globale pose-t-elle problème ?

Pour les sites multilingues ou multithématiques, une section de mauvaise qualité peut impacter négativement l'ensemble du domaine. Un blog corporate négligé peut ainsi pénaliser les pages commerciales pourtant bien optimisées.

Les nouveaux sites ou ceux en refonte complète doivent attendre que Google réévalue leur réputation globale, ce qui peut prendre plusieurs mois. L'inertie du système devient frustrante quand les améliorations locales ne se traduisent pas rapidement en gains.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son site face au machine learning ?

Privilégiez une approche qualité sur l'ensemble du domaine plutôt que des optimisations techniques isolées. Auditez régulièrement toutes les sections du site, y compris celles à faible trafic qui peuvent nuire à votre réputation globale.

Investissez dans la cohérence éditoriale et l'expertise démontrée sur vos thématiques. Google cherche des signaux de fiabilité qui transcendent l'optimisation page par page : auteurs identifiés, sources citées, mises à jour régulières.

Éliminez ou améliorez les contenus faibles ou obsolètes qui dégradent la perception globale. Un site de 100 pages excellentes sera mieux évalué qu'un site de 1000 pages dont 70% sont médiocres.

Quelles erreurs majeures faut-il absolument éviter ?

Ne négligez aucune section de votre site en pensant qu'elle est invisible. Un blog abandonné, des fiches produits vides ou du contenu automatisé médiocre impacteront l'ensemble de votre domaine.

Évitez les stratégies de sur-optimisation technique au détriment de la qualité réelle. Le machine learning détecte les patterns artificiels : pages créées en masse, contenus génériques, liens internes excessifs.

- Auditer la qualité de toutes les pages du domaine, pas seulement les prioritaires

- Supprimer ou améliorer les contenus faibles ou obsolètes

- Développer des signaux d'expertise et d'autorité cohérents sur tout le site

- Soigner la cohérence éditoriale et la mise à jour régulière

- Investir dans la qualité plutôt que la quantité de contenus

- Monitorer la réputation du domaine via les Core Updates

- Structurer clairement les thématiques d'expertise du site

- Éviter les sections négligées qui dégradent l'image globale

Comment mesurer et améliorer la perception globale de votre site ?

Suivez l'évolution de votre visibilité lors des Core Updates qui reflètent les réévaluations de qualité globale. Des outils comme la Search Console permettent d'identifier les tendances de trafic au niveau domaine.

Analysez les métriques d'engagement sur l'ensemble du site : taux de rebond, temps passé, pages par session. Ces signaux comportementaux alimentent probablement les algorithmes d'apprentissage automatique.

💬 Commentaires (0)

Soyez le premier à commenter.