Declaration officielle

Ce qu'il faut comprendre

Dans quels cas précis un sitemap XML devient-il nécessaire pour le SEO ?

Google identifie quatre situations spécifiques où le sitemap XML apporte une réelle valeur ajoutée au référencement. La première concerne les sites volumineux avec des milliers de pages, où le crawler peut avoir des difficultés à découvrir l'ensemble du contenu.

La deuxième situation vise les sites avec des pages isolées ou mal reliées dans l'arborescence, qui risquent de ne jamais être découvertes par le robot. Les troisième et quatrième cas s'appliquent aux sites récents qui n'ont pas encore établi leur présence et aux sites avec un contenu très dynamique qui change fréquemment.

Quelle est la véritable fonction d'un sitemap XML dans la stratégie de crawl ?

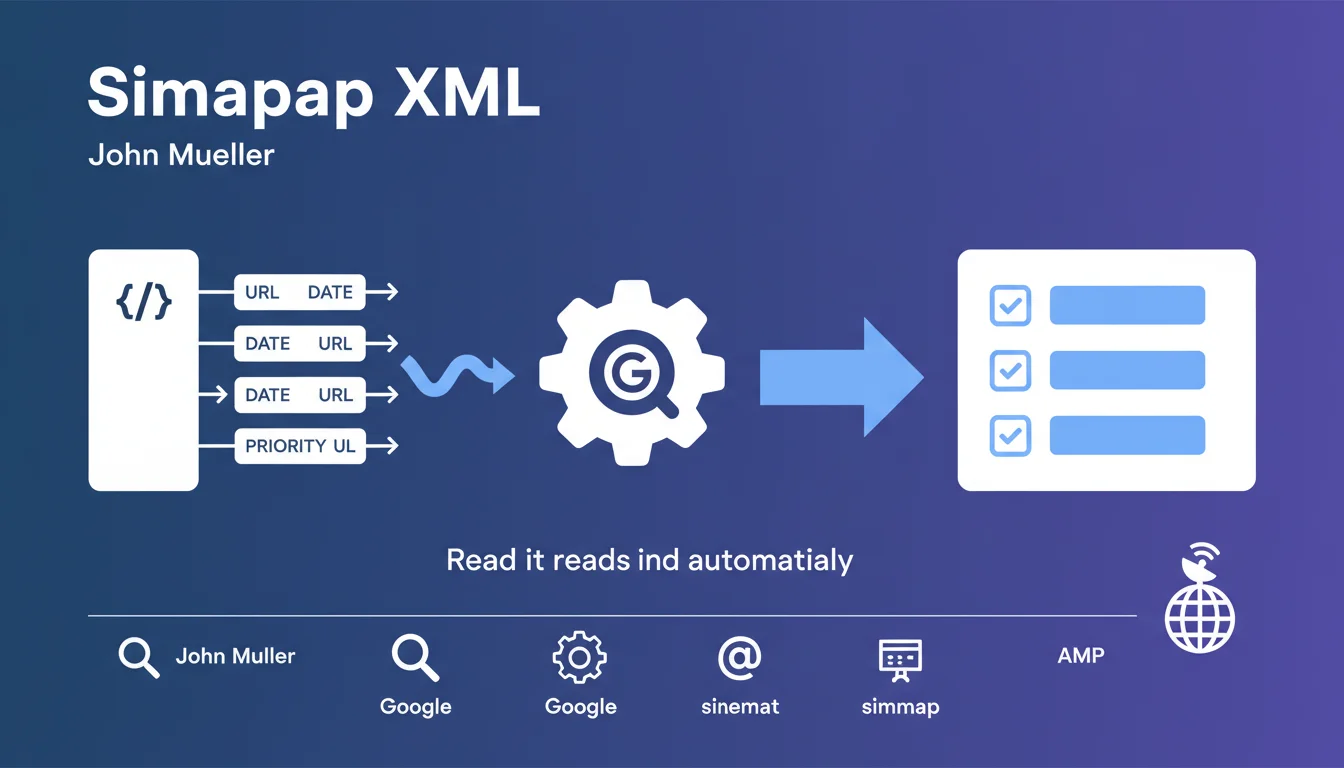

Le sitemap XML fonctionne comme un guide complémentaire pour les robots de Google, pas comme une solution miracle. Il ne remplace jamais une architecture solide, mais vient en support du crawl naturel pour s'assurer qu'aucune page importante n'est oubliée.

Google utilise ce fichier comme une indication suggérée, pas comme une directive obligatoire. Le moteur reste libre de crawler ou non les URLs listées, et de déterminer sa propre priorité d'exploration.

Pourquoi l'architecture du site reste-t-elle plus importante que le sitemap ?

Une arborescence bien conçue permet aux robots de découvrir naturellement vos contenus en suivant les liens internes. Cette méthode est bien plus efficace car elle transmet également du jus de lien et établit la hiérarchie sémantique de votre site.

La règle des 4 clics maximum depuis la page d'accueil garantit que toutes vos pages importantes sont facilement accessibles. Cette approche améliore simultanément l'expérience utilisateur et l'efficacité du crawl.

- Le sitemap XML est utile dans 4 cas précis : sites volumineux, pages isolées, sites récents, contenus changeants

- Il complète le crawl naturel mais ne le remplace jamais

- Une bonne architecture de site reste la priorité absolue pour le SEO

- La règle des 4 clics maximum assure un crawl optimal des pages stratégiques

- Le sitemap est une suggestion pour Google, pas une garantie d'indexation

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les pratiques observées sur le terrain ?

Après 15 ans d'observation, je constate que cette position de Google est parfaitement cohérente avec la réalité du crawl. Les sites avec une architecture solide obtiennent effectivement un meilleur taux d'indexation, même sans sitemap.

Cependant, dans la pratique, j'observe que même les sites moyens bénéficient d'un sitemap. Il accélère la découverte des nouveaux contenus et aide à prioriser les mises à jour importantes. Le coût de mise en place étant négligeable, il n'y a aucune raison de s'en priver.

Quelles nuances faut-il apporter à cette déclaration officielle ?

La distinction entre "sites qui en ont besoin" et "sites qui n'en ont pas besoin" est trop binaire. En réalité, presque tous les sites gagnent à avoir un sitemap, même s'il n'est pas strictement indispensable pour les plus petits.

Un site de 50 pages avec une architecture parfaite peut techniquement s'en passer, mais le sitemap reste utile pour contrôler la fréquence de crawl et signaler les mises à jour. Il sert aussi d'outil de diagnostic dans la Search Console pour identifier les problèmes d'indexation.

Dans quels cas cette approche minimaliste pourrait-elle être problématique ?

Pour les sites e-commerce avec catalogue dynamique, le sitemap devient crucial même avec une bonne architecture. Les produits apparaissent et disparaissent, les stocks changent, et le sitemap permet de synchroniser rapidement ces modifications avec l'index de Google.

Les sites d'actualités et médias sont un autre cas où le sitemap est indispensable, même pour des structures de taille moyenne. La fraîcheur du contenu est un facteur de ranking, et le sitemap News permet une indexation quasi-instantanée des nouveaux articles.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son sitemap XML ?

Commencez par auditer votre architecture actuelle avant de vous focaliser sur le sitemap. Vérifiez que toutes vos pages importantes sont accessibles en moins de 4 clics depuis l'accueil, avec des liens internes pertinents.

Ensuite, créez un sitemap propre contenant uniquement les URLs indexables : pas de redirections, pas de pages en noindex, pas d'erreurs 404. Incluez les dates de dernière modification et utilisez les priorités de manière cohérente.

Pour les gros sites, privilégiez des sitemaps segmentés par type de contenu plutôt qu'un fichier unique de 50 000 URLs. Cela facilite le diagnostic et permet à Google de mieux comprendre votre structure.

Quelles erreurs courantes faut-il absolument éviter ?

L'erreur la plus fréquente est d'inclure toutes les URLs du site sans distinction. Un sitemap surchargé d'URLs peu importantes dilue votre budget de crawl et réduit l'efficacité globale.

Ne jamais oublier de mettre à jour le sitemap régulièrement. Un fichier obsolète avec 30% d'URLs mortes envoie un signal négatif sur la qualité de votre site et peut ralentir l'exploration des pages importantes.

Évitez également de créer un sitemap sans avoir corrigé les problèmes structurels fondamentaux. Un site avec une architecture chaotique ne sera pas sauvé par un sitemap, aussi bien conçu soit-il.

Comment vérifier l'efficacité de votre stratégie sitemap et architecture ?

Utilisez la Search Console pour analyser le taux de couverture de votre sitemap. Un bon ratio se situe au-dessus de 85% d'URLs soumises effectivement indexées. En dessous, c'est un signal d'alarme.

Vérifiez régulièrement les statistiques de crawl pour identifier les tendances. Une baisse du nombre de pages crawlées par jour peut indiquer des problèmes techniques ou de contenu à corriger rapidement.

Analysez également la profondeur de crawl avec des outils comme Screaming Frog. Si vos pages stratégiques se trouvent à 5 clics ou plus, votre architecture nécessite une refonte complète.

- Auditer l'architecture et vérifier la règle des 4 clics pour les pages importantes

- Créer un sitemap contenant uniquement les URLs indexables et stratégiques

- Segmenter les sitemaps par type de contenu pour les sites de plus de 10 000 pages

- Exclure toutes les URLs en noindex, les redirections et les erreurs du sitemap

- Mettre à jour le sitemap automatiquement à chaque modification importante

- Monitorer le taux de couverture dans la Search Console mensuellement

- Analyser les statistiques de crawl pour détecter les anomalies rapidement

- Implémenter un système de liens internes contextuels pour renforcer l'architecture

- Utiliser les sitemaps spécialisés (News, Video, Images) selon votre contenu

Le sitemap XML est un outil complémentaire précieux mais ne doit jamais être considéré comme la solution principale à vos problématiques de crawl et d'indexation. L'investissement prioritaire doit porter sur une architecture solide et logique qui permet aux robots comme aux utilisateurs de naviguer efficacement.

La mise en place d'une stratégie d'architecture optimale couplée à des sitemaps bien configurés demande une expertise technique approfondie et une compréhension fine des mécaniques de crawl. Pour les sites complexes ou en forte croissance, l'accompagnement par une agence SEO spécialisée permet d'éviter les erreurs coûteuses et d'accélérer significativement les résultats, avec un audit personnalisé de votre situation spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.