Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Faut-il vraiment compter sur les recommandations de la Search Console pour optimiser son site ?

- □ Pourquoi Google Search Console conserve-t-elle enfin vos filtres entre chaque changement de propriété ?

- □ Faut-il s'inquiéter de la suppression du cache Google et de l'opérateur cache: ?

- □ Faut-il encore utiliser la balise meta noarchive après la suppression du cache Google ?

- □ Le paramètre srsltid dans les URLs e-commerce : faut-il s'en préoccuper en SEO ?

- □ Pourquoi Google met-il soudainement à jour sa documentation sur le SEO vidéo, les liens de titre et les crawlers ?

- □ Faut-il vraiment limiter l'usage de l'API d'indexation aux types de contenu spécifiques ?

- □ Pourquoi les URLs avec symbole dièse ne peuvent-elles pas servir de canoniques ?

- □ Faut-il adopter le format AVIF maintenant que Google Images le supporte ?

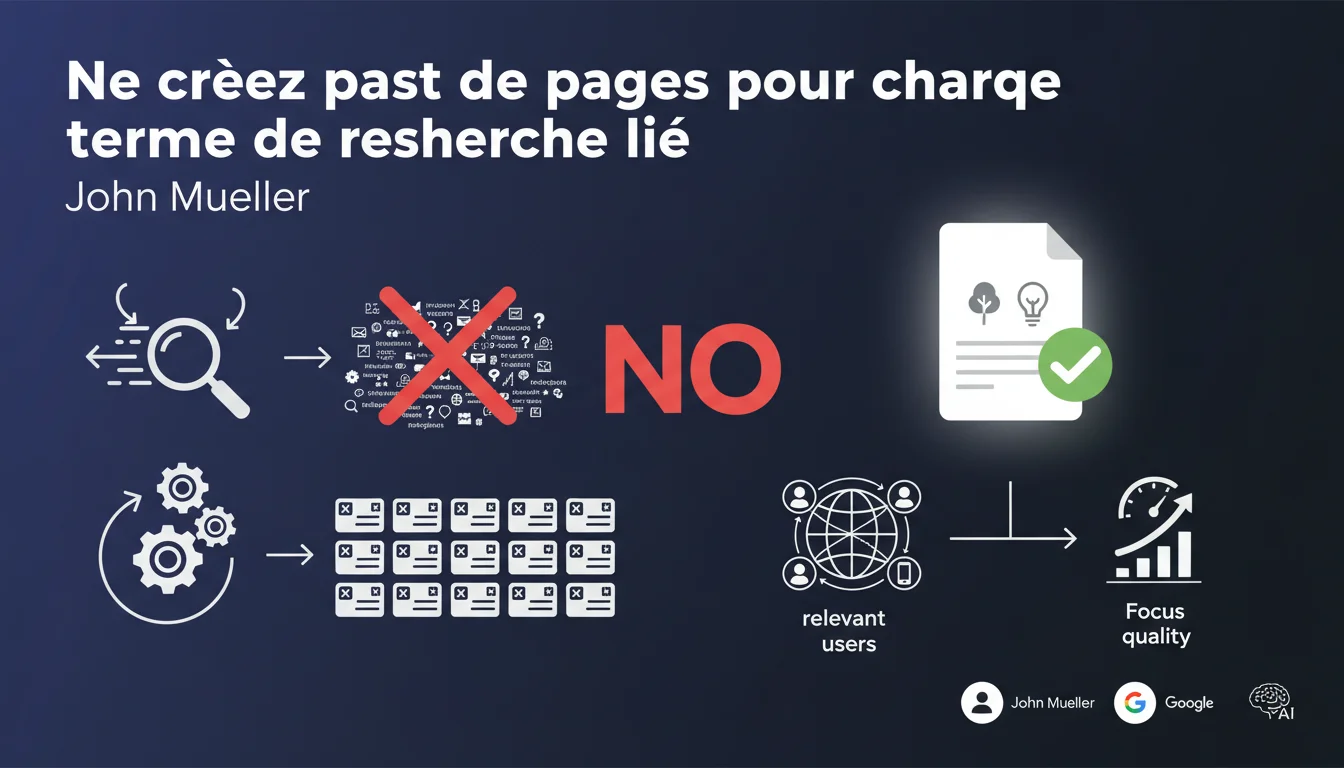

Google déconseille explicitement de multiplier les pages pour couvrir chaque variation de requête identifiée via des outils comme Google Trends. L'accent doit être mis sur la valeur réelle apportée aux utilisateurs et l'expertise unique, plutôt que sur la couverture exhaustive de toutes les déclinaisons sémantiques possibles.

Ce qu'il faut comprendre

Pourquoi Google met-il en garde contre cette pratique ?

Cette déclaration vise une dérive courante : l'usage abusif d'outils de recherche de mots-clés pour créer des dizaines de pages quasi-identiques, chacune ciblant une micro-variation d'une même requête. Google Trends, Semrush, Ahrefs — tous ces outils révèlent des centaines de variantes sémantiques autour d'un sujet donné.

La tentation est forte de créer une page distincte pour "meilleur logiciel CRM", "meilleur outil CRM", "top logiciel CRM", etc. Sauf que du point de vue de l'utilisateur — et donc de Google — ces pages n'apportent aucune valeur différenciante. Elles diluent l'autorité du site et encombrent l'index.

Que signifie concrètement "apporter de la valeur" ?

Google insiste sur deux critères : l'expertise unique et la pertinence utilisateur. Une page a de la valeur si elle propose un angle inédit, des données exclusives, une analyse approfondie ou une réponse que les concurrents n'ont pas.

Répéter ce que tout le monde dit en changeant trois mots ne suffit plus. L'algorithme détecte ces pages faiblement différenciées et les pénalise via les signaux de qualité (mise à jour Helpful Content notamment).

Quels sont les risques de cette stratégie ?

- Cannibalisation interne : plusieurs pages se disputent les mêmes requêtes, aucune ne se positionne correctement

- Dilution du crawl budget : Google perd du temps sur des pages redondantes au lieu d'explorer le contenu à forte valeur ajoutée

- Signal de spam : la multiplication de pages similaires peut être interprétée comme une tentative de manipulation, particulièrement si le contenu est généré automatiquement

- Expérience utilisateur dégradée : les visiteurs tombent sur des pages qui se ressemblent toutes, augmentant le taux de rebond et dégradant les signaux comportementaux

Avis d'un expert SEO

Cette position de Google est-elle nouvelle ?

Non. C'est un rappel d'un principe vieux comme le SEO moderne : la qualité prime sur la quantité. Ce qui change, c'est l'intensité avec laquelle Google applique désormais ce principe via ses filtres algorithmiques.

Depuis les mises à jour Panda (déjà anciennes) jusqu'à Helpful Content Update, la direction est claire. Mais avec l'explosion des outils d'IA générative et la facilité de créer du contenu à grande échelle, Google durcit le ton. Ce message de John Mueller n'est pas anodin — il vise directement les stratégies industrielles de production de contenu.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Il existe des contextes où multiplier les pages reste pertinent. Un site e-commerce avec des variantes produits réellement différentes (taille, couleur, modèle) a légitimement besoin de pages distinctes. De même, un site d'actualité couvrant plusieurs aspects d'un événement peut créer des articles séparés si chacun apporte un angle éditorial unique.

La nuance tient dans l'intentionnalité : crées-tu cette page parce qu'elle répond à un besoin utilisateur distinct ou simplement parce qu'un outil t'a signalé 50 recherches mensuelles sur cette variante ? Si c'est la seconde raison, passe ton chemin.

Quelles sont les limites de cette déclaration ?

Google reste volontairement flou sur le seuil acceptable. Combien de pages similaires avant que ce soit "trop" ? Aucune réponse chiffrée. [À vérifier] : dans la pratique, certains sites à forte autorité continuent de ranker avec des dizaines de pages quasi-dupliquées, tandis que des sites plus modestes sont pénalisés pour bien moins.

L'arbitrage semble dépendre du niveau de confiance global du domaine et de la qualité perçue du reste du contenu. Autrement dit : ce qui passe pour un gros site ne passera pas pour un petit. C'est injuste, mais c'est la réalité observée sur le terrain.

Impact pratique et recommandations

Que faut-il faire concrètement ?

Audit d'abord. Identifie les clusters de pages qui se chevauchent sémantiquement. Utilise un outil de crawl (Screaming Frog, Oncrawl) couplé à une analyse de contenu pour détecter les pages avec un overlap lexical élevé et ciblant des intentions de recherche identiques.

Ensuite, consolide. Plutôt que 10 pages sur des variations mineures, crée une page pilier exhaustive qui couvre l'ensemble du sujet et répond à toutes les variantes d'intention. Redirige les pages redondantes en 301 vers cette ressource unique.

Quelles erreurs éviter absolument ?

Ne te base pas uniquement sur le volume de recherche pour décider de créer une page. Un mot-clé avec 200 recherches mensuelles ne justifie pas automatiquement une URL dédiée si l'intention est déjà couverte ailleurs sur ton site.

Évite aussi la pseudo-différenciation : changer le H1 et trois phrases dans un template identique ne suffit pas. Google compare le contenu au niveau sémantique profond, pas juste les mots exacts. Si deux pages disent la même chose avec des mots différents, elles seront détectées comme redondantes.

Comment vérifier que mon site respecte cette directive ?

- Réalise un audit de cannibalisation : identifie les pages qui se positionnent sur les mêmes requêtes

- Utilise Google Search Console pour repérer les impressions partagées entre plusieurs URLs de ton site

- Analyse le taux de crawl : si Google explore beaucoup de pages mais en indexe peu, c'est un signal de contenu faible

- Vérifie les signaux d'engagement (temps sur page, taux de rebond) : des pages similaires auront des métriques médiocres

- Teste la pertinence : pour chaque page, demande-toi si elle répond à une question unique que les autres pages ne traitent pas

- Consolide impitoyablement : mieux vaut 1 page exhaustive à 3000 mots que 5 pages moyennes à 600 mots

Cette directive de Google impose un changement de paradigme : passer d'une logique quantitative (couvrir tous les mots-clés) à une logique qualitative (créer des ressources de référence). Les sites qui s'adaptent rapidement à cette approche gagnent en autorité thématique et en performances long terme.

La mise en œuvre de cette stratégie demande une expertise pointue en analyse sémantique, architecture de l'information et optimisation technique. Si tu manques de ressources ou de visibilité sur la meilleure approche pour ton secteur spécifique, t'entourer d'une agence SEO expérimentée peut faire la différence entre une refonte efficace et une perte de trafic irréversible.

❓ Questions frequentes

Dois-je supprimer toutes mes pages ciblant des variantes de mots-clés ?

Comment savoir si deux pages sont trop similaires aux yeux de Google ?

Peut-on encore utiliser Google Trends pour la stratégie de contenu ?

Est-ce que cette directive s'applique aussi aux sites e-commerce ?

Combien de temps avant de voir les effets d'une consolidation de pages ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/11/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.