Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le processus de crawl en deux phases de Google ?

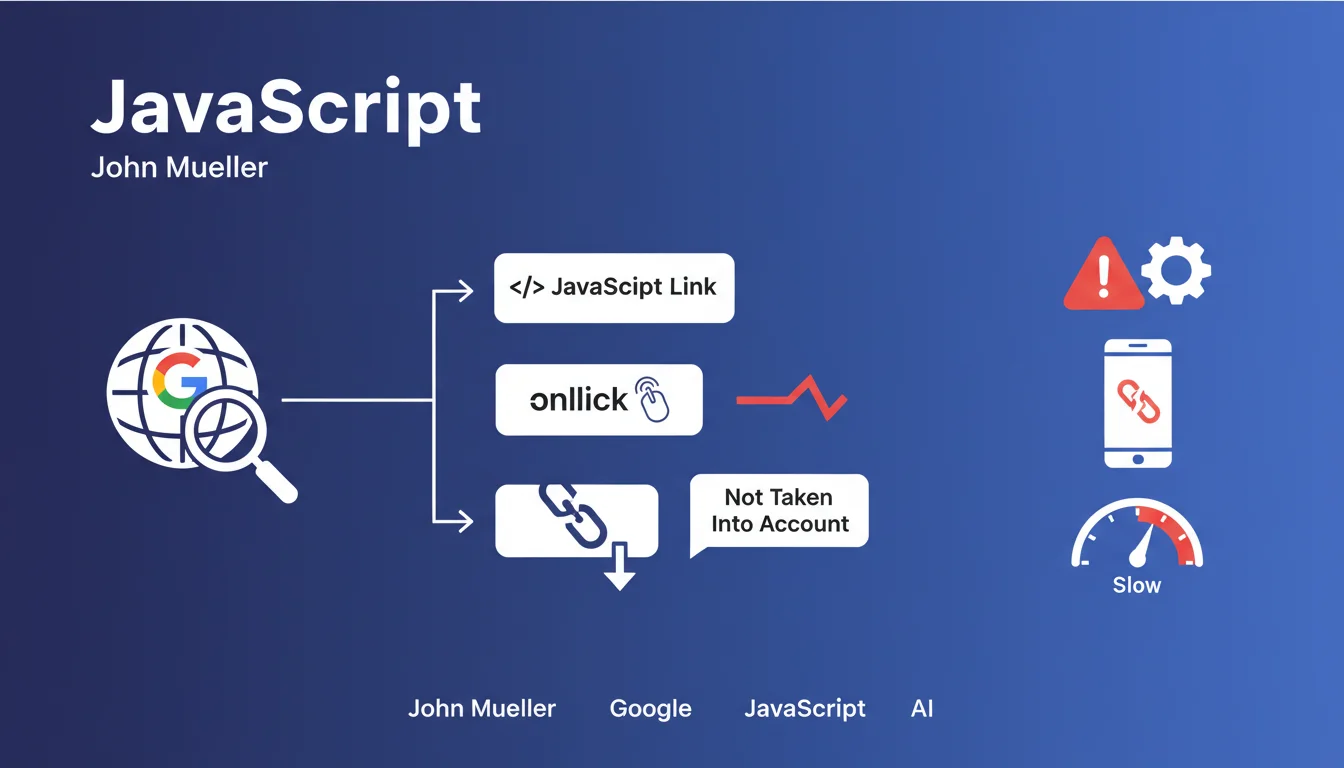

Google a révélé un processus d'indexation en deux étapes pour les pages utilisant JavaScript. Lors de la première passe, le moteur crawle la page dans son état initial, sans exécuter le JavaScript.

Quelques jours plus tard, une seconde passe intervient pour effectuer le rendu complet après interprétation du code JavaScript. Ce délai s'explique par des contraintes de ressources machine nécessaires pour exécuter du JavaScript à grande échelle.

Pourquoi ce délai pose-t-il problème pour les contenus sensibles au temps ?

Pour les contenus d'actualité ou time-sensitive, ce délai de plusieurs jours est critique. Le contenu peut perdre toute sa pertinence avant même d'être correctement indexé.

Entre les deux passes, les éléments structurels importants générés par JavaScript (balises meta, données structurées, liens internes) ne sont pas interprétés. Cela peut impacter négativement le positionnement initial de la page.

Quels sont les éléments à risque durant cette période transitoire ?

- Balises meta title et description générées dynamiquement par JavaScript

- Liens internes créés par des frameworks comme React ou Vue.js

- Données structurées (Schema.org) injectées via JavaScript

- Contenu principal chargé de manière asynchrone

- Canonical tags et directives d'indexation dynamiques

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Les tests pratiques confirment ce décalage temporel d'indexation. Les sites JavaScript-heavy montrent régulièrement des incohérences dans la Search Console durant les premiers jours suivant la publication.

Les outils comme Google Search Console montrent souvent des différences entre la vue "Inspecter l'URL" (rendu immédiat) et l'indexation réelle. Ce phénomène valide le processus en deux phases décrit par l'ingénieur de Google.

Quelles nuances faut-il apporter à cette révélation ?

Il est crucial de comprendre que ce processus ne s'applique pas uniformément à tous les sites. Les sites à forte autorité ou avec un crawl budget élevé bénéficient généralement d'une seconde passe plus rapide.

Par ailleurs, Google améliore constamment ses capacités de rendu JavaScript. Le délai de quelques jours mentionné peut varier selon la popularité du site, la fraîcheur du contenu et la complexité du JavaScript utilisé.

Dans quels cas cette contrainte est-elle moins problématique ?

Pour les sites de contenu evergreen (guides, tutoriels, pages produits pérennes), ce délai a un impact limité. Le contenu garde sa valeur dans le temps et quelques jours de décalage sont acceptables.

Les sites proposant du contenu statique généré côté serveur (SSR, SSG) échappent largement à cette problématique. Le contenu est immédiatement accessible lors de la première passe de crawl.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl JavaScript ?

La solution la plus efficace reste le Server-Side Rendering (SSR) ou la génération statique (SSG). Ces techniques permettent de servir du HTML complet dès la première passe de crawl.

Si le SSR n'est pas possible, privilégiez le rendu hybride : les éléments critiques (title, meta, h1, contenu principal) en HTML statique, et les fonctionnalités secondaires en JavaScript. Cette approche garantit l'indexation immédiate des éléments essentiels.

Pour les sites d'actualité ou e-commerce avec forte rotation de contenu, le SSR n'est plus une option mais une nécessité stratégique. Le délai d'indexation peut faire perdre des positions cruciales sur des requêtes concurrentielles.

Quelles erreurs critiques faut-il absolument éviter ?

- Ne jamais charger les balises title et meta description uniquement via JavaScript

- Éviter de générer l'intégralité du contenu textuel principal côté client

- Ne pas rendre les liens de navigation dépendants de l'exécution JavaScript

- Proscrire le chargement des données structurées exclusivement en JavaScript

- Ne pas utiliser JavaScript pour gérer les redirections SEO critiques

- Éviter les frameworks JavaScript pour les sites d'actualité time-sensitive sans SSR

Comment auditer et valider le rendu JavaScript de votre site ?

Utilisez l'outil d'inspection d'URL de Google Search Console pour comparer le HTML brut et le rendu final. Un écart significatif signale un problème potentiel d'indexation retardée.

Testez avec des outils comme Screaming Frog en mode JavaScript ou Puppeteer pour simuler le comportement de Googlebot. Vérifiez que tous les éléments critiques sont présents dans le DOM après rendu.

Surveillez les métriques d'indexation dans Search Console. Un délai anormal entre soumission et indexation effective peut indiquer des difficultés de traitement JavaScript.

💬 Commentaires (0)

Soyez le premier à commenter.