Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Pourquoi 15% des requêtes Google sont-elles inédites chaque jour et qu'est-ce que ça change pour votre stratégie ?

- □ Google envoie-t-il vraiment plus de trafic vers les sites web chaque année ?

- □ Pourquoi Google pousse-t-il la vérification au niveau du domaine dans Search Console ?

- □ Combien de temps faut-il attendre avant de voir les données apparaître dans Search Console ?

- □ Pourquoi Google Analytics et Search Console ne montrent-ils jamais les mêmes chiffres ?

- □ Google n'indexe-t-il vraiment qu'une seule vidéo par page ?

- □ Comment Google indexe-t-il réellement les vidéos sur vos pages web ?

- □ Les données structurées vidéo sont-elles vraiment indispensables pour apparaître dans les résultats de recherche ?

- □ Pourquoi Google ignore-t-il parfois votre balise canonical ?

- □ La mise à jour Page Experience est-elle vraiment un critère de classement déterminant ?

- □ Faut-il systématiquement valider les corrections dans Search Console pour accélérer le re-crawl ?

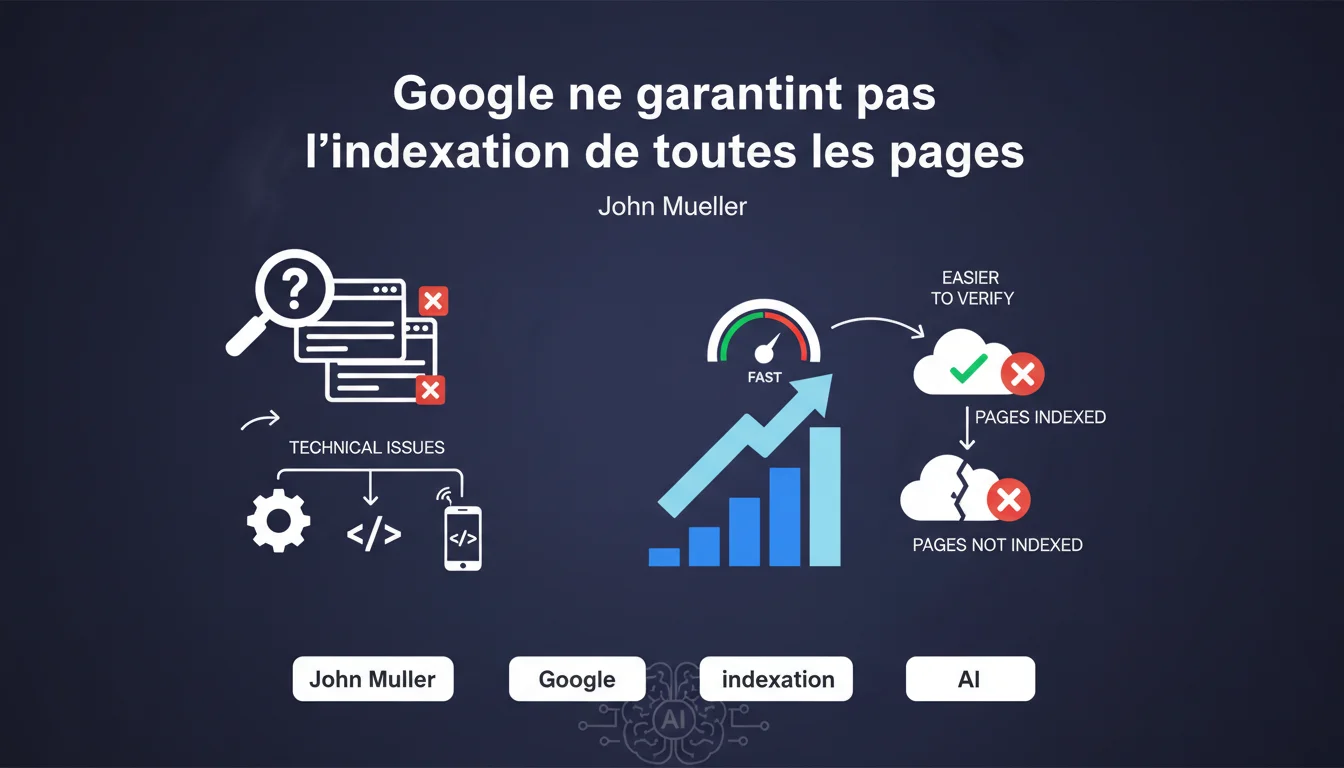

Google n'indexe pas automatiquement toutes les pages d'un site. C'est une réalité assumée, pas un bug. L'enjeu devient alors de diagnostiquer si les pages non indexées représentent un problème technique réel ou simplement un tri algorithmique légitime.

Ce qu'il faut comprendre

Pourquoi Google refuse-t-il d'indexer certaines pages ?

Google dispose d'un budget de crawl limité pour chaque site. Indexer toutes les pages d'Internet serait techniquement impossible et économiquement absurde. L'algorithme sélectionne donc les contenus jugés utiles, originaux et pertinents.

Cette sélection repose sur plusieurs critères : la qualité du contenu, la popularité perçue des URL, la profondeur de la page dans l'arborescence, le nombre de liens internes et externes pointant vers elle. Une page sans valeur ajoutée n'a aucune raison d'occuper de l'espace dans l'index.

Cette situation est-elle normale ou problématique ?

Tout dépend de la nature des pages non indexées. Si ce sont des pages de pagination, des filtres ou des variantes sans contenu unique, leur exclusion est souvent souhaitable. Cela évite la dilution de votre crawl budget sur des URL à faible valeur.

En revanche, si vos pages stratégiques — fiches produits à fort potentiel, articles de fond, landing pages commerciales — restent hors index, vous avez un problème. L'absence d'indexation devient alors un symptôme technique qu'il faut creuser rapidement.

Comment distinguer un choix algorithmique d'un blocage technique ?

Google Search Console reste l'outil de référence. Consultez le rapport de couverture : il distingue les pages exclues volontairement (noindex, canonicalisées, bloquées par robots.txt) des pages découvertes mais non indexées.

Si des pages importantes apparaissent dans cette seconde catégorie, vérifiez la profondeur de clic depuis la home, la qualité du maillage interne, l'absence de contenu dupliqué ou trop pauvre. Parfois, c'est juste une question de patience — Google reviendra.

- L'indexation partielle est normale sur les gros sites avec beaucoup de pagination ou de filtres

- Priorisez les pages stratégiques : mieux vaut 500 pages indexées performantes que 5000 pages fantômes

- Le diagnostic technique devient crucial lorsque des pages clés manquent à l'appel

- Google Search Console permet de surveiller l'évolution de la couverture d'index mois après mois

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Les audits SEO révèlent régulièrement des sites avec 40 à 60 % de pages non indexées, et ce n'est pas systématiquement un problème. Google a toujours favorisé la qualité sur la quantité.

Ce qui change, c'est que Mueller le dit enfin clairement. Pendant des années, beaucoup de SEO ont fantasmé sur un taux d'indexation à 100 %, en poussant des plans de site monstrueux et des soumissions massives via Search Console. Résultat : zéro impact si le contenu ne mérite pas l'index.

Quelles nuances faut-il apporter à cette affirmation ?

La nuance essentielle : Google ne garantit pas l'indexation, mais il ne l'empêche pas non plus si vous faites le nécessaire. Un site avec une architecture solide, des contenus originaux et un maillage interne efficace obtient généralement un bon taux de couverture.

Le vrai piège, c'est de confondre indexation et performance. Une page indexée n'apporte rien si elle ne ranke sur aucune requête. Parfois, mieux vaut désindexer volontairement du contenu faible pour concentrer le crawl budget sur les pages rentables. [À vérifier] : l'impact réel de cette stratégie d'élagage varie selon la taille et l'autorité du domaine.

Dans quels cas cette règle devient-elle un vrai problème ?

Lorsque des pages stratégiques — celles qui génèrent du trafic qualifié ou des conversions — restent invisibles malgré des efforts d'optimisation. Si votre catalogue produit n'est indexé qu'à 30 %, vous perdez du chiffre d'affaires.

Autre cas préoccupant : les sites d'actualité ou les blogs qui publient fréquemment. Si Google ne crawle qu'une fois par semaine, vos contenus frais perdent leur fenêtre de visibilité. Là, il faut agir sur la fréquence de crawl, pas juste espérer une indexation miraculeuse.

Impact pratique et recommandations

Que faut-il faire concrètement si des pages stratégiques ne sont pas indexées ?

Commencez par identifier les URL concernées via Search Console. Exportez le rapport de couverture, filtrez sur les pages "Découvertes, actuellement non indexées" et croisez avec vos pages à fort potentiel business.

Ensuite, vérifiez les fondamentaux : absence de balise noindex, canonique correcte, profondeur de clic raisonnable depuis la home (moins de 4 clics idéalement), contenu substantiel (plus de 300 mots avec valeur ajoutée réelle). Si tout est OK techniquement, renforcez le maillage interne vers ces pages.

Quelles erreurs éviter lorsqu'on cherche à augmenter son taux d'indexation ?

Ne submettez pas manuellement des centaines d'URL via Search Console. Ça ne sert à rien et ça peut même ralentir le crawl si Google détecte du spam. Le sitemap XML doit rester propre, limité aux pages réellement stratégiques.

Autre erreur classique : créer du contenu en masse pour gonfler artificiellement le nombre de pages indexées. Google repère les contenus générés automatiquement ou trop pauvres. Vous perdez du crawl budget sans gain de visibilité.

Comment surveiller l'évolution de votre couverture d'index dans le temps ?

Mettez en place un suivi mensuel via Google Search Console. Notez le nombre total de pages indexées, le nombre de pages exclues et les raisons d'exclusion. Comparez mois après mois pour détecter les variations anormales.

Si vous constatez une chute brutale, croisez avec les logs serveur pour identifier d'éventuelles erreurs 404, redirections en chaîne ou problèmes de temps de réponse. Un site lent se fait moins crawler, donc moins indexer.

- Auditez vos pages stratégiques non indexées via Search Console

- Vérifiez l'absence de blocages techniques (noindex, robots.txt, canonique)

- Optimisez le maillage interne vers les pages prioritaires

- Limitez votre sitemap XML aux URL réellement importantes

- Supprimez ou désindexez volontairement le contenu à faible valeur

- Surveillez mensuellement l'évolution de la couverture d'index

- Croisez les données Search Console avec les logs serveur pour anticiper les problèmes de crawl

❓ Questions frequentes

Combien de pages mon site doit-il avoir indexées pour être performant ?

Puis-je forcer Google à indexer une page spécifique ?

Mon concurrent a plus de pages indexées que moi, est-ce grave ?

Faut-il désindexer volontairement les pages faibles pour améliorer le crawl budget ?

Combien de temps Google met-il à indexer une nouvelle page ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.