Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Google notifie-t-il vraiment toutes les actions manuelles via Search Console ?

- □ Comment sortir d'une pénalité manuelle Google sans perdre des mois ?

- □ Google tolère-t-il vraiment les erreurs SEO involontaires ?

- □ Une erreur SEO peut-elle ruiner définitivement votre classement Google ?

- □ Google tolère-t-il vraiment les mauvaises pratiques SEO si votre site a du bon contenu ?

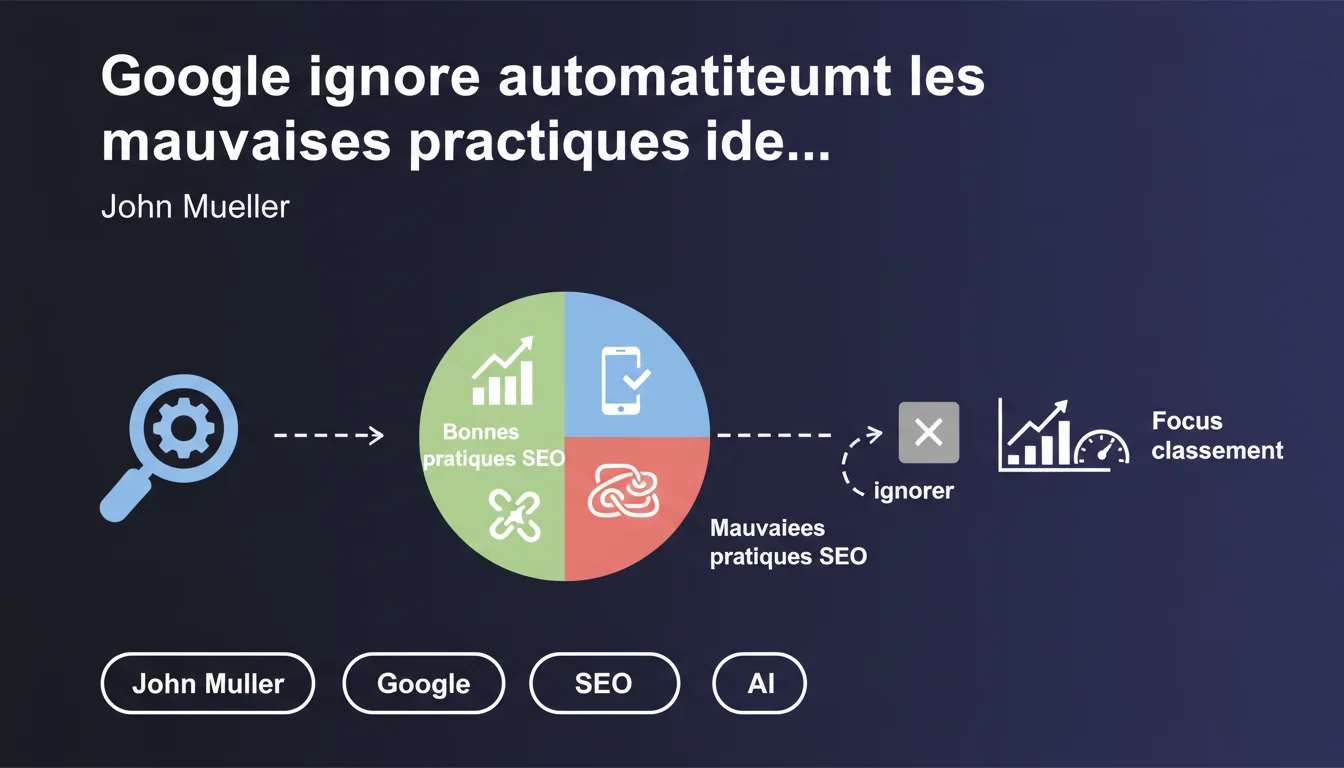

Google affirme que ses systèmes neutralisent automatiquement les techniques SEO détectées comme manipulatrices, sans pénaliser le reste du site. L'algorithme isole ces pratiques pour se concentrer sur le contenu légitime. Cette approche évite les sanctions manuelles tout en rendant les manipulations inefficaces.

Ce qu'il faut comprendre

Que signifie concrètement « ignorer » une mauvaise pratique ?

Quand Google parle d'ignorer une technique douteuse, il ne s'agit pas d'une pénalité classique. L'algorithme détecte la manipulation (bourrage de mots-clés, cloaking basique, liens spam facilement identifiables) et décide de ne pas en tenir compte dans le calcul du classement.

Le site n'est pas sanctionné — il ne bénéficie simplement pas de l'avantage recherché. C'est une neutralisation silencieuse : pas d'alerte dans la Search Console, pas de chute brutale de trafic, juste une absence d'effet.

Pourquoi cette approche plutôt qu'une pénalité ?

Les pénalités manuelles coûtent cher en ressources humaines et génèrent des contentieux. Automatiser la détection et l'annulation des effets permet à Google de traiter massivement les cas sans intervention.

Cette méthode s'applique surtout aux tactiques déjà bien documentées : Google sait les reconnaître avec un taux de confiance élevé. Pour les manipulations plus sophistiquées, l'action manuelle reste d'actualité.

Qu'est-ce qui distingue ce que Google ignore de ce qu'il pénalise ?

La frontière tient à la capacité de détection automatique et au niveau de nuisance. Un réseau de liens artificiels grossier sera probablement ignoré. Un PBN bien camouflé ou une ferme de contenu généré massivement pourra déclencher une action manuelle si elle dégrade l'expérience utilisateur à grande échelle.

Google distingue aussi les pratiques localisées (quelques pages concernées) des stratégies systémiques qui gangrènent un domaine entier. Dans le second cas, la tolérance diminue.

- L'ignorance automatique concerne les techniques identifiables par pattern recognition

- Pas de notification dans la Search Console pour ces cas

- Le reste du site continue à être évalué normalement

- Les tactiques sophistiquées ou nuisibles à grande échelle restent exposées aux actions manuelles

- Cette approche vise l'efficience algorithmique plutôt que la punition

Avis d'un expert SEO

Cette déclaration correspond-elle à ce qu'on observe sur le terrain ?

Oui et non. On constate effectivement que certains sites utilisant des techniques borderline ne subissent aucune sanction visible — ils stagnent simplement sans progression. Leur trafic reste stable, mais les pages optimisées avec ces méthodes ne gagnent jamais de positions.

Inversement, d'autres cas montrent des chutes brutales sans action manuelle déclarée, suggérant que la frontière entre « ignorer » et « pénaliser algorithmiquement » est floue. [A vérifier] : Google ne précise jamais à quel moment un filtrage devient une dévaluation active.

Quelles sont les limites de cette logique d'ignorance ?

L'approche fonctionne pour les signaux isolés : quelques liens spam, du keyword stuffing léger sur une poignée de pages. Mais que se passe-t-il quand la mauvaise pratique est structurelle ? Si 60% du contenu d'un site repose sur de la génération automatique médiocre, Google peut-il vraiment « se concentrer sur les bonnes parties » ?

La déclaration de Mueller suppose qu'il existe toujours du contenu légitime à valoriser. Pour les sites entièrement construits sur des tactiques manipulatrices, cette distinction n'a pas de sens — et c'est là qu'interviennent les pénalités manuelles ou les core updates destructeurs.

Faut-il en déduire qu'on peut tenter des tactiques sans risque ?

Absolument pas. Ce que Google ignore aujourd'hui peut devenir détectable demain. Les améliorations continues des algorithmes élargissent constamment le périmètre de ce qui est repérable automatiquement.

Soyons honnêtes : miser sur l'ignorance algorithmique, c'est parier que votre technique restera invisible. C'est un pari à court terme, avec un risque résiduel d'action manuelle si quelqu'un signale votre site ou si vous montez trop vite dans les SERP compétitives.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Première réaction : auditer les zones grises de votre site. Identifiez les tactiques que vous utilisez en sachant qu'elles sont discutables — ancres sur-optimisées, pages satellites, contenu automatisé léger. Demandez-vous : si Google les ignore, pourquoi les maintenir ?

Ces pratiques consomment des ressources (crawl budget, budget éditorial, maintenance) sans apporter de bénéfice. Mieux vaut investir ce temps dans du contenu réellement différenciant qui ne dépend pas de la tolérance algorithmique.

Comment vérifier si des pratiques sont ignorées plutôt que valorisées ?

Analysez les performances par segment. Si certaines pages ou sections stagnent malgré des optimisations répétées, c'est probablement que Google neutralise vos efforts. Comparez les taux de conversion, le temps de session, les signaux d'engagement : ils révèlent souvent que ces pages n'apportent rien à l'utilisateur.

Testez en désactivant temporairement certaines optimisations suspectes — supprimez des blocs de liens, allégez les ancres, réécrivez du contenu généré. Si le trafic ne bouge pas, vous avez votre réponse : ces éléments étaient déjà ignorés.

Quelles erreurs éviter à la lumière de cette déclaration ?

Ne confondez pas « pas encore pénalisé » avec « approuvé par Google ». L'absence de sanction n'est pas une validation. Beaucoup de sites vivent dans une zone grise en pensant que tant que ça passe, c'est acceptable.

Autre erreur : croire que Google a une définition binaire du spam. La réalité est un spectre de tolérance variable selon le secteur, la concurrence, l'historique du domaine. Ce qui est ignoré pour un site établi peut déclencher une action manuelle pour un nouveau domaine agressif.

- Auditer les tactiques borderline actuellement en place sur le site

- Analyser les performances par segment pour identifier les zones potentiellement neutralisées

- Tester la désactivation de certaines optimisations suspectes

- Prioriser les investissements sur du contenu et des signaux positifs durables

- Ne jamais considérer l'absence de sanction comme une approbation tacite

- Documenter les choix SEO pour pouvoir les réévaluer après chaque core update

❓ Questions frequentes

Si Google ignore les mauvaises pratiques, pourquoi mon site a-t-il été pénalisé ?

Comment savoir si une technique est ignorée ou simplement pas encore détectée ?

Les liens spam achetés sont-ils ignorés ou pénalisés ?

Dois-je nettoyer mon profil de liens si Google les ignore de toute façon ?

Cette politique d'ignorance s'applique-t-elle au contenu généré par IA ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.