Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Le SEO se résume-t-il vraiment à « apparaître dans les résultats de recherche » ?

- □ Pourquoi Google insiste-t-il encore sur les « bons mots-clés » en SEO ?

- □ Pourquoi Google insiste-t-il autant sur les informations pratiques des sites web ?

- □ Les titres de page descriptifs sont-ils vraiment le facteur déterminant pour votre visibilité SEO ?

- □ Les coordonnées et descriptions d'entreprise influencent-elles vraiment le référencement local ?

- □ Pourquoi le texte alternatif des images et vidéos reste-t-il un levier SEO sous-exploité ?

- □ Pourquoi Google insiste-t-il autant sur les mots-clés descriptifs pour les images produits ?

- □ Google peut-il vraiment détecter toutes les techniques de manipulation du classement ?

- □ Le black hat SEO est-il vraiment une perte de temps et d'argent ?

- □ Search Console suffit-il vraiment à gérer le SEO de votre site ?

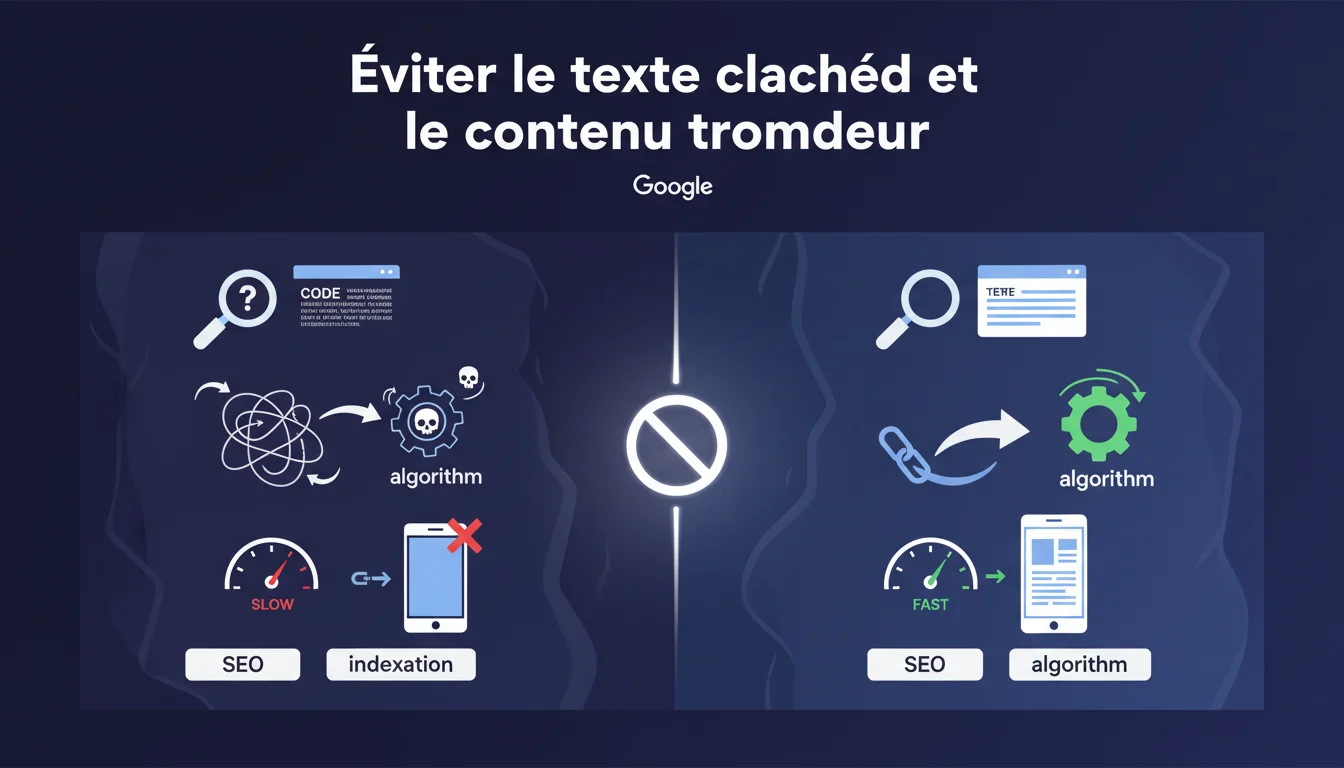

Google condamne explicitement le texte invisible et les techniques de cloaking comme du black hat SEO visant à manipuler les algorithmes. Ces pratiques — masquer du contenu pour les utilisateurs tout en le rendant visible aux robots — exposent à des pénalités manuelles et algorithmiques. L'enjeu : distinguer les techniques légitimes d'optimisation des manipulations interdites.

Ce qu'il faut comprendre

Qu'entend exactement Google par "texte caché" ?

Le texte caché désigne tout contenu rendu invisible ou quasi-invisible aux visiteurs humains, mais accessible aux robots d'indexation. Les techniques classiques : texte blanc sur fond blanc, police de taille 0, positionnement hors écran via CSS, superposition d'éléments.

Google distingue le texte intentionnellement dissimulé du contenu techniquement masqué mais accessible via interaction utilisateur (accordéons, onglets, menus déroulants). Le premier relève de la manipulation, le second d'une interface légitime.

Pourquoi Google considère-t-il ces pratiques comme du black hat ?

L'objectif est transparent : bourrer une page de mots-clés supplémentaires sans dégrader l'expérience utilisateur. Cette asymétrie entre ce que voit l'humain et ce qu'indexe le robot constitue une tentative de manipulation des classements.

Le cloaking — afficher un contenu différent selon que le visiteur est un bot ou un humain — amplifie cette tromperie. Google y voit une violation directe de ses consignes de qualité, passible de pénalités manuelles.

Quelles sont les zones grises qui posent problème aux SEO ?

Certaines implémentations techniques légitimes flirtent avec la limite. Les attributs aria-label pour l'accessibilité, le contenu chargé en JavaScript différé, les textes alternatifs d'images — autant d'éléments invisibles mais fonctionnels.

Le critère de distinction : l'intention. Si le contenu masqué sert l'expérience utilisateur (accessibilité, performance, UX mobile), Google tolère. S'il n'a d'autre but que de gonfler artificiellement la densité de mots-clés, c'est interdit.

- Texte invisible via couleur, taille ou positionnement = black hat sanctionnable

- Cloaking (contenu différent pour bots vs humains) = violation grave des guidelines

- Contenu masqué mais accessible via interaction (accordéons, tabs) = acceptable si justifié par l'UX

- Attributs techniques (aria-label, alt, schema markup) = légitimes s'ils servent l'accessibilité ou la compréhension

- Le critère discriminant reste l'intention : améliorer l'expérience ou manipuler les classements ?

Avis d'un expert SEO

Cette déclaration reflète-t-elle les pratiques de pénalisation observées ?

Sur le terrain, les pénalités manuelles pour texte caché restent rares mais exemplaires. Google cible surtout les cas flagrants où des centaines de mots-clés sont dissimulés. Les sanctions automatiques via les algorithmes de qualité (Helpful Content, Page Experience) sanctionnent plutôt indirectement ces sites — via des signaux d'engagement dégradés.

Soyons honnêtes : la détection automatisée n'est pas infaillible. Des sites avec du texte légèrement masqué (gris clair sur blanc, par exemple) échappent parfois aux radars. Mais le risque-récompense est déséquilibré — le gain potentiel ne justifie jamais l'exposition à une action manuelle.

Quelles nuances manquent à cette communication officielle ?

Google ne définit pas précisément où se situe la frontière pour les implémentations JavaScript modernes. Un contenu chargé en lazy-load, techniquement invisible au chargement initial, pose-t-il problème ? [À vérifier] — les guidelines restent floues sur le timing d'indexation du contenu dynamique.

Autre zone d'ombre : les accordéons et onglets. John Mueller a confirmé à plusieurs reprises que Google indexe ce contenu, mais lui accorde-t-il le même poids qu'un texte directement visible ? Les tests A/B montrent des variations de performance — ce qui suggère une pondération différenciée que Google n'admet pas explicitement.

Dans quels cas cette règle pose-t-elle des dilemmes pratiques ?

Les sites e-commerce avec des filtres de navigation complexes génèrent souvent du contenu masqué. Les facettes de recherche, les descriptions de catégories repliées par défaut, les avis clients chargés à la demande — autant d'éléments qui techniquement "cachent" du texte.

Le mobile complique encore la donne. Masquer du contenu secondaire pour améliorer la Core Web Vitals et le LCP est une pratique courante. Google recommande le responsive design... mais pénalise le cloaking mobile-desktop. Le praticien doit naviguer entre ces contraintes contradictoires sans consigne claire.

Impact pratique et recommandations

Comment vérifier qu'un site ne contient pas de texte caché problématique ?

Premier réflexe : auditer via la Google Search Console. Les actions manuelles pour "texte caché" y apparaissent explicitement. Mais l'absence de notification ne garantit rien — les algorithmes peuvent déclasser sans alerte.

Techniquement, compare le rendu utilisateur au rendu Googlebot. L'outil "Inspection d'URL" de la GSC permet de visualiser la version indexée. Tout écart significatif entre ce que voit un humain et ce que scrape le bot constitue un signal d'alarme.

Quelles implémentations techniques sont à éviter absolument ?

Les erreurs classiques persistent. display:none sur du contenu bourré de mots-clés, text-indent négatif pour projeter du texte hors écran, font-size:0 — ces techniques datent des années 2000 mais circulent encore dans certains forums SEO douteux.

Plus insidieux : le cloaking via user-agent. Servir une version enrichie aux bots Google tout en affichant une page épurée aux visiteurs. Les outils de détection (comme le User-Agent Switcher) permettent de tester, mais Google dispose de systèmes d'analyse bien plus sophistiqués.

Quelles alternatives légitimes pour optimiser sans risque ?

Pour enrichir sémantiquement une page sans surcharger visuellement, privilégie les contenus interactifs légitimes. Les accordéons bien implémentés (balises details/summary), les onglets accessibles au clavier, les sections "En savoir plus" dépliables — tout ce qui améliore réellement l'UX passe.

Le schema markup offre une voie royale pour contextualiser du contenu sans l'afficher. Les données structurées (FAQ, HowTo, Product) enrichissent la compréhension du bot sans polluer l'interface. C'est exactement l'inverse du texte caché : visible pour Google, utile pour l'utilisateur via les rich snippets.

- Auditer régulièrement avec l'outil Inspection d'URL de la GSC pour comparer rendu utilisateur et rendu bot

- Supprimer tout contenu masqué via display:none, visibility:hidden ou text-indent négatif s'il ne sert pas l'UX

- Vérifier que les accordéons et onglets utilisent des balises HTML sémantiques (details/summary, aria-controls)

- Implémenter les données structurées schema.org pour enrichir la compréhension contextuelle

- Tester l'accessibilité avec un lecteur d'écran — si un contenu n'est utile ni visuellement ni en synthèse vocale, il est suspect

- Éviter tout cloaking : le contenu servi aux bots doit correspondre strictement à celui accessible aux humains

- Documenter les choix d'implémentation (pourquoi tel contenu est masqué par défaut) pour justifier en cas d'audit

❓ Questions frequentes

Google pénalise-t-il le contenu dans des accordéons fermés par défaut ?

Le lazy-loading d'images ou de texte est-il considéré comme du texte caché ?

Comment distinguer le cloaking d'une simple adaptation responsive ?

Les attributs aria-label peuvent-ils être considérés comme du texte caché manipulateur ?

Quelle sanction risque-t-on concrètement pour du texte caché détecté ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 24/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.