Declaration officielle

Ce qu'il faut comprendre

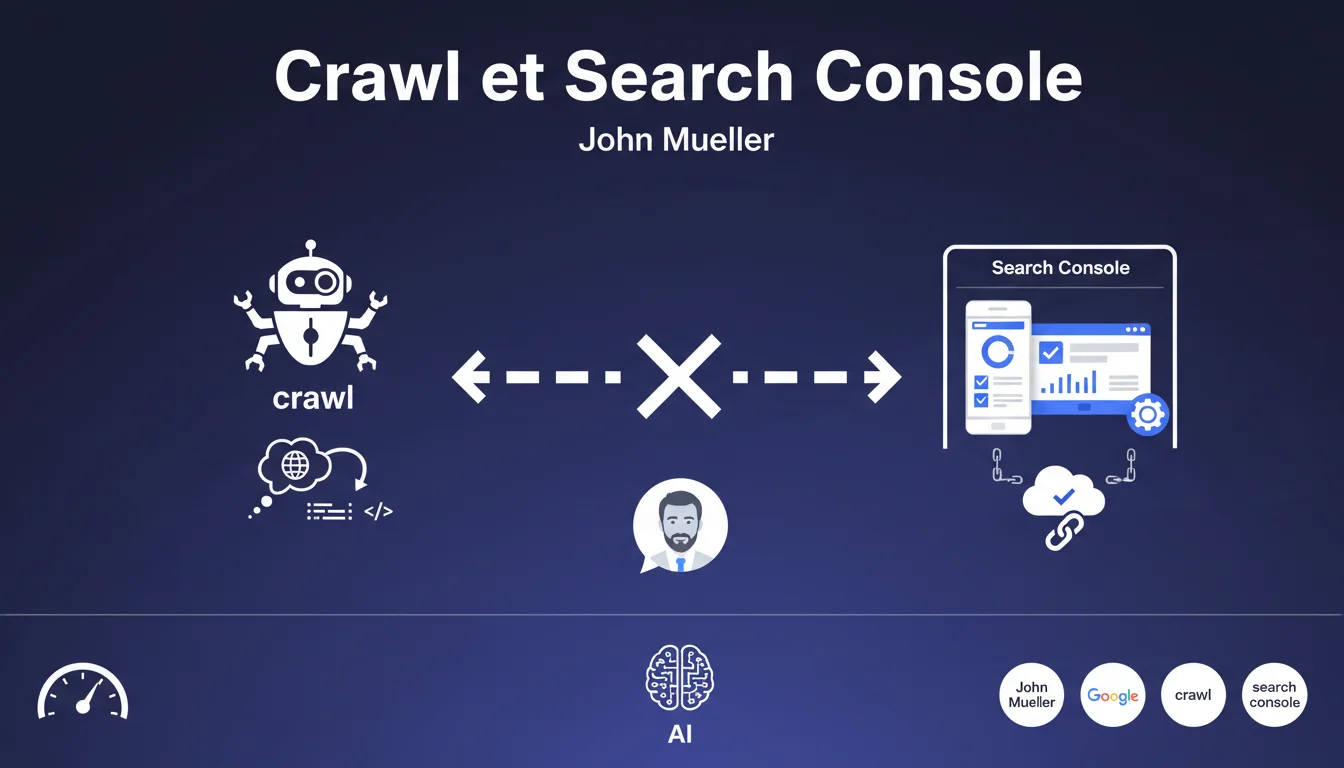

Une idée reçue circule dans la communauté SEO : ajouter et vérifier son site dans la Search Console permettrait d'améliorer son crawl par Googlebot. Cette croyance suggère qu'en « déclarant » officiellement son site à Google, on bénéficierait d'une priorité ou d'une fréquence de crawl supérieure.

La réalité est toute autre. Le système de crawl de Google fonctionne de manière totalement indépendante de la Search Console. Que vous ayez vérifié votre propriété ou non, cela n'influence en rien la façon dont Googlebot explore vos pages.

Les facteurs qui déterminent réellement le crawl sont :

- La popularité du site et son autorité (backlinks, mentions)

- La fraîcheur du contenu et la fréquence de mise à jour

- La structure technique (temps de chargement, architecture, robots.txt)

- Le budget de crawl alloué en fonction de la taille et de l'importance du site

- Les signaux de qualité globaux du domaine

La Search Console reste néanmoins un outil indispensable pour surveiller et optimiser le SEO, même si elle n'agit pas directement sur le crawl. Elle permet de comprendre comment Google perçoit votre site, d'identifier les erreurs et d'optimiser la visibilité.

Avis d'un expert SEO

Cette clarification correspond parfaitement à ce que nous observons sur le terrain. La Search Console est un outil de monitoring et d'analyse, pas un levier d'action directe sur l'indexation. Les sites non déclarés dans la Search Console sont crawlés avec la même intensité que les autres, à conditions techniques et popularité égales.

Il existe toutefois une nuance importante : même si la Search Console n'impacte pas le crawl automatique, elle offre des fonctionnalités qui peuvent indirectement l'influencer. Par exemple, soumettre un sitemap XML via la Search Console aide Google à découvrir des URLs qu'il aurait pu manquer. De même, demander une réindexation d'URL via l'outil d'inspection accélère la prise en compte de modifications critiques.

Dans la pratique, utiliser la Search Console reste essentiel, non pas pour augmenter le crawl, mais pour diagnostiquer les problèmes d'indexation, suivre les performances organiques et corriger les erreurs techniques qui, elles, impactent réellement le crawl.

Impact pratique et recommandations

- Ne comptez pas sur la Search Console pour augmenter magiquement votre fréquence de crawl

- Concentrez-vous sur les vrais facteurs de crawl : optimisation technique, vitesse de chargement, architecture claire, contenus frais et de qualité

- Utilisez la Search Console pour ce qu'elle fait vraiment : analyser les performances, identifier les erreurs d'indexation, surveiller les Core Web Vitals

- Soumettez votre sitemap XML via la Search Console pour faciliter la découverte de vos URLs (sans attendre un impact sur la fréquence de crawl)

- Exploitez l'outil d'inspection d'URL pour demander ponctuellement la réindexation de pages critiques modifiées

- Améliorez votre budget de crawl en corrigeant les erreurs 404, les redirections en chaîne, et en optimisant la structure de liens internes

- Augmentez votre popularité via une stratégie de netlinking qualitative pour naturellement intensifier le crawl

La maîtrise complète du crawl et de l'indexation requiert une expertise technique approfondie et une surveillance continue. Entre l'optimisation du budget de crawl, la gestion des erreurs techniques, l'architecture du site et la stratégie de contenus, les paramètres à orchestrer sont nombreux et interdépendants.

Pour les sites complexes ou à fort enjeu, s'entourer d'une agence SEO spécialisée peut s'avérer judicieux. Un accompagnement personnalisé permet d'identifier précisément les freins au crawl, de mettre en œuvre des optimisations avancées et d'assurer un suivi régulier des performances d'indexation.

💬 Commentaires (0)

Soyez le premier à commenter.